股价暴涨7%!我们深挖了两份低调公布的资料后,发现了苹果AI的秘密

本文探讨苹果Apple Intelligent背后的技术及其对未来AI手机行业的影响。苹果发布了GPT4级大模型,可以直接接入软硬件体系,不用依靠外部模型公司。苹果还配备了功耗分析工具Talaria,保证AI模型的运作不会大幅降低手机功耗。苹果的AI功能只能在iPhone 15 Pro及以上机型使用,用户可能需要换机。苹果与OpenAI合作提供更强大的AI服务,但并非集成入苹果系统中。苹果强调其Apple Intelligence系统的安全性,通过系统级的安全芯片加密和封闭的传输路径来保证用户数据的安全。未来,苹果将会多次证明其AI策略的安全性。

原文作者:郝博阳 郭晓静 吴彬

原文来源:腾讯科技

苹果在大模型时代落后了吗?几乎所有人都希望在苹果WWDC24上找到这个答案。然而,在最重要的主题演讲环节之后,争议也纷至沓来:发布会前半部分是被戏谑为“追赶安卓”的小功能集合,后半部分最重磅的AI,从表面上看和安卓手机目前已经对外发布的AI能力大差不差,被很多人认为“没有惊喜”。段子开始在网上传播:“WWDC24最大的惊喜是苹果给iPad带来了一个新的计算器”。

虽然真正意义上的AI硬件还没有出现,但是大模型可能成为未来端侧设备中等同于操作系统的“核心”,已经成为行业中的某种共识。这样重要的大模型能力,苹果到底有没有?苹果在AI时代,难道真的要靠OpenAI这样的第三方大模型公司了吗?

主题演讲的当天,苹果的股价下跌了1.9%,这似乎符合外界对于这场发布会的”平淡“评价。然而,戏剧性的事情出现了,苹果股价在主题演讲的第二天,暴涨7%创出历史新高。资本市场是市场合力的体现,对于苹果3.18万亿的巨大市值体量来讲,资金背后情绪的巨大反差,值得引起关注。

顺着之前的争议焦点,我们将关注点集中到了两份资料:一份资料是苹果在官网低调发布的大模型技术文档,其中有很多值得深挖的细节。另外一份是腾讯科技在现场的同事,发回的一份笔记,笔记记录了主题演讲之后举办的一个不起眼的闭门对谈内容,对话的两个人是“苹果公司的软件工程高级副总裁雷格-费德里吉(Craig Federighi)和苹果公司机器学习和人工智能战略高级副总裁约翰-吉安南德雷亚(John Giannandrea),他们二位都直接向CEO库克汇报。对话的内容包括为何与OpenAI合作以及如何保护隐私等。

本文围绕这两份资料,试图抽丝剥茧地探究一下,苹果的“大模型竞争力”究竟怎样。

重点有两个:

● 苹果自研大模型的能力很强;

● OpenAI并没有为Apple Intelligence提供支持,两者完全独立。Apple Intelligence完全由Apple自研模型提供支持。

深挖苹果发布的模型技术文档:

两个新确定的信息,

可能才是这次发布最重要的点

首先是信息逐渐清晰:有两个在发布会上并没说明的信息,在发布会后逐渐清晰化。

1.苹果低调发布了自研模型:不仅有端侧的小模型,还有云端大模型

在Keynote上,苹果一直在讲拥有了AI能力的端侧设备,能带给用户多么神奇的应用体验。但是这些模型到底是谁家的?哪些是苹果自研的,哪些是和OpenAI合作的?虽然承诺了隐私安全,但是究竟具体如何保障?马斯克连发推怒怼苹果如果集成了OpenAI,将在公司禁用苹果。但是苹果整场主题演讲下来,我们都没找到明确答案。

直到发布会后,它发布了一篇技术博客,并在State of Union上公布了它会在苹果设备上用的模型细节:端和云模型,都是苹果自己开发的。

自研大模型赶上GPT4

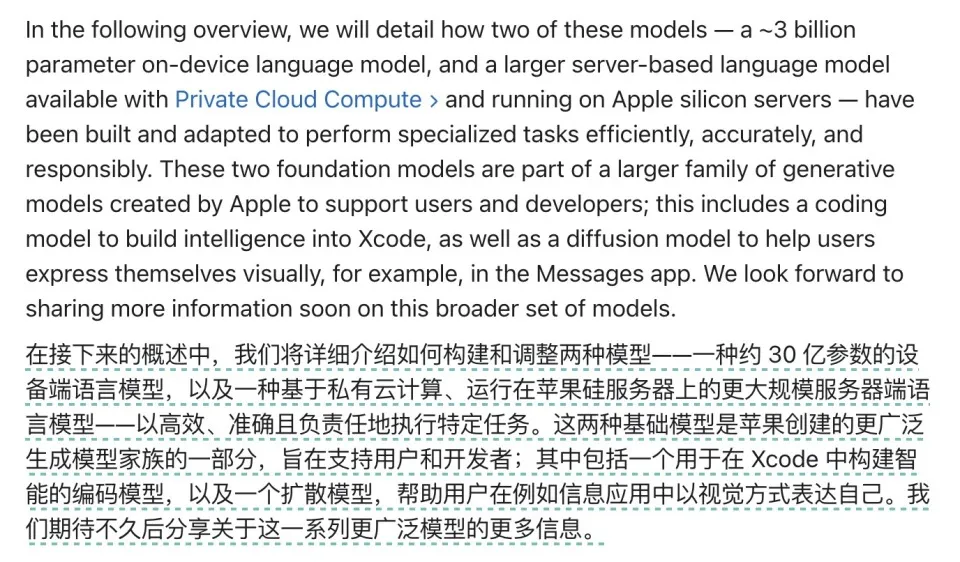

具体来看,苹果设备上的端侧模型是一个30亿参数(3B)的小模型,云上模型具体参数苹果没有公布。这两个模型的性能都相当能打。

3B级小模型和主流几个7B级模型能力上苹果都能基本胜出(胜出+平手概率>50%)。而其云端模型则直接打到了GPT-4 Turbo级(胜出+平手概率58.3%)。

这一发布可能才是整个苹果这波更新里最大的核弹:苹果自研出了GPT4级大模型,而且一出场就已经成熟到可以直接接入苹果的软硬件体系内了。

这意味着之前对苹果模型能力的质疑完全不成立。苹果现在不用依靠外部模型公司就能构建出自己内部闭环的AI系统。这是除了谷歌之外的其他手机厂商当下完全无法做到的。

这就是苹果把OpenAI只列为之一,而且是作为外部调用的模型之一的底气。

端侧小模型强优化

另外说说端侧模型,在发布会上苹果强调大多数Apple Intelligents的操作都会在端侧模型上完成。但在发布会后所有人几乎都在质疑,一个3B大小的模型是不是能真的完成发布会上展示的那些功能。

首先,3B大小的端侧模型落地其实已经很不容易了。

看看苹果的竞品们的表现吧:谷歌在去年12月首次把其端侧模型Gemnini Nano部署到旗舰手机Pixel 8 Pro上,它的参数大小不过是1.8B,而且能力非常局限。三星S24在端侧也用的是Gemnini Nano。要知道Pixel 8 Pro具有12G内存,直到今年5月谷歌刚刚才能让8G内存的Pixel 8 和 8a也跑上这个1.8B的模型,还要下个月才能真正升级部署。而其他手机厂商部署的端侧模型基本上都是在1B级别的参数规模。

而苹果做到了让自己8G内存的iPhone 15 Pro跑起来一个3B参数的模型。这工程能力就甩出竞争对手一个身位。

在这之前,苹果已经为此做足了准备,在去年12月引起轰动的论文《LLM in a flash: Efficient Large Language Model Inference with Limited Memory》里,苹果就提出了解决小内存运行大模型的方法,使用窗口化(Windowing)以及行列捆绑(Row-Column Bundling)两项关键技术,来最小化数据传输和最大化闪存吞吐量。

在这次的技术文档中,苹果还提到了他们在模型框架中用上了分组注意力查询(grouped-query-attention)和LoRA适应器框架。这两项技术一个避免重复映射,一个可以压缩推理过程,都可以有效降低内存占用和推理成本。

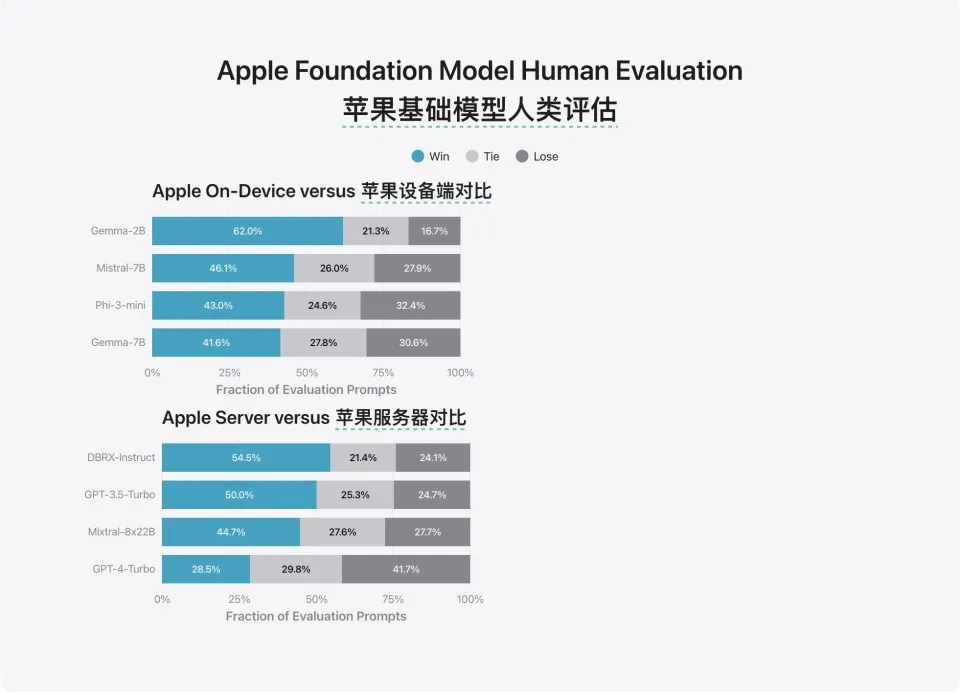

另外,为了保证AI模型的运作不至于大幅降低手机功耗,苹果还配上了功耗分析工具 Talaria,及时优化功耗。

在这一系列操作之下,3B模型的端侧部署才成为了可能。

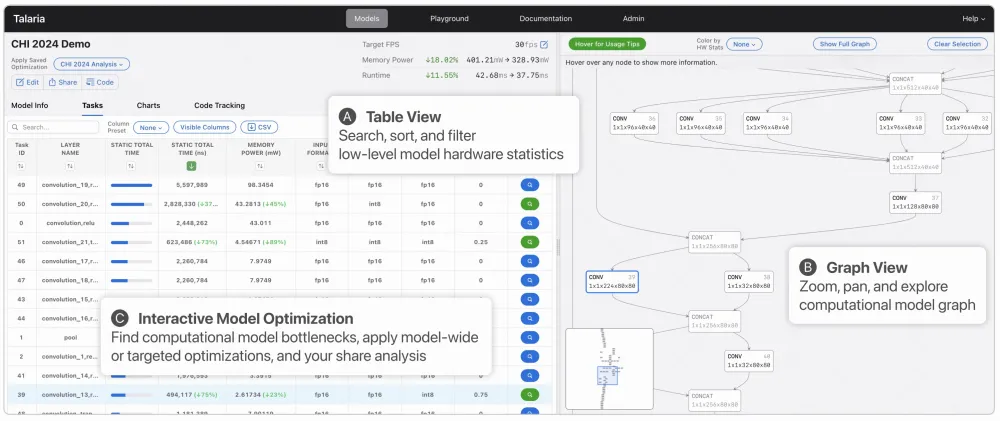

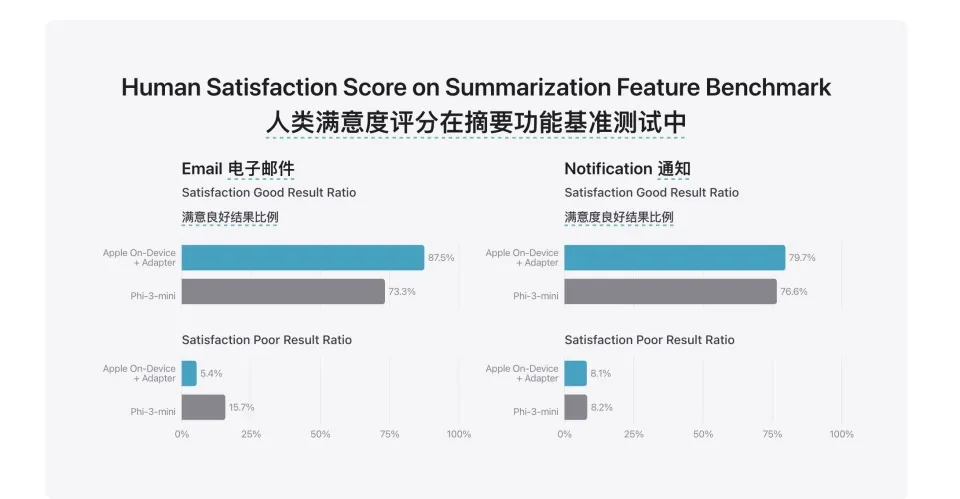

其次,在这篇技术博客里,苹果也展示了他们如何去保障小模型的交付能力:不全能,但对具体任务做了加强。

具体来讲,苹果在基础模型上加了很多微调的适配器。适配器是叠加在通用基础模型上的小型模型权重集合。它们可以动态加载和交换,使基础模型能够根据当前任务实时进行针对性特殊化处理。苹果智能包含一系列适配器,针对应急判断,总结,邮件回复等诸多发布会上上的功能都进行了精细调优。

因此,至少端侧模型可以较好的完成基本的摘要、写邮件等最常见的工作。

综合来看,苹果在这次发布会上所展示出来的综合模型能力基本可以说是远超预期。从大模型到小模型都一跃进入了第一梯队。

只有新旗舰才能用上的AI,可能引发新的换机潮

另一个消息也很重要:虽然iOS18系统升级可以适用于iPhoneX以上的所有机型,但苹果的AI功能只能适用在iPhone 15 Pro及以上机型,其它终端需要M1芯片以上的能力。这意味为了能用上AI,用户可能必须要进行一波换机潮。

这其实也不是苹果有意卡老用户。端侧大模型的运行瓶颈一方面是算力,一方面是内存。对苹果来说,算力问题可能反倒不是那么棘手。本次Apple Intelligent下放的产品从M1开始。M1芯片负责AI推理的NPU能力其实还比不上A16,但也足够处理苹果端侧模型的推理需求了。那iPhone14 Pro乃至iPhone 15为什么不行?还是因为内存不够。

因为在模型进行推理过程中需要占用很大的运行内存(DRAM),较小的内存会严重拖慢推理速度甚至无法完成推理。因此iPhone 15 Pro及以上的苹果手机才有的8G内存,可能就是当下经过一系列优化的3B端侧模型所需的最小内存数。

但这件事本身也有着优化的空间。昨天上交大发布的PowerInfer2手机推理框架就提出了进一步减小内存占用的方法。GeminiNano下放到Pixel 8也说明了谷歌也在做一样的努力。

但内存需求小了,还有7B,14B的模型排队等着上端。长远来看,机还是不得不换。毕竟只有更大的端侧模型才能带来更多让用户买单的体验魔法。

圆桌对话透露了和OpenAI的关系

既然苹果自研的大模型能力如此强大,为何还要和OpenAI合作?苹果公司的软件工程高级副总裁克雷格-费德里吉(Craig Federighi)和约翰-吉安南德雷亚(John Giannandrea)在Keynote之后的闭门对话环节揭示了这个细节,腾讯科技在WWDC现场的同事发回了这场对话的内容记录。“现有的拥有丰富公共信息的大语言模型,如ChatGPT,也有其用途。这些非常大的前沿模型有一些用户很喜欢的有趣功能,我们将其集成到我们的体验中可以使用户体验更丰富。”

考虑到这一点,Apple在WWDC官宣了与OpenAI合作,在其平台上提供更强大的AI服务。然而,值得注意的是,OpenAI的ChatGPT并没有为Apple Intelligence提供支持,两者完全独立。Apple Intelligence完全由Apple自研模型提供支持。

这就意味着,虽然Apple在WWDC现场官宣了和OpenAI的合作,但是这种合作并不是如外界猜测的,集成入苹果系统中的。这种合作更像是和第三方大模型公司合作的一个范式,Federighi解释说Apple与OpenAI合作是因为GPT-4o目前是最好的LLM,但Apple可能会在未来与其他LLM提供商合作,允许用户选择外部LLM提供商。SamAltman的态度也很暧昧,一向高调的他,在“如此重要”的合作达成之后,仅仅发布了一条推特。

图注:传言Sam Altman去了Apple Park,但是并没有上台的机会

根据Federighi所说,Apple Intelligence被设计为高度个性化的智能,需要利用个人设备上的数据,如照片、联系人、消息和电子邮件等,执行任务。当用户有更复杂的AI请求时,OpenAI的ChatGPT可以发挥作用。例如,某人可以使用他们的Mac或iPhone向ChatGPT发送查询,如果他们希望ChatGPT为他们编写电影剧本。

而且,Apple在设计其与ChatGPT的集成时也采取了隐私优先的思维。未经用户许可,任何用户数据都不会发送到OpenAI。在任何请求发送到ChatGPT处理之前,用户必须首先手动允许。“例如,我是医生,我可能希望将来引入一个医疗模型;我是律师,我可能有一个专为法律工作精炼的模型,我想将其引入我的个人设备中。“苹果认为这最终是将是对用户在个人智能方面所做工作的很好补充。”

通过与OpenAI的合作探路,未来苹果是否会像今天打造APP生态一样,继续在Apple的设备上引入百花齐放的模型,为用户提供无比个性化和智能化的体验?这些还是未知数,我们拭目以待。

打造未来的AI端侧设备,

苹果有着先天的生态优势

虽然苹果在WWDC上展示的这些应用场景看起来并没有多么神奇,但是不得不说,这些确实是用户实际应用中比较好的落地场景。比如iPadOS上笔记学习的功能,计算器全屏识别的功能,iOS上Gen emoji的能力等等,既有趣又有用。都是做应用,但是苹果显然做的更讨巧,更容易被用户深度的感知到。

在发布会后,腾讯科技主导的直播讨论中,怒喵科技创始人李楠就表示:“苹果的端侧模型具有系统级别的权限和数据访问能力。如果你问苹果真的在AI能力上做到了什么?它是全行业第一个真正把手机本地的API与端侧模型无缝衔接的,并且是全行业第一个真正把用户个人数据拿给端侧模型进行fine-tuning的。别的端侧模型也想做这事儿,但是他们拿不到这些数据的访问权限。苹果的端侧AI的核心技术能力一定会越来越强大。”

这种强大的本源力量来源于苹果独特的生态体系,这是安卓希望做而难以做到的,而苹果可能是短时间内,能打通所有硬件终端设备AI体验和流转的,唯一的一家公司。

这无疑是苹果这么多年立足于科技行业顶端不曾跌落的重要的护城河。他们拥有极其坚实的生态壁垒,这不单单是产品和系统之间的,包括底层的芯片和开发工具,苹果都可以做到完全的统一。

这帮助苹果在端侧AI时代,即便是后来者,也能提供前人无法实现的AI生态,甚至他们能提供更多的AI应用生态场景,比如此次WWDC24上,苹果就展示了包括AI生成emoji、AI驱动的数学备忘录等等让人眼前一亮的功能,这相对于很多厂商还只在宣传AI抠图能力相比,显然会更加有吸引力。

“我们希望人工智能不是取代我们的用户,而是增强他们的能力"。克雷格-费德里吉在圆桌对话中谈到苹果对于AI的看法,“这与我们之前看到的人工智能都不尽相同”。

但问题也随之而来,

苹果或许将在未来无数次的证明一件事

和OpenAI的关系确定之后,随之而来的问题是“苹果如何将已存在的用户数据交给第三方,完成AI生成内容的同时,保证它们的安全”。

这对于苹果来说极其重要。

作为今年WWDC最重要的产品,克雷格-费德里吉在发布Apple Intelligence的时候,用了很重的篇幅去试图告诉用户,Apple Intelligence所打造的这种“端+私有云”对组合方式,是多么的安全。苹果通过系统级的安全芯片加密,以及完全封闭的传输路径,去保证这一点……

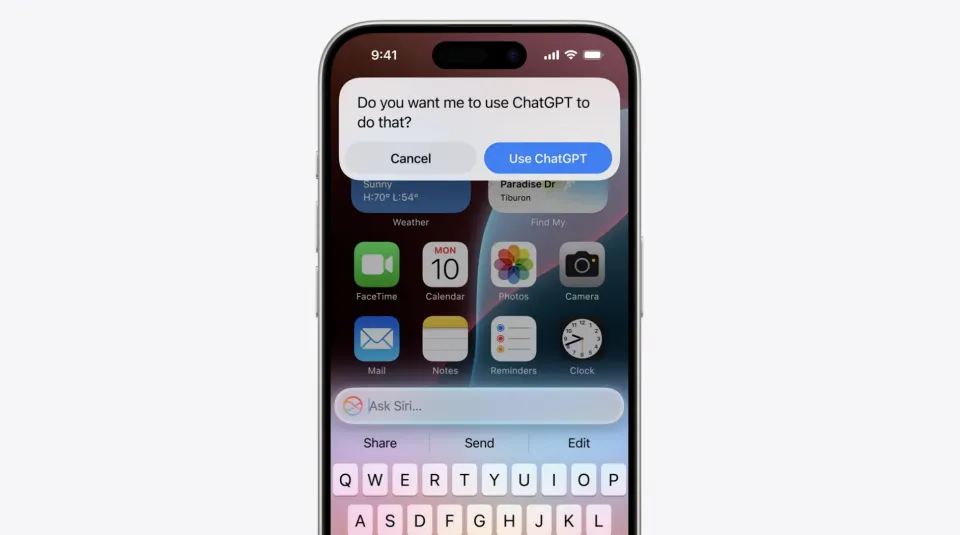

苹果在主题演讲中着重提及了这部分的流程,他们在系统中增加了一个开关,所有输出到GPT-4o的内容,都一定是用户主动发起确认的内容。

同时克雷格也在圆桌上表示苹果处理用户需求的过程,如果要上云,他们拥有一套独立的加密算法,用户数据脱敏,处理之后数据会随即销毁,苹果对于这个过程中的数据是完全无法干预的。

苹果希望通过这样的方式方法,去告诉用户这足够安全。甚至他们还找到了一些独立的安全研究人员,开放给他们Apple Intelligence的服务器,引入第三方去帮助他们证明用户数据的安全是不会被泄露的。

但这依然没能消除外界对于隐私数据安全外泄的担忧,尤其是在Siri接入到GPT-4o之后,用户数据如何脱敏、如何在苹果-OpenAI-苹果的这条传输路径中不走错路口等等问题,都一股脑的抛向了苹果。

面壁智能首席研究员韩旭在和腾讯科技的解读直播中也表示了担忧,他认为只要数据从苹果传给了第三方,无论是OpenAI的GPT还是Google的Gemini,苹果可能都将会失去对于数据安全的控制权,这确实会对苹果的隐私安全提出新的挑战。

但好消息是,这并不是苹果第一次面临这样的问题。

苹果在选择搜索供应商的时候,曾经陷入过类似的讨论。当苹果将Google确认为iPhone默认的(海外)搜索引擎时,曾经就被质疑如何保证用户的隐私数据不被泄露。库克在接受外媒专访时,阐述的内容和如今他们选择OpenAI出奇的一致。

苹果选择Google,库克表示谷歌在搜索引擎这一方面是做的最好的。

苹果选择OpenAI,克雷格也表示目前OpenAI是苹果最好的选择。

库克在谈及搜索引擎时,表示苹果也在其中融入了很多的控制选项,如在Safari浏览器中开发了隐私浏览模式,并配有智能防跟踪器等,来为用户提供全方面的帮助。

而克雷格在谈及AI时,更多的还只聊到了他们在端侧+私有云的加密策略,但对于OpenAI的部分,显然还没有透露更多。

或许可以预见,在未来的很长一段时间里,苹果都会无数次的证明,自己的AI策略是安全的,包括自己的和第三方的,这对于苹果这家公司来说,是红线。