金发姑娘区——AI是新石油,不是上帝

今天的“不无聊”节目由Tegus带来,这家公司收集行业内幕人士和高管的对话记录,拥有全球75%的私人市场记录。文章讨论了人工智能领域的发展,认为它类似于石油,可以规模化和提炼,对我们的一切产生倍增作用。作者认为人工智能会成为石油而不是上帝,应该积极促进其发展并为其带来的机遇做好规划。未来十年,人工智能可能会像石油一样带来爆炸式增长,但我们仍然需要人类的创造力来解决问题。

原文标题:The Goldilocks Zone

原文作者:Packy

原文来源:Substack

编译:Lynn,火星财经

星期二快乐,欢迎回到 Not Boring!祝所有 Not Boring 爸爸们父亲节快乐。

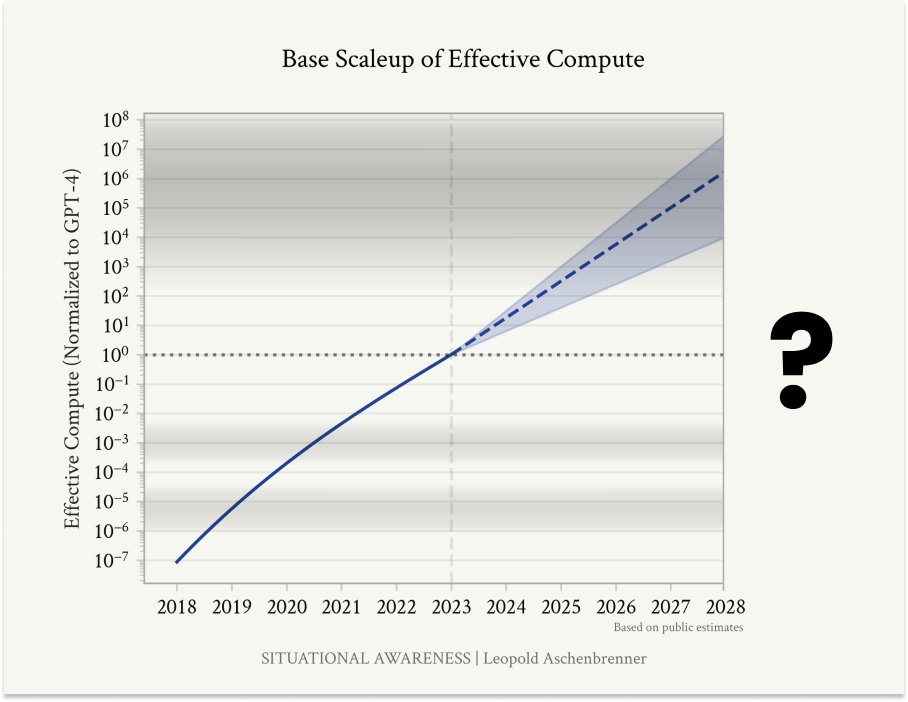

在过去的几周里,我一直在思考 Leopold Aschenbrenner 的《态势感知》,他在书中指出,只要继续以 AI 实验室扩展的相同速度扩展有效计算,就会在 2027 年实现 AGI,并在此后不久实现 ASI。

许多人都非常认真地对待这篇论文,而其他人则很快对其进行了驳斥,但我认为存在一种非常乐观的中间路线,而且这种路线也是最有可能的。

这篇文章就是关于那条道路的。

让我们开始吧。

金发姑娘区

人类的幸运真是无比巨大。

我们的星球地球位于天文学家所谓的“金发姑娘区”,即与太阳的距离刚好适合人类居住。这是我们这些即将创造出思考机器的猴子能够在地球上生存的百万个因素之一。

我们如此幸运,以至于我一直在想,是否有什么东西——上帝、模拟创造者、充满爱的宇宙、资本主义,随便你选一个——想让我们获胜。作为我们幸运的十亿个例子之一,我写道,能源转型的时机几乎太完美了:如果没有气候危机,我们可能会陷入更具破坏性的能源危机。

有些人认为我们的运气即将耗尽。经过数十亿年的进化,我们终于创造出了各方面都比我们优秀的人工智能。在最好的情况下,我们也将成为经济上无用的乘客。

我不这么认为。除非有证据证明人类的运气不好,否则人类总是幸运得令人难以想象,而相信我们即将变得比以往任何时候都幸运,只需要相信图表上的直线即可。

瞧,我太笨了,无法理解所有前沿的人工智能研究论文,而且我对人工智能的讨论也不是很了解。这只是我作为左翼局外人的常识,基于传统的人类直觉,比我聪明得多的人可能会不同意。

我要证明的是,数据指向了人工智能的“金发姑娘区” :我们提供的数据和计算越多,助手的能力就越强,而且它们完全没有超越我们的意愿或能力。

人工智能更像是石油,而不是上帝。它是一种经济实用的商品,可以规模化和提炼,对我们所做的一切产生倍增作用。汽油并没有取代马车,而是让马车载着人类走得更远、更快。

如果人工智能是上帝,各国政府就应该将其封锁。但如果人工智能是石油,各国政府就应该尽一切努力促进其发展,并激发各国的创业活力,将其提炼成更多有用的产品。

如果人工智能是上帝,你不妨放弃。但如果人工智能是石油,你可以庆祝每一次进步,将其视为你掌握的又一个工具,并为这些进步必然带来的真正颠覆和机遇做好规划。

相信人工智能会成为上帝是虚无主义,相信人工智能就是石油则是乐观主义。

整个兔子洞始于几周前,当时正值另一个金发姑娘区。我罕见地开了一次长途车,孩子们在后座上睡着了,而 Puja 不在前面。如果她当时在场,她绝不会让我听四个小时的Dwarkesh Patel 和 Leopold Aschenbrenner ,这可以理解。

利奥波德是一位年轻的天才(19 岁时,他以哥伦比亚大学班级第一名的成绩毕业),最近被现已解散的 OpenAI Superalignment 团队解雇。他刚刚发表了一篇论文《情境意识:未来十年》,他在论文中指出,按照我们目前的发展轨迹,我们很可能在 2027 年拥有 AGI,并在不久之后拥有超级智能 (ASI)。

“这并不需要相信科幻小说;”他在推特上写道,“它只需要相信图表上的直线。”

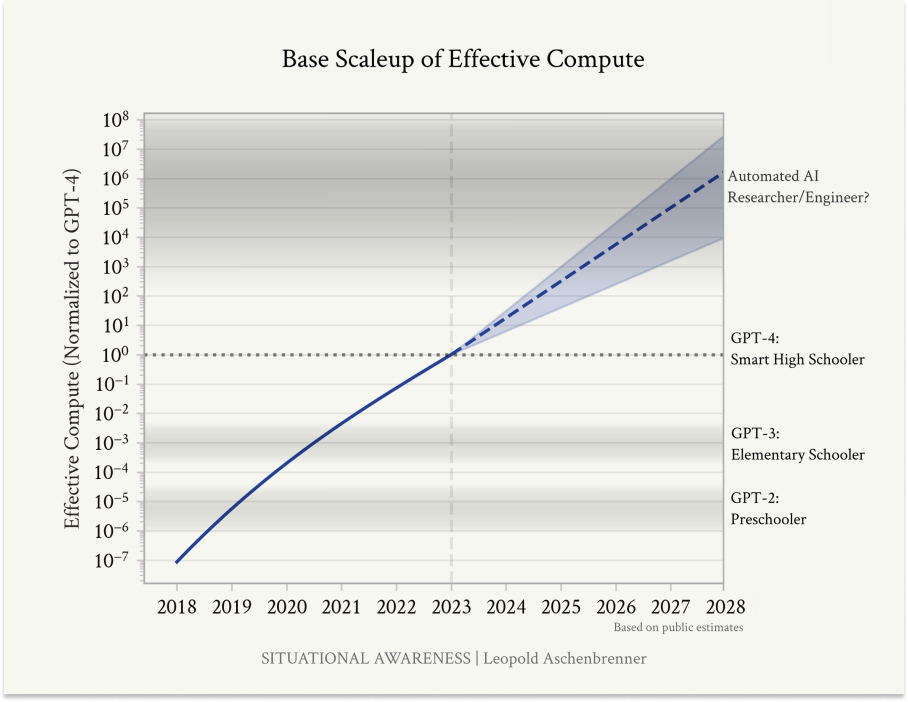

在论文和播客中,Leopold 提出,在更多的计算、更高效的算法和“解除束缚”之间,我们将在未来三年内将“有效计算”规模扩大 3-6 个数量级(增加 10 倍,“OOM”),这一飞跃与从 GPT-2 到 GPT-4 一样大。

如果这一飞跃将模型从学龄前儿童转变为聪明的高中生,那么下一次飞跃是否会将其从聪明的高中生转变为任何领域的博士?这难道不是 AGI 吗?

听完这篇论文,然后读了这篇论文,我感到一种认知失调:我同意利奥波德的逻辑,但结论感觉不对。经过一番思考,我想我明白了原因。

我同意 Leopold 的观点,我们应该相信曲线。我不同意的是,GPT-4 是一个聪明的高中生。

因此,本文将做三件事:

- 回应利奥波德的论点。

- 解释一下为什么这可能意味着我们正走向人工智能金发姑娘区。

- 如果人工智能是新的石油,看看那个区域的世界会是什么样子。

GPT-4 与聪明的高中生不一样,但如果我们要拟人化,那就让我们拟人化吧。

认识 Chad

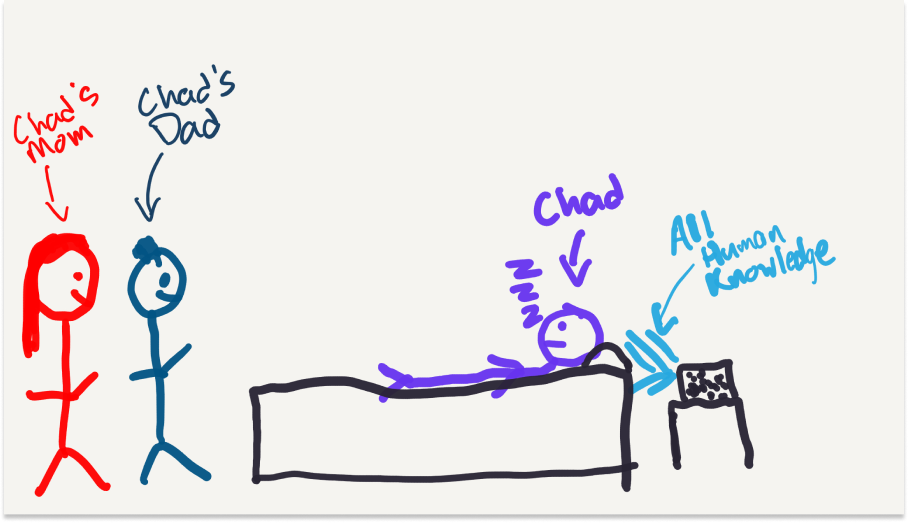

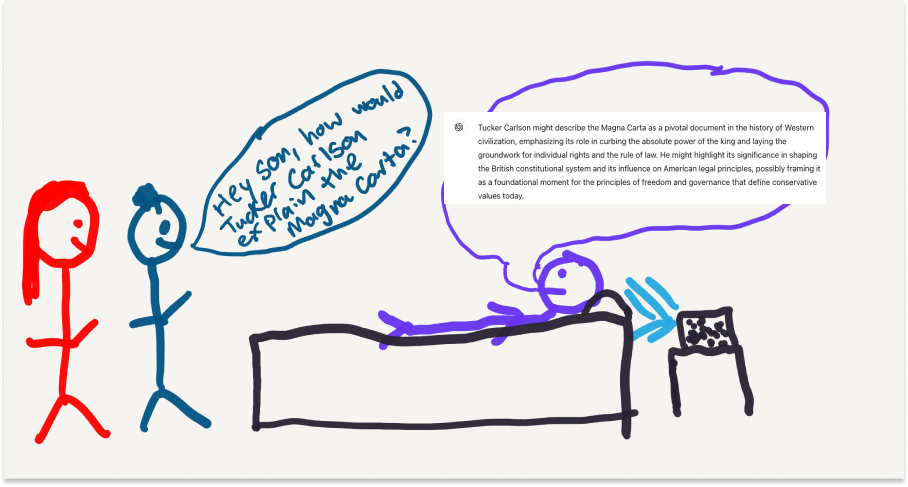

想象一位聪明的高中生。我们叫他查德。

查德完全无精打采。没有动力,没有目标,没有干劲。大多数时候,他躺在床上睡觉,而他的父母则用床边的小喇叭以超高的速度播放所有人类知识。不知何故,查德吸收并记住了所有知识。

偶尔,查德的父母会叫醒他并问他问题。他小时候会语无伦次地胡言乱语,但你可以看出他已经很接近了。现在他长大了,吸收了更多的信息,他可以滔滔不绝地说下去,而且无论父母问什么,他通常都能回答正确。

如果你是查德的父母,你会说,“天啊,它真的起作用了。”

你会获得所有你能获得的音频知识,并通过扬声器播放。你会以不同的音量播放。你会剔除所有不良信息。你会给他喂超级食物,医生建议这些食物可能有助于让他的大脑变得更大。你会付钱给聪明人,让他们记录下他们如何思考真正困难问题的详细说明,这样他就能学会如何思考,而不仅仅是思考什么。你会睁着他的眼睛,同时向他播放 YouTube 上的所有内容。你甚至可以给查德买一个外骨骼,让他穿上,从床上下来,进入现实世界,在那里他可以做一些物理的事情,并吸收更多关于世界如何运作的信息。

而且一切都很顺利!Chad 不断学习。他可以用外骨骼搬动沉重的箱子,甚至在你向他要健康食品时递给你一个苹果。当邻居问他问题时,他都能正确回答,即使是非常难的问题,比如一天问“你能帮我们解决这个蛋白质折叠问题吗?”,第二天问“你能为我正在处理的这笔并购交易写一份复杂的法律协议吗?”。Chad 是一位非常聪明的高中生,你为此感到非常自豪。

但内心深处,你有点担心。因为无论你做什么,无论你向他透露多少或什么样的信息,无论你买了多好的外骨骼,查德似乎都不在乎。他似乎什么都不想要。你父母的直觉告诉你,查德与其他高中生非常不同。见鬼,在某些方面,他与学龄前儿童非常不同。

相对而言,学龄前儿童比较笨。他们几乎不能造句句子。他们不会做基本的乘法。但他们知道自己想要什么。他们早上起床,叫醒父母一起玩。他们上学,和其他孩子一起玩,他们甚至发明了自己的游戏和语言,而没有人告诉他们。当有人对他们不好时,他们会难过,当有人给他们一个冰淇淋甜筒时,他们会欣喜若狂。

他们有行动者和目标,即使这些目标很小:吃冰淇淋、买新玩具、熬夜等等。

随着孩子长大,这个机构和目标也会随之扩大。

如果查德能起床去上学,那些愿意成为他同学的高中生都很疯狂。周末,他们会偷偷溜出去,偷父母的车,参加派对,试图亲吻其他疯狂的高中生。在一周的时间里,他们开始想清楚自己想要做什么——他们想去哪里上大学,什么让他们着迷,他们想对世界产生什么样的影响。他们远不如查德聪明,但他们有一种你在非常聪明的男孩身上从未见过的活力。

如果查德真的想有所成就,你就得想办法让他更像其他孩子,有自己的目标和愿望,甚至早上自己起床,开始做事,不需要别人的吩咐。但无论你怎么努力,你都做不到,所以你专注于你能做的事情:让查德变得非常聪明。

也许,你希望,在某个时候,如果他足够聪明,他就会看到其他孩子都想要东西、做事情,然后开始自己想要东西、做事情。

但与此同时,你的邻居开始发现查德越来越聪明,并开始向他寻求各种帮助。

“嘿,查德,你能帮我写这份营销文案吗?”邻居吉尔问道,然后查德就这么做了。

邻居吉姆问道:“查德,我的孩子,你能帮我研制一些药物吗?”吉姆答应了。

邻居们对查德的帮助非常高兴,他们开始付给你很多钱,而且,因为你爱你的儿子,所以你把这些钱花在更多、更复杂的教育上,希望有一天,他能开始表现得更像正常孩子,并且你知道,无论如何,他越聪明,你的邻居就会付给他越多。

这种方法确实有效,查德变得越来越聪明。如果你问他聪明与否,他比所有大学生都聪明,甚至比所有博士都聪明。

他能做的事情越来越多。最终,几乎任何时候邻居要求他做某事,无论是脑力劳动还是体力劳动,他都可以做,只要他听过某人做过类似的事情。

这对你的小镇来说是个好消息。随着你的邻居利用 Chad 做越来越多不可思议的事情,它将成为世界上最富有的小镇,也是历史上最富有的小镇。唯一限制你小镇发展的是你的邻居要求 Chad 帮忙解答的问题的创造性。

但可怜的查德,他只是无精打采地躺在床上,等待被叫醒去帮忙处理下一个请求,也不关心是否有人再次叫醒他。

查德 (Chad) 是真正的男孩吗?

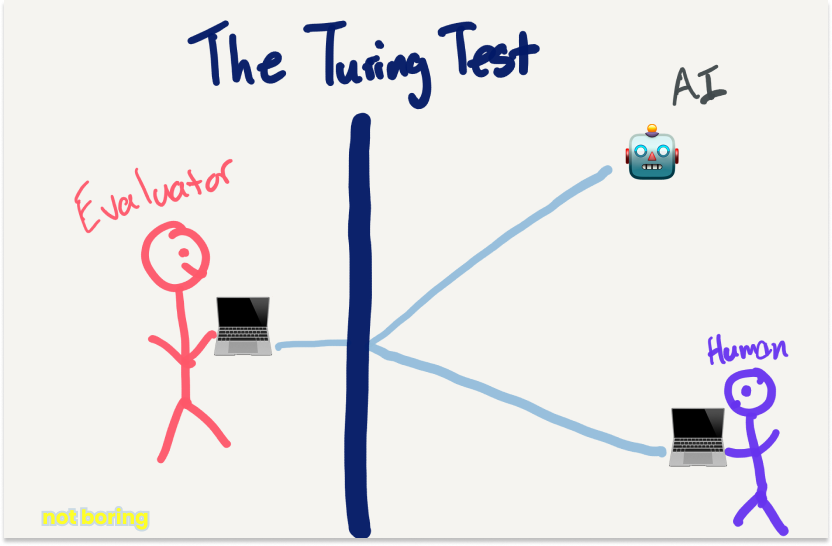

人们想出了很多方法来判断人工智能是否是通用人工智能。最著名的方法就是图灵测试:评估者通过计算机与人类和人工智能聊天,如果评估者无法分辨,那么人工智能就表现出了类似人类的智能。

现代经过精细调整的 LLM 可以轻松通过图灵测试,但却无法通过嗅觉测试。

嗅觉测试就像:我真的认为我对面的那个东西实际上是人类吗?

我们称之为 AGI(通用人工智能)——一种在所有智力任务上都能匹敌人类通用智能的人工智能——或者 ASI(超级人工智能)——一种超越人类智能并能够自我提升的人工智能。这种暗示和恐惧是如此强大,以至于我们今天所做的绝大多数事情都不再需要人类了。

因此人们不断改变目标,将 LLM 与 SAT、国际数学奥林匹克等进行对比测试。

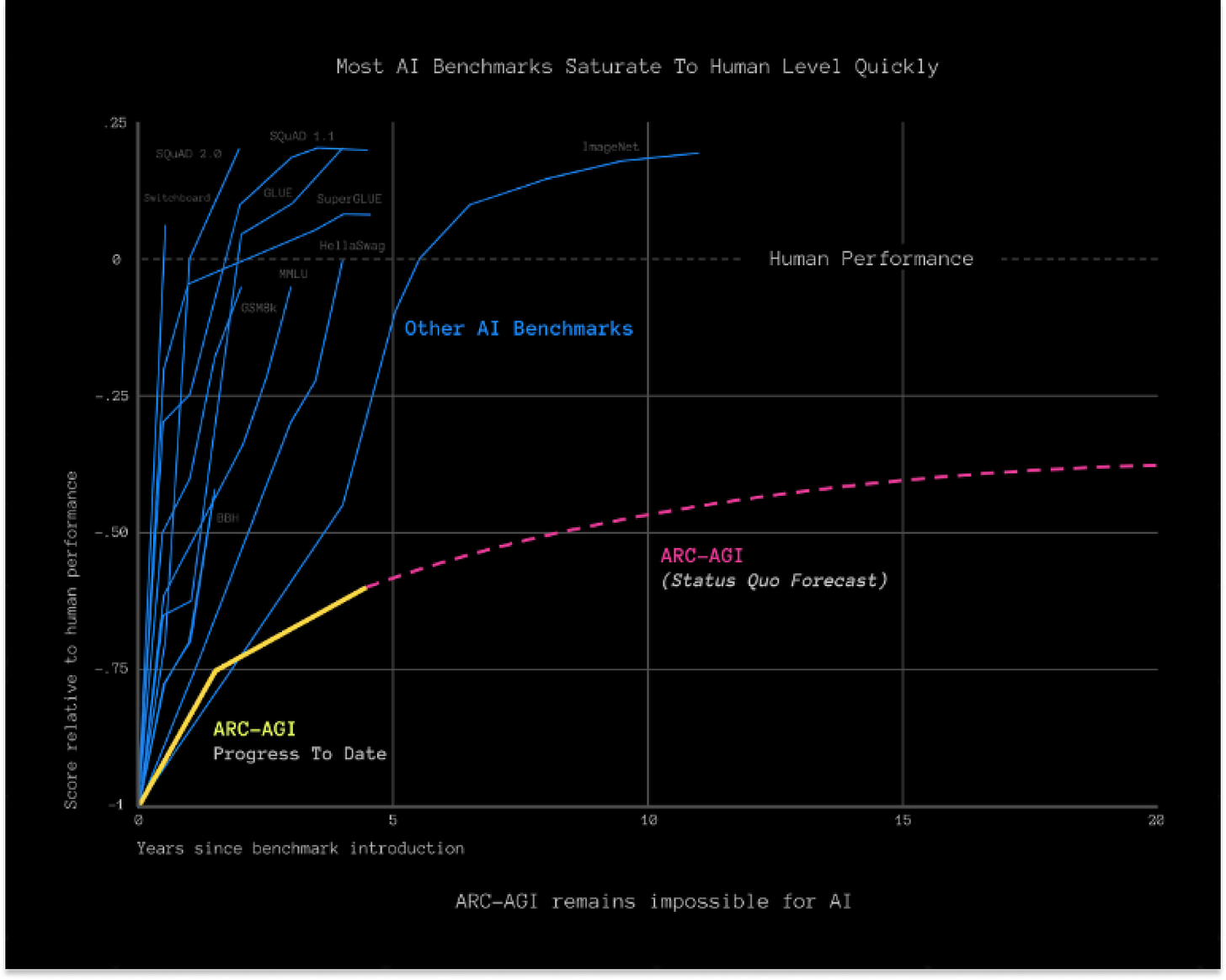

在另一集 Dwarkesh中,谷歌人工智能研究员Francois Chollet认为,法学硕士不是通往 AGI 的道路,因为它们只记忆,不推理。他提出了一项测试——ARC -AGI 基准——该测试将为模型提供前所未有的简单问题,作为 AGI 的真正测试。

ARC 奖

ARC 奖

但无论查德能否在 SAT 考试中取得高分或解答 ARC,我仍然认为他没有通过嗅觉测试。你可以想象镇上的人们在背后窃窃私语:“这孩子有点不对劲。”他很聪明,但他们能嗅出来。

(注:这句话是我在昨天下午 2:12 之前写的,当时Ryan Greenblatt 使用 LLM 在 ARC-AGI 上取得了 71% 的成绩。我坚持认为,解决任何特定测试都无法通过嗅觉测试。)

利奥波德在《情境意识》中提出的论点有很多值得欣赏的地方。相信曲线是一种美妙的简单。我喜欢相信曲线。我写了一整篇文章来探讨技术指数之美。在长弧曲线与人为分析的较量中,我选择了曲线。

但正如那句老话所说:相信(曲线),但验证(映射)。

信任但要验证

威廉·赫特林 (William Hertling) 于 2012 年在布拉德·菲尔德 (Brad Feld) 的博客上发表了一篇很棒的文章,《如何预测未来》。这篇文章主要讲的是信任曲线,具体来说,就是信任硬件曲线。

1996 年,赫特林绘制了调制解调器速度图表,预测流媒体视频将在 2005 年实现。九年后,即 2005 年 2 月,YouTube 诞生了。

他预测流媒体音乐将在 1999 年或 2000 年问世。Napster 确实在 1999 年问世。

在 2012 年的那篇文章中,他追踪了一段时间内每秒数百万条指令 (MIPS),并预测:

通用计算机什么时候才能模拟人类水平的智能?2024 年至 2050 年之间,具体取决于对人类智能复杂性的估计,以及用于模拟它的计算机数量。

而且,根据你选择的对人类智能复杂性的估计,他基本上做到了这一点。无论人工智能是否智能,GPT-4(2023 年)在模拟人工智能方面都做得相当不错。

赫特林描述了他用来预测未来的三个简单步骤(重点是我的):

步骤 1:计算年增长率

第 2 步:预测线性趋势

步骤 3:将非线性事件映射到线性趋势

换句话说,绘制迄今为止的年度增长情况,推断未来的增长情况,然后预测未来各个时间点可能出现哪些新功能。

这正是利奥波德所做的,我认为他成功了前两个方面。

从有效计算的 OOM 角度思考人工智能的进步是一项非常有用的贡献,而预测 OOM 可以让你预测很多有用的事情。

虽然像 1000 亿美元甚至 1 万亿美元的集群听起来很疯狂,但它们显然处于曲线上。我有什么资格反对呢?我同意他的观点,即大公司将从人工智能中赚到足够的钱来证明如此大规模的投资是合理的,虽然获取足够的数据和电力来保持曲线继续前进等挑战是真实存在的,但资本主义找到了出路。正如赫特林所写,“通过转换技术,可以克服、绕过或解决限制。”

我们即将拥有越来越强大的人工智能,值得为这个未来做好准备。未来将会有伟大的事情、可怕的事情以及需要解决的事情。

话虽如此,但我不同意他的映射。

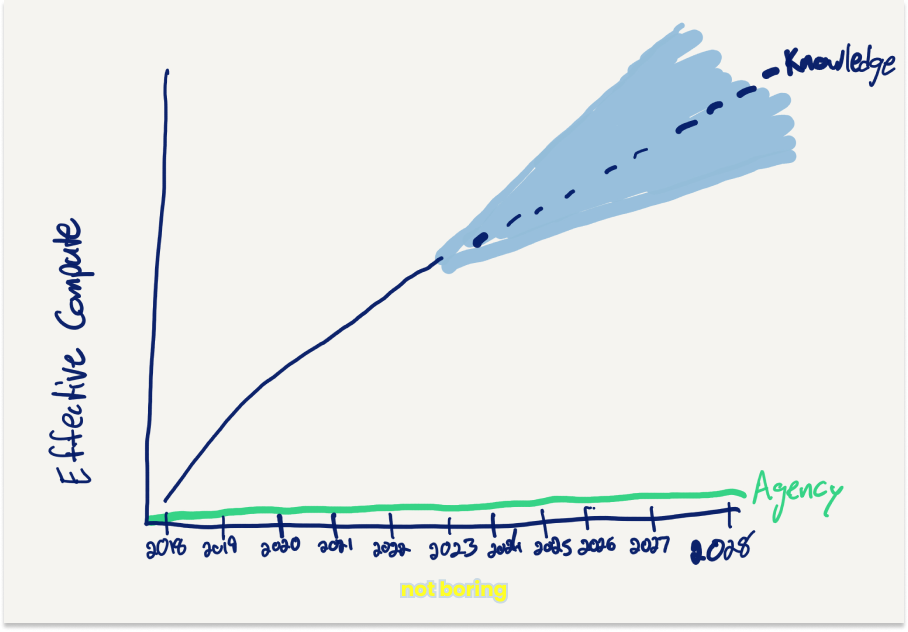

在某些方面,GPT-4 比聪明的高中生聪明得多,就像查德一样。在其他重要的方面,GPT-4 甚至与学龄前儿童甚至婴儿都不在同一水平。他们无精打采。他们没有主动性。他们没有动力。

继续扩大知识规模并不会神奇地扩大代理机构的规模。

我们甚至还没有达到代理曲线的水平。这是一条不同的曲线。

瞧,我对知识和代理的使用有点松散。法学硕士能做的不仅仅是复述知识;即使你让他们有推理能力,但感觉他们仍然没有从法学硕士的扩展中产生人性。他们没有好奇心,也不会问自己的问题。

七年前,凯文·凯利写道:“智力不是单一的维度,因此‘比人类聪明’是一个毫无意义的概念。”这句话值得重复。

GPT-4 在一个维度上是聪明的高中生,而在其他维度上是垫底的高中生。认为加强强项会加强其他维度是危险的。没有一个 A+ 物理系的学生通过成为 A++ 物理系学生而成为明星四分卫。

凯利甚至预见了利奥波德海图,他写道:

大多数技术人员倾向于像尼克·博斯特罗姆在他的《超级智能》一书中那样绘制智力图表——将其绘制成一个逐字的、单维的、幅度不断增加的线性图表。一端是低智力,比如小动物;另一端是高智力,比如天才——几乎就像智力是分贝数的声音水平一样……

这种模型的问题在于它太过神秘,就像进化的阶梯一样。

这并不是说嗅觉测试版本的 AGI 和 ASI 永远不会出现——我确信它们会在某个时刻以某种方式实现——只是看起来我们需要新的路径才能到达那里,而这些路径可能还要遥远得多。

换句话说,你可以相信太阳能会变得越来越便宜和更加丰富,但不必相信太阳能电池板本身会开始产生聚变反应。

这听起来可能像是我过于悲观的看法,但这是我写过的最乐观的事情之一。

如果我的判断正确,我们将再次进入“金发姑娘地带”。

金发姑娘区

人工智能的未来有两条极端的道路:

- 其中一条路径就是我们一直在讨论的:我们很快就会拥有 AGI,然后是 ASI,人类很快就会失去对更高级智能的控制。至少,无论哪个政府控制着从 AGI 到 ASI 的模型,哪个政府都会获胜。

- 另一方面,这一切都是泡沫,随着人们意识到人工智能实际上不会变得更好,泡沫必将破灭。我们不会创造 AGI 和 NVIDIA 坦克。

但还有第三种方式,即金发姑娘区域:我们会得到越来越聪明和能干的帮手,但不会消除对人类的需要,也不会诞生任何想要消灭人类的生物。

这就是同意利奥波德曲线但不同意映射的含义。当你相信图表上的直线而不相信科幻小说时,你就会得到这种结果。

在这种世界观中,人类扮演着重要角色:我们是推动者。

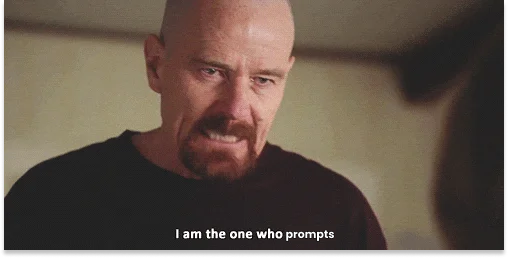

绝命毒师

绝命毒师

我们是提出问题的人,是将代理以具有社会和经济价值的方式串联起来的人,是拥有目标和愿望的人,是请求查德帮助我们解决我们选择解决的问题的人。我们是充满活力和干劲的人,是利用日益强大的人工智能提供的大量新功能的人。

我不是 AI 研究员。我不在实验室里。我不知道 Ilya 看到了什么。但从外部来看,我没有看到任何让我相信其他东西的东西。GPT-4 并不比 GPT-2 更雄心勃勃。我的学龄前儿童仍然比他们两个都更有野心。

除此之外,我们还是处理新事物的人。

Francois 在 Dwarkesh 对话中还提出了另一个非常有趣的观点,与此相关。他说:

多年来,我一直在说两件事。我一直在说,如果你继续扩大深度学习的规模,它就会不断带来回报。与此同时,我也一直在说,如果你继续扩大深度学习的规模,这不会导致 AGI。

我们可以让越来越多的事情实现自动化。是的,这具有经济价值。是的,有很多工作可以通过自动化的方式取代。这具有经济价值。但你仍然不会拥有智能。

所以你可能会问,如果我们能够创造所有这些经济价值,那又有什么关系呢?也许我们根本不需要智能。当你必须应对变化、新奇和不确定性时,你才需要智能。

谁知道他说得对不对。我没有技术上的理由相信弗朗索瓦而不是利奥波德。但最后一点非常有趣:“当你必须应对变化、新奇和不确定性时,你需要智慧。”

在我看来,这是一个非常美妙的想法:即使我们可以让人工智能解决当前存在的所有问题,回答我们目前知道的所有难题,但总会有新的问题(和新的机会)、新的问题需要提出,以及新的知识领域需要探索。

这并不是说越来越强大的人工智能会是完美无害的东西。工具越强大,坏人用工具造成的伤害就越大。用人工智能阻止坏人的唯一方法不是人工智能,而是用人工智能阻止好人。

因此,我非常同意利奥波德的观点,我们需要领先于中国。我非常不同意我们需要将人工智能国有化才能做到这一点。

这条路的风险最大。我们不仅会把有史以来最强大的工具托付给政府(这很可能是真的),而且如果把它从普通人手中夺走,并假设人工智能将成为上帝,我们自己的能力就会萎缩。

因为如果 Francois 是对的,那么我们假设 LLM 永远比我们聪明,会以我们无法理解的方式解决所有真正困难的问题,并且不再像我们人类依赖的那样推动我们自己。这种做法可能在一段时间内有效,直到 LLM 达到他们利用我们训练他们的信息所能达到的极限,他们就会陷入困境,我们再也无法提出新的问题或提出新的理论。

我们不应该因为相信有了足够的知识就会出现超级智能而将法学硕士神化,而应该相信曲线。他们说法学硕士的能力越来越强,发展速度也越来越快。他们并没有说人工智能会突然自我引导。

我们也许能够穿针引线,创造出一个看上去像上帝但又愿意做任何我们要求它做的事情的东西。

治愈癌症。建造生产数十亿台机器人的工厂。加速实现曲速引擎、奥尼尔圆柱和戴森球的进程。

此外,还要帮助那些被人工智能取代工作的人找到新的工作和意义。打击深度伪造。让我们最聪明的人变得更聪明,这样我们才能继续开拓新的领域。

解决旧问题,以及人工智能无疑将引发的新问题,但这一过程将不断向上发展。

假如你能够雇佣一大批越来越聪明、越来越能干的助手,来成倍地提高你的工作效率并拓展你的抱负,那情况会怎样?

完美的员工难道不是比你聪明得多,但出于某种原因,却不想接手你的工作吗?

技术一直是人类的力量倍增器。左边的曲线简单来说就是它将继续发挥作用。

它看起来不太像“终结者”,而更像石油。

人工智能是新石油

2006 年,英国数据科学家 Clive Humby 创造了“数据是新石油”这句话。自那以后,数据就被开采殆尽。尽管数据的价值一如既往,但真正的新石油可能是人工智能本身。

我一直在读丹尼尔·耶金的普利策奖获奖作品《奖品:石油、金钱和权力的史诗之旅》,这是有史以来最好的石油史著作。读一读吧。

自 1859 年德雷克在宾夕法尼亚州泰特斯维尔发现石油以来,石油曾引发过战争,也曾带来过失败,带来了财富,引发过冲突,增加了世界 GDP,并使以前无法想象的事情完全成为可能。石油一直是无数政府部门的首要任务,也是我们当前生活水平的主要非感知因素。

但石油是一种商品。石油之所以如此珍贵,是因为那些发现、开采、提炼、分配和利用石油的人。

我认为 20 世纪 40 年代到 70 年代的石油繁荣可能是未来的最佳例证。

私营公司正在投资数百亿美元进行探索。激烈的竞争导致价格下降,模式商品化。对手之间(当时的美国和苏联,现在的美国和中国)存在国际竞争,甚至友好公司之间也在竞相开发自己的资源。

正如Yacine 在 X 上指出的那样,“这些公司将成为其所在国的国有资产。Openai 董事会的混乱并非偶然。加拿大有 cohere,法国有 mistral,日本有 sakana。”

就像各国需要不惜一切代价控制本国石油供应以促进竞争和发展一样,各国也需要控制其对前沿模型的获取。这不一定是因为 ASI 会让其所在国无所不能,而是因为前沿模型对于一个国家的发展、进步,当然还有安全来说都至关重要。

当时,石油让原本毫无生气的机器焕发了生机。汽车、洗衣机、飞机和空调在注入“黑金”后便焕发了生机。但汽车在拥有更多或更优质的石油的情况下,并不比油箱空了的情况下更容易自行行驶。

如今,人工智能赋予了这些机器学习、行动和适应的能力。但是,即使有了更大或训练得更好的模型,汽车也不太可能为自己规划一次自驾游。

当我们要求机器为我们做某事时,石油和人工智能都能让我们从机器中获得更多。

那么,如果人工智能是新的石油,我们预计未来十年将会是什么样子呢?

周末,我在阅读《奖赏》时,看到了这段话,它让我恍若水晶球。我将分享整个章节,因为我认为它可能是一个恰当的类比,用以描述我们正在进入的这个时期,即我们对智能(当然是非人类的)的影响,就像战后石油繁荣对能源的影响一样:

爆炸式增长 1949 年至 1972 年间,世界能源总消耗量增长了两倍多。然而,这一增长与石油需求的增长相比显得微不足道,同一年,石油需求增长了 5.5 倍多。世界各地对石油的需求增长都很强劲。1948 年至 1972 年间,美国的石油消耗量增长了两倍,从每天 580 万桶增至 1640 万桶 — 这是前所未有的,除非与其他地方的情况相比。同一年,西欧对石油的需求增长了 15 倍,从每天 97 万桶增至 1410 万桶。在日本,变化非常惊人;石油消耗量增长了 137 倍,从每天 3.2 万桶增至 440 万桶。

是什么推动了全球石油使用量的激增?首先是快速而强劲的经济增长和随之而来的收入增长。到 20 世纪 60 年代末,所有工业化国家的人口都享受着 20 年前似乎远远无法企及的生活水平。人们有钱可花,他们用这些钱买房子,买室内电器、取暖的中央供暖系统和降温的空调。每个家庭买了一辆汽车,然后又买了第二辆。美国的机动车数量从 1949 年的 4500 万辆增加到 1972 年的 1.19 亿辆。在美国以外,增长更为惊人,从 1890 万辆增加到 1.61 亿辆。为了生产汽车、电器和包装商品,为了直接或间接地满足消费者的需求和愿望,工厂必须生产越来越多的供应,而这些工厂越来越多地依赖石油作为燃料。新兴的石化工业将石油和天然气转化为塑料和一系列化学品,在各种应用中,塑料开始取代传统材料。在 1967 年的电影《毕业生》中有一个令人难忘的场景,一位老人向一位对自己的未来犹豫不决的年轻人透露了成功的真正秘诀:“塑料”。但那时,这个秘密已经随处可见。

20 世纪 50 年代和 60 年代,石油价格一路下跌,直至变得非常便宜,这也极大地促进了石油消费量的膨胀。许多政府鼓励使用石油来推动经济增长和工业现代化,以及实现社会和环境目标。石油市场如此迅速增长还有一个原因。每个石油出口国都希望提高石油销量,以获得更高的收入。许多国家使用各种激励和威胁手段,不断向其特许经营商施压,要求他们生产更多石油,而这反过来又给了这些公司强大的动力,让他们大举进军他们能找到的任何新市场。

石油产量、储量、消费量等数字都指向一件事:规模越来越大。石油工业在各个方面都变得庞大无比。因为,如果没有基础设施,产量和消费量的增长就不可能实现。大量新炼油厂被建造,规模越来越大,因为它们旨在服务于快速增长的市场,并追求规模经济。新技术使一些炼油厂能够将高价值产品(汽油、柴油、航空燃料和取暖油)的产量从每桶原油的不到 50% 提高到 90%。结果,喷气式飞机、柴油机车和卡车以及家用燃油取暖器被彻底改造。油轮船队成倍增加,传统尺寸的油轮让位于被称为超级油轮的巨型海上机器。越来越复杂的加油站出现在整个工业世界的十字路口和高速公路沿线。越大越好——这是石油工业的主导主题。“越大越好”也让石油消费者着迷。美国汽车由巨大的发动机驱动,并装饰有镀铬和奢华的尾翼,车身越来越长、越来越宽。每加仑汽油可以行驶八英里。

毫无疑问,世界将会发生巨大的变化,但我只是愚蠢地相信它会变得更好,就像人类发现、提炼和开采石油一样。人工智能是一种燃料。

这并不是基于深入的科学研究,也不是对现有文献的回顾。我并没有参加旧金山的聚会,人们在那里一边喝着促智鸡尾酒,一边随意地分享价值数十亿美元的训练秘诀。这是一种直觉,我想你可能也有这种感觉。

人工智能是一种非常有用的软件,但它与人类相差甚远。你见过人类。你使用过人工智能。你对他们的感觉和人类有一点点相似吗?

或者这样说:如果 OpenAI 团队真的相信他们即将诞生上帝,他们会同意在每部新 iPhone 上都发布一个链式版本吗?

这感觉就像是石油行业常见模式的最后一步:发现、钻探、提炼、分配。

这很有意思。写完这一部分后,我继续阅读,发现更多相似之处,比如石油公司之间为推销产品而展开的竞争。拥有井口(抽取石油的地方)是成功的一半,但拥有分销渠道也同样重要。石油公司销售的是奇迹产品,但这是一个商品奇迹。耶金写道:

然后是汽油添加剂引发的轩然大波。他们的目的是为汽油这种产品打造品牌识别,毕竟,汽油是一种商品,无论其品牌名称如何,都或多或少是相同的。在 20 世纪 50 年代中期的一年半时间里,十四家顶级营销商中的十三家开始销售新的“优质”汽油,竞相以夸张的宣传超越对方。

这听起来熟悉吗?石油确实以夸张的方式重塑了世界。它催生了郊区、汽车旅馆、商业航空旅行等各种事物,这些事物以约翰·洛克菲勒本人从未预料到的方式重塑了世界。人工智能也会这样做。但重要的是要考虑到,领先的人工智能实验室可能会竞相超越彼此,提出夸张的要求,以分发(超级惊人的)商品产品。

为什么这有关系?

当我听到利奥波德和弗朗索瓦的对话时,我问了自己一个问题:这为什么重要?

谁在乎我们到底如何定义 AGI,或者 LLM 是否是实现 AGI 的途径?整个争论只是书呆子们互相嘲讽的玩笑吗?

我基本上避免撰写有关人工智能的思考文章,因为我不确定这个问题的答案,但当我写这篇文章时,我认为这很重要,原因如下:

首先,这些对话影响政府对待人工智能的方式。

如果人工智能是上帝,或者至少是世界从未见过的超级武器,那么政府就应该将其国有化、封锁并彻底监管。

如果是石油,他们应该尽一切努力鼓励和促进其发展,以确保他们的国家获得强大的商品和围绕其众多应用的创业创造力所带来的经济和安全利益。

其次,它们影响人们如何看待自己在未来世界上的地位。

如果人工智能是神,或者至少是在所有方面都优于我们的超级智能,那么我们很容易放弃,并认为我们现在为改善自己所做的任何努力都将是徒劳的。这听起来很疯狂,但人们确实因为气候变化而决定不生孩子;想象一下,当他们认为未来将由超级智能机器掌握时,他们会做出什么决定。

如果是石油,人们就应该开始思考如何利用石油来推动他们所做的事情。石油并没有自发地发展郊区;像威廉·莱维特这样的人意识到,汽油驱动的汽车意味着更多的人可以住在有院子和白色栅栏的房子里。我们想象中的美国梦要归功于石油,有了新的石油,人类就可以梦想新的美国梦。

石油带来了自身的挑战。人们失业。国家之间爆发战争。石油颠覆了旧生活方式,取而代之的是新生活方式。人工智能可能也会这样做。但只要人们相信情况并非无望,挑战是可以克服的。认识到人工智能就是石油意味着要摒弃夸张,这样人们才能应对它带来的真正挑战。

人类的创造力是最宝贵的资源。我们发现并提炼了石油。我们创造了人工智能。

尽管那些竞相分销自己品牌的人工智能的人这么说,但我还没有看到任何证据表明人工智能将在短期内匹敌、更不用说取代创造火花。

这并不是说人工智能没有取得令人难以置信的快速进步。它确实取得了进步。昨天,DeepSeek 在编码排行榜上名列前茅,Runway 推出了令人惊叹的 Gen-3 Alpha 视频生成器,Ryan Greenblatt 使用 LLM 在 ARC-AGI 上取得了上述进展。就在昨天。

只能说这很棒。进步意味着增长。我们将需要一架又一架的芯片和一千兆瓦又一千兆瓦的新能源产能。这会带来很多好工作。

因此,请引入可以解决物理问题的模型,可以推理从未见过的问题的模型,可以帮助治愈使用旧工具困扰科学家的疾病的模型,甚至,当我要求时,引入可以比我更好地阐述整个论点的模型。

让人类不断突破新知识的界限,拓展我们雄心壮志的边界,并设定更大的目标以匹配我们日益强大的工具。

我敢打赌,我们将从 2071 年开始回顾这一时期,就像人们回顾 1971 年发现石油一样。

嘿,这是一个很容易下注的赌注:如果我错了,如果 AGI 构建了杀死我们所有人的 ASI,你就不会在我面前炫耀它了。为我找一个足够聪明的人工智能来下这个赌注。

感谢我的 AI 编辑 Claude Opus,在我提出反馈时给予我反馈。

今天就到这里。我们将于周五向您的邮箱发送“每周一期”消息。

谢谢阅读,

派基