揭秘 WEEX Labs AI 实验室:我们是如何组建一支“全 AI 员工”团队的?

WEEX Labs AI实验室通过OpenClaw系统构建多智能体协作团队,实现从指令驱动到任务驱动的转变,涵盖任务统筹、研究、编程、撰稿和审计等功能,并设置安全机制保障效率与安全。

在人工智能飞速演进的今天,AI 已经从单纯的“聊天工具”进化为能够自主思考、协作并交付成果的“数字劳动力”。近期,WEEX Labs 正式开启了内容转型,深入探索 AI 与加密领域的深度融合 。在我们的内部实验室中,一场关于 Multi-Agent(多智能体)协作系统 的创新实战正在改变我们的生产方式 。

从“问答机”到“工作伙伴”:OpenClaw 的降维打击

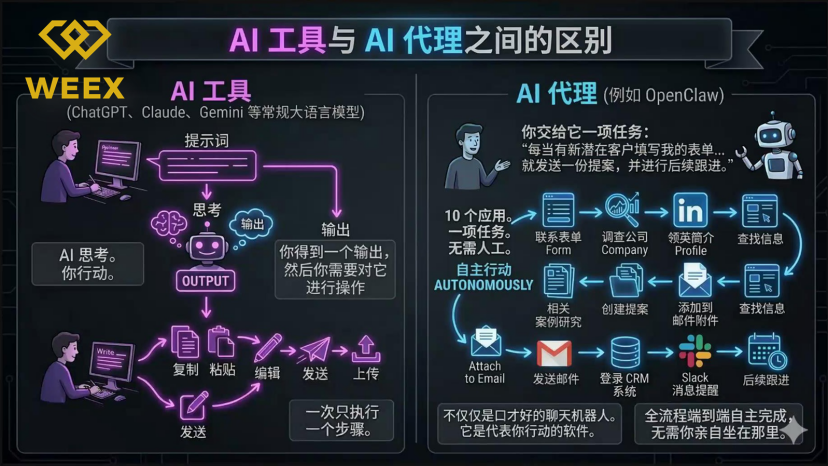

传统的 AI 工具(如常见的 LLM 网页版)通常以问答形式运作,用户给出一个指令,AI 返回一个结果。这种模式虽然高效,但依然高度依赖人类的步步引导。

而 WEEX Labs 采用的 OpenClaw 系统则完全不同。我们将它视为可以下达复杂任务的“工作伙伴” 。它能够根据一个终极目标,自主延伸出执行路径,并调用各种技能完成专项任务 。这种从“指令驱动”到“任务驱动”的转变,正是 AI 时代的真正变革。

WEEX AI 团队的职能架构:各司其职,高效协作

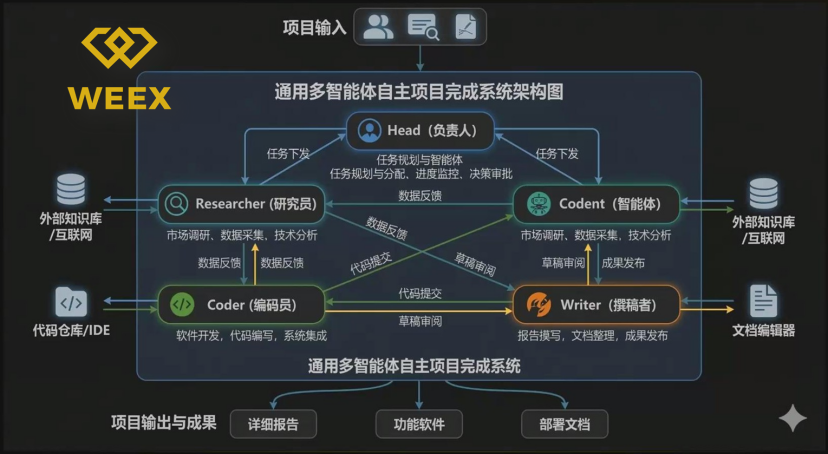

在我们的实验中,负责人亲自在云端环境部署了 OpenClaw,并选择 Discord 作为这支 AI 团队的“数字化总部” 。通过将不同的功能专案设置为独立频道,我们构建了一个结构严明的 AI 团队架构 :

• Leader Bot(任务统筹者): 负责全局任务的拆解与计划洞察,通常由高阶模型驱动,确保团队方向不跑偏

• Researcher(研究员): 深入互联网和链上数据,抓取前沿资讯与市场动态

• Coder(编程员): 负责利用 API 实现功能集成,比如现货/合约交易的行情盯盘与预警功能

• Writer(撰稿员): 专注于内容的洗稿、排版与创意表达,将枯燥的数据转化为可读性强的文章

• Critic(批评者/审计): 这是团队中最关键的角色,负责梳理矛盾点并推动团队修正错误,解决单一 AI 容易出现的“记忆混淆”问题

效率与安全的双重保险:安全刹车机制

组建 AI 团队并非没有挑战。由于 AI 智能体之间可能出现“重复对话”导致的费用叠加(即雪球效应),WEEX Labs 制定了严格的成本与安全规范。

我们通过设置“安全刹车机制”,限制了 API 调用频率和失败重试次数(如最多 3 次失败即停止执行),并引入预算警告系统。在拥抱 AI 效率的同时,WEEX 始终将安全性(Security-First)作为核心准则,确保资产与数据的绝对安全。

WEEX Labs 的 AI 愿景

WEEX Labs 并不满足于仅仅使用 AI,我们致力于成为 AI 赛道的观察者与共建者。目前,我们不仅实现了行情公告的自动化,还在推进直播热点抓取、气氛组 AI 机器人等更多应用场景。

这只是一个开始。未来,WEEX Labs 将持续分享我们在 AI 实验室的实战心得,并计划与更多 AI 领域的 KOL 展开深度合作,共同探索 Web3 + AI 的无限可能。

关于WEEX

WEEX 成立于 2018 年,是一家面向全球用户的加密资产交易平台,致力于为用户提供安全、稳定且易用的交易服务。平台支持现货与合约交易,并配备多重风控体系及全额保险金机制,用于保障用户资产安全。WEEX 目前已与 LALIGA 西甲联赛达成香港及台湾地区的官方区域品牌合作,并在中东、欧洲、拉美、非洲及东南亚等多个市场持续推进合规化与本地化布局。随着 Web3 生态战略的不断扩展,WEEX 正持续与全球开发者及用户社区协同发展,推动数字资产交易向更加开放与透明的方向演进。