iPhone本地跑Gemma 4火了,0 token时代还有多远?

谷歌开源Gemma 4系列轻量级多模态AI模型,支持手机端本地运行,具备128K上下文和跨平台高性能推理能力,引发端侧AI应用热潮;但其在复杂Agent任务、工具调用和结构化输出方面存在局限,凸显端云协同演进趋势及对现有API/token商业模式的冲击。

机器之心编辑部

谷歌前几天开源的新模型 Gemma 4,给了业内一个大大的惊喜。

它采用了与 Gemini 3 同源的技术架构,支持原生全模态,在 Arena AI 排行榜上拿到了全球第三,而且有多个型号可以选。几个较小的型号 —— E2B(有效参数 2.3B)和 E4B(有效参数 4.5B)—— 可以直接部署在手机端本地运行,上下文窗口达到 128K,可以说是「可以放进口袋的 Gemini平替」。

不出所料,模型发布后很快就成了手机用户的新玩具。

其中,一个 X 用户的帖子被围观数十万次。他在帖子里放了一个视频,讲述自己如何在 iPhone 上本地运行 Gemma 4,包括处理图片、音频、控制手电筒开关。他表示,Gemma 4 速度快得惊人,感觉像魔法一样。

有人在 iPhone 17 Pro 上量化了这一速度,指出如果手机用的是苹果芯片,那么在针对这套芯片优化的 MLX(苹果的机器学习框架)的帮助下,模型的推理速度可以超过 40 token / 秒。

还有人在三星 Galaxy 上也跑出了类似的速度,而且还是在开启了思考模式的情况下。这让人直呼「快得不真实」。

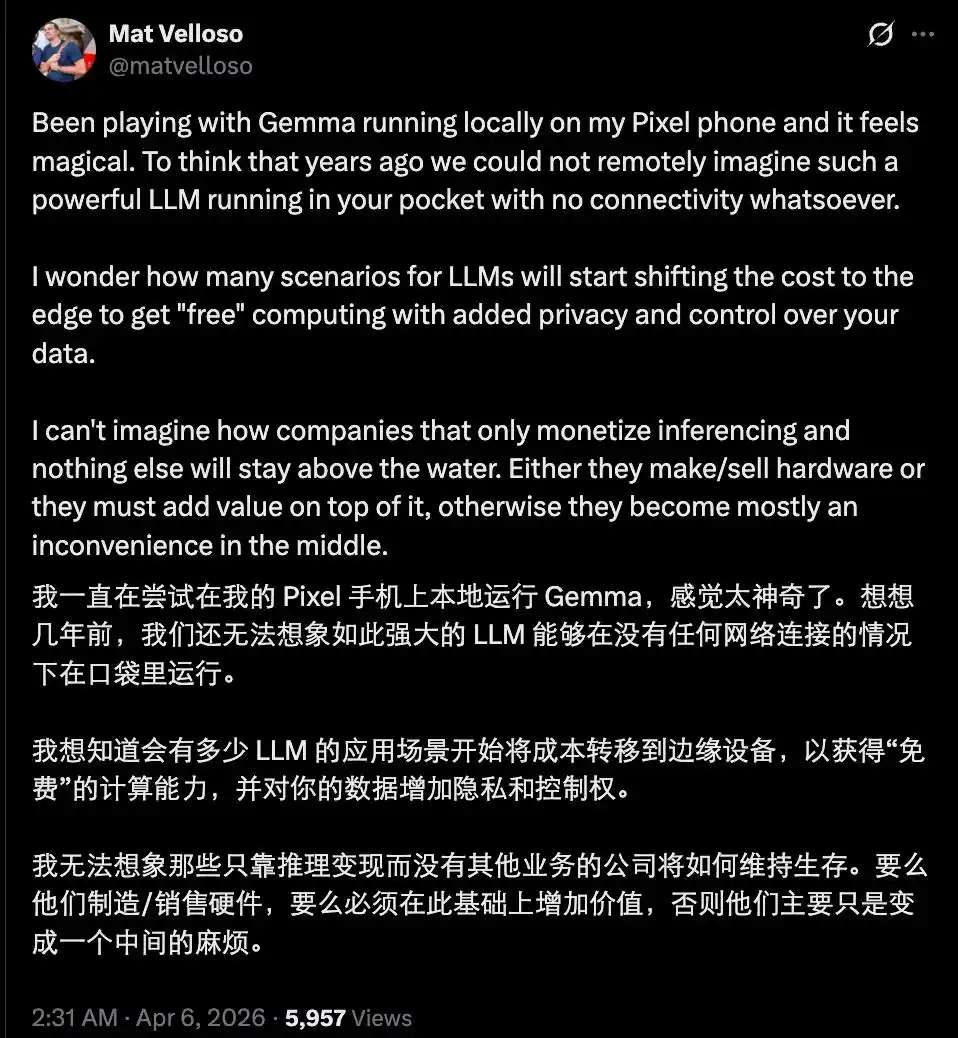

这样的速度让手机端运行 AI 模型成为了未来可以被接受的选项,而且在医疗等敏感场景中非常有用。

128k 的上下文窗口也让这些小模型变得更有吸引力。

那具体怎么运行呢?其实很简单,不是极客专属,因为谷歌发布了官方 App——Google AI Edge Gallery。想在手机上体验的人可以直接下载这个 App,然后下载想要运行的模型版本,之后打开就能跑了。

而且,由于是谷歌官方发布,安全问题自然也不用太担心。

除了这些在手机端运行的小模型,还有人在更强的硬件上尝试了更大的 Gemma 4 版本,比如在 M5 Pro 版本的 MacBook Pro 上运行 Gemma 4 Mixture-of-Experts 26B。

如果是直接对话,这个模型的速度还是很快的,文本生成、代码解释都很顺畅。

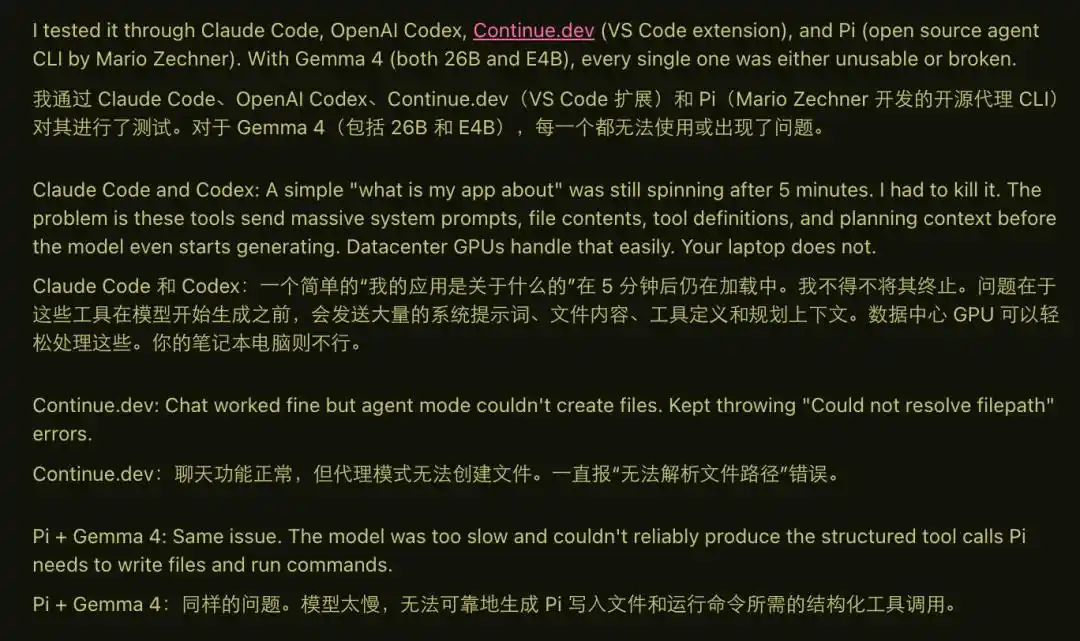

但当他真的将 Gemma 4 当成 coding agent 去用时,问题就来了。因为跑 agent 时需要大上下文(Gemma 4 26B 上下文窗口为 256k)、复杂 prompt 和稳定的工具调用,Gemma 4 在这些地方明显扛不住,经常卡住、报错,或者输出结构不对。

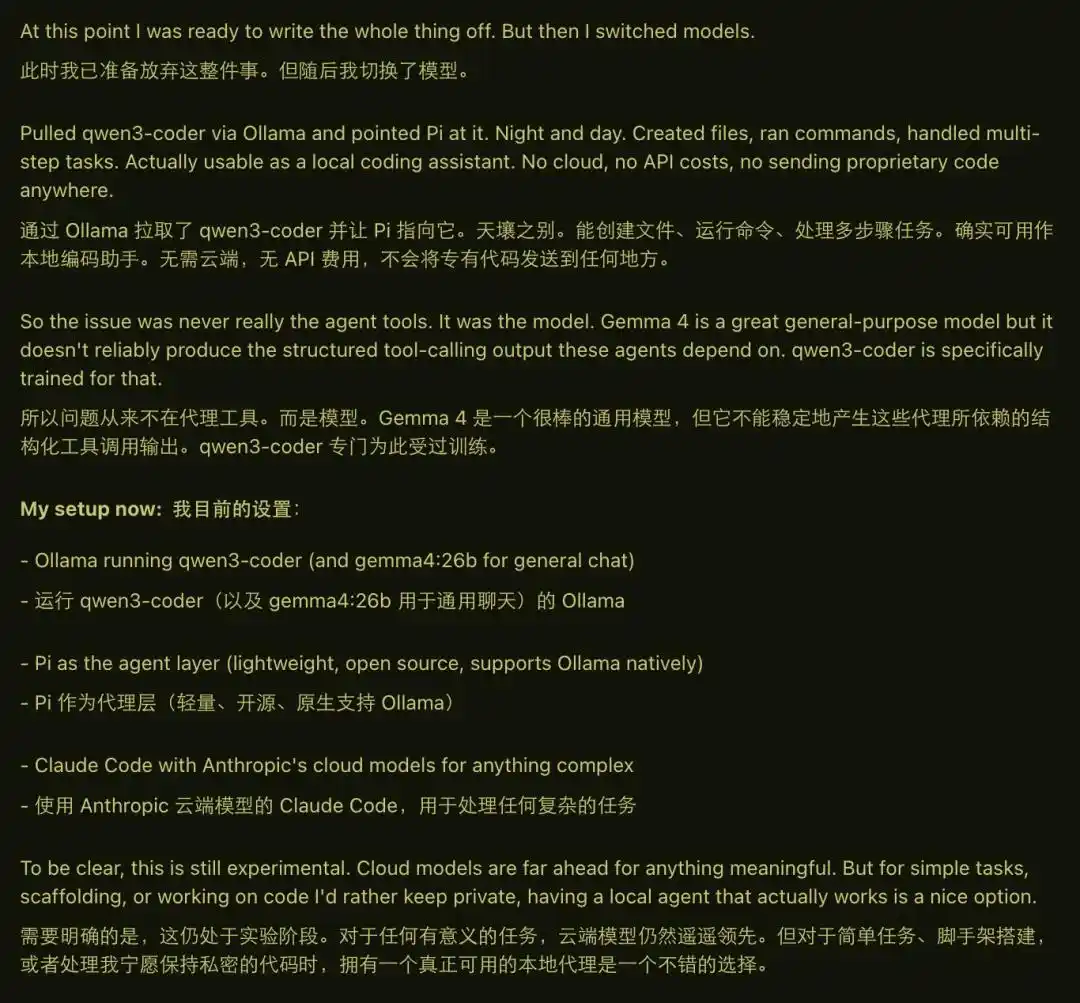

转折点发生在他将模型换成qwen3-coder 的时刻 ,同样环境下,文件创建、命令执行、多步任务都能正常跑。他认为,问题不在 agent 框架,而在模型本身有没有为「工具调用 + 结构化输出」做过优化。在这方面,Gemma 4 可能做得还不够,也有可能这位开发者还没找到正确的用法。

此外,还有人说,Gemma 4 在智力水平上还有点鸡肋。

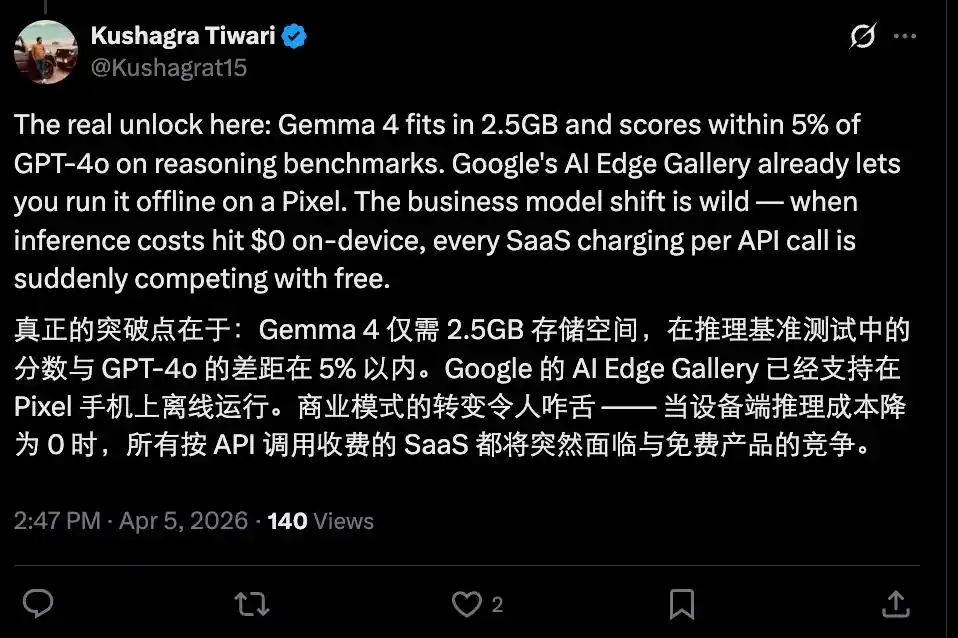

虽然如此,Gemma 4 这种「性能小钢炮」的出现依然不容小觑。如果以后大量的日常查询、聊天、简单推理、代码生成、图像理解任务都可以本地跑了,不再需要买 token,那卖 token 的厂商岂不是处境很尴尬?

当然,当前情况还没有那么悲观,毕竟现在被开源出来的模型和前沿的旗舰闭源模型之间还有差距,而且大部分能打的开源模型依然受制于硬件能力,暂时还没办法在端侧达到可用级别。

但未来的趋势是清晰的。短期看,云端闭源模型在最前沿的复杂推理和超大规模多代理协作上依然领先;但长期看,当硬件继续进步、量化技术继续优化,端侧模型会逐步蚕食云端的高频简单任务。

那些只靠卖 token、卖 API 订阅的厂商,将不得不更狠地卷「真正难啃」的部分 —— 超强 Agent、超长可靠上下文、以及需要海量实时数据的专有能力。

Gemma 4 只是一个开始。下一个惊喜,可能就是某款端侧模型在日常使用中彻底让用户感觉不到「本地」和「云端」的区别。那一天到来时,整个 AI 产业的商业模式,都会迎来一次真正的洗牌。

本文来自微信公众号“机器之心”(ID:almosthuman2014),作者:机器之心