2026斯坦福AI指数报告:美国AI投资规模是中国的23倍,但AI模型基本没差距了

斯坦福大学《2026年人工智能指数》报告揭示全球AI发展现状:中美模型性能基本持平,差距仅2.7%;生成式AI渗透率达53%,企业采用率88%;算力增长迅猛但能耗与用水压力凸显;基准测试可靠性存疑,幻觉率高达94%;AI已开始影响就业,尤其年轻软件开发者;全球监管加速,美欧中路径分化,但监管整体滞后于技术发展。

文 | 智能纪元AGI,作者|林志佳

如果你经常关注AI领域新闻,可能已经感到信息过载:AI是淘金热,AI是泡沫,AI会抢走你的工作,AI甚至连时间都看不懂等。

但就在4月14日凌晨,一年一度的美国斯坦福大学以人为本人工智能研究所《2026年人工智能指数》正式发布,全文共计423页。这份报告将为你拨开迷雾,寻找新的方向。

报告封面图

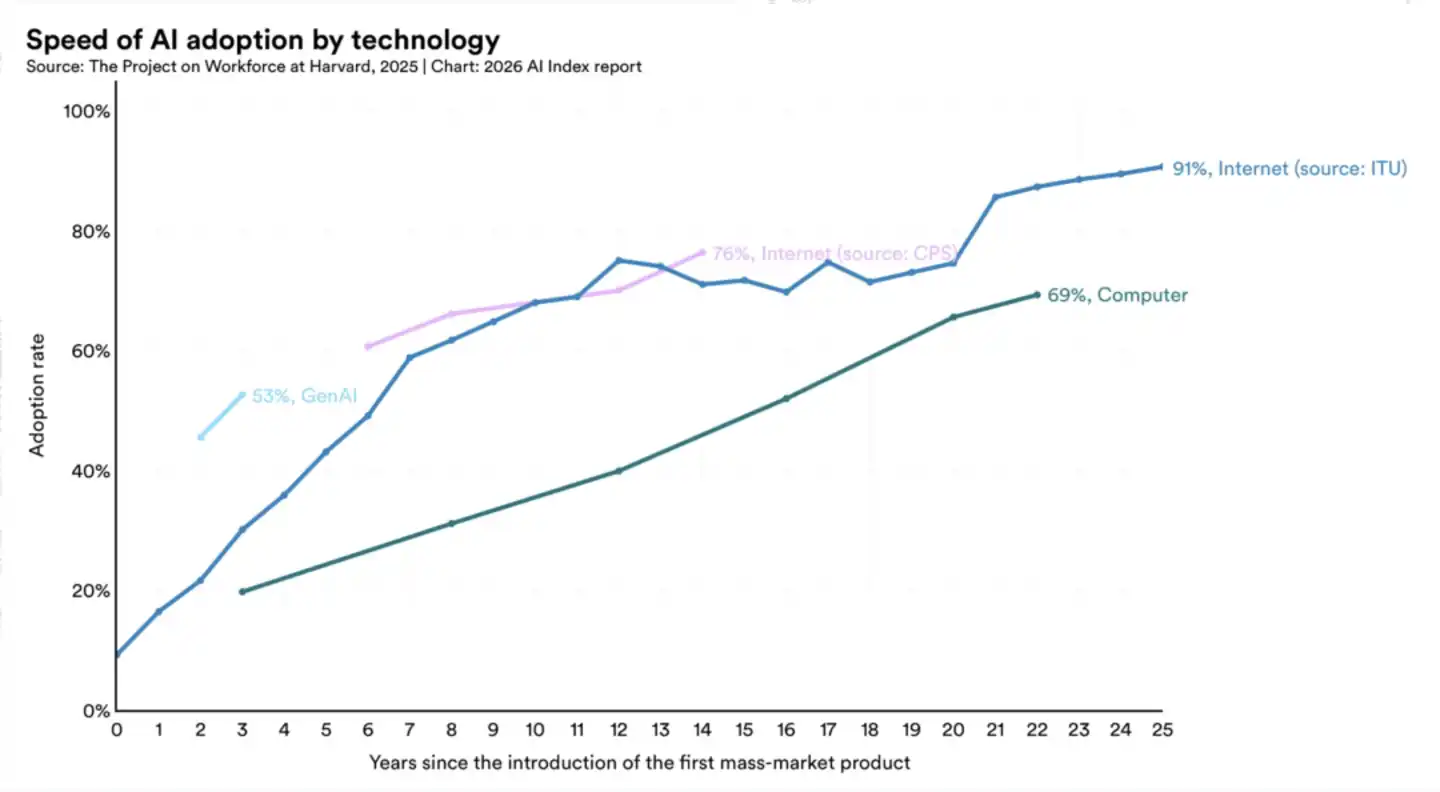

报告指出,AI技术的普及速度空前。过去三年,生成式AI渗透率已经达53%,快于个人电脑与互联网;企业采用率88%,超80%大学生使用生成式AI。

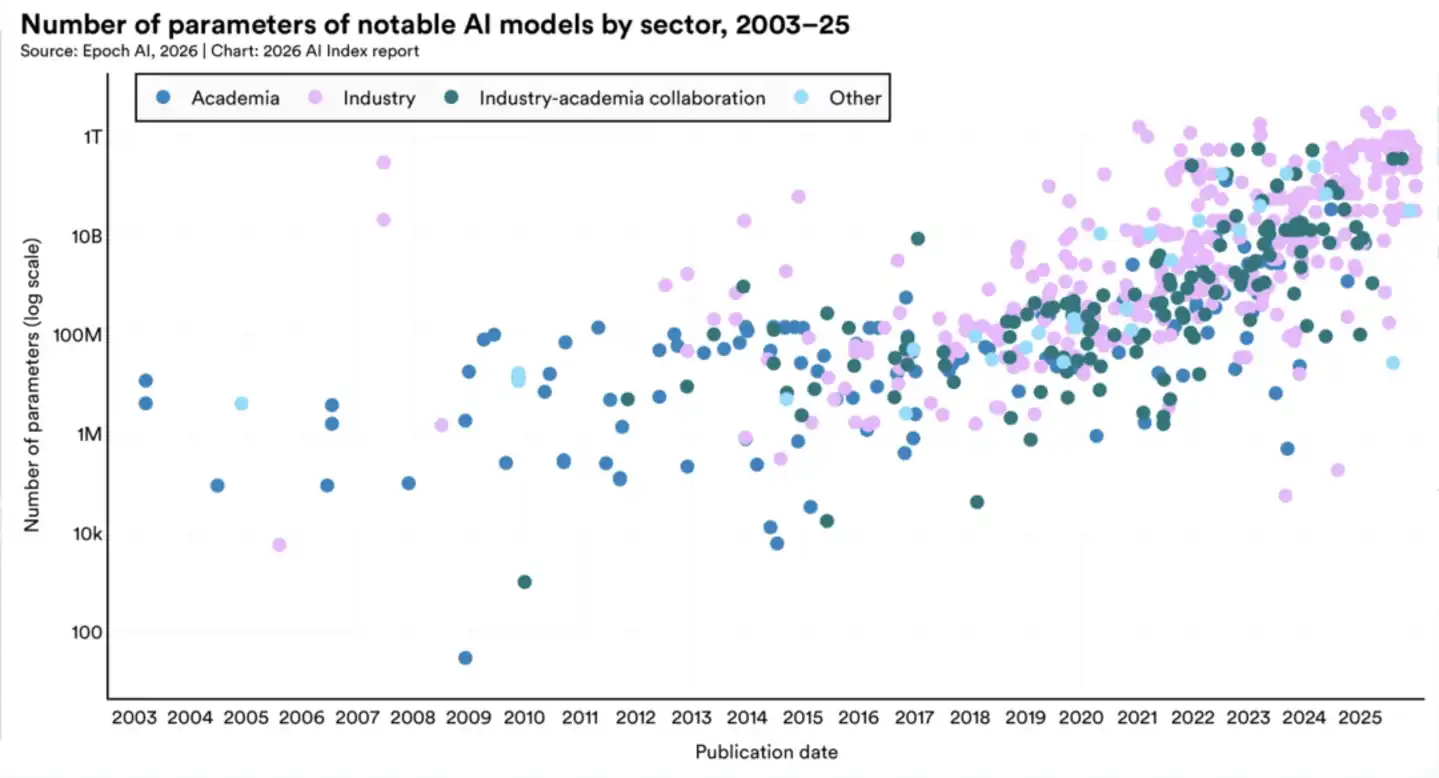

同时,全球处于AI产业主导模型研发。2025年,行业产出超90%顶尖模型,OpenAI、谷歌、阿里为主要贡献者,学术仅占1%。

对于中美AI技术差距,报告认为“基本抹平”,顶尖模型性能交替领先,截至2026年3月,美国模型仅比DeepSeek等中国模型领先2.7%。其中,中国在论文、专利、工业机器人装机量领先,美国在顶级模型、高价值专利、投资领先。

算力层面,全球AI算力自2022年每年增长3.3倍,英伟达占60%以上份额。从训练角度,美国拥有5427个数据中心,依然排名全球第一。

速度的提升并非没有代价。如今,全球AI数据中心耗电量高达29.6吉瓦,足以满足纽约州高峰期的用电需求。仅运行OpenAI的GPT-4o一年的用水量就可能超过1200万人的饮用水需求。

数据显示,AI技术的发展速度已经超过了我们的应对能力。

以下是今年报告中的一些要点:

美国和中国模型技术几乎势均力敌

这场旷日持久、竞争激烈的AI模型竞赛中,中美两国在AI模型性能方面几乎不分伯仲。

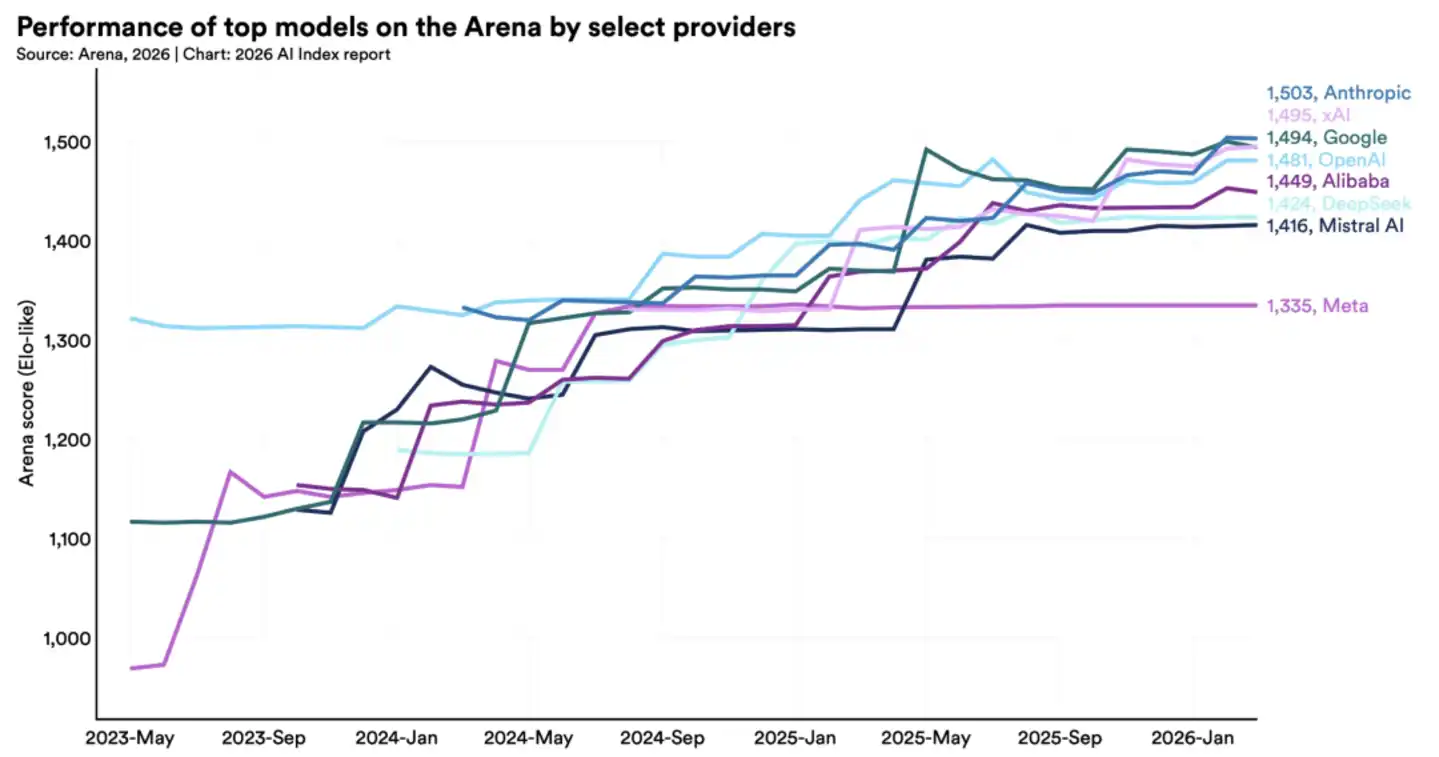

斯坦福AI指数报告引述基准排名平台Arena的数据显示,2023年初,OpenAI的ChatGPT领先,但随着谷歌和Anthropic发布各自的模型,这一差距在2024年逐渐缩小。

2025年2月,DeepSeek开发的AI模型R1一度与美国顶级模型ChatGPT 并驾齐驱。

截至2026年3月,Anthropic领先,xAI、谷歌和OpenAI紧随其后。DeepSeek和阿里巴巴等中国模型仅略逊一筹,但美国模型仅领先2.7%。由于排名靠前的AI模型之间的差距微乎其微,它们现在的竞争主要集中在成本、可靠性和实际应用价值上。

该指数报告指出,美国和中国在AI领域拥有不同的优势。

虽然美国拥有更强大的AI模型、更雄厚的资金以及约5427个数据中心(是其他任何国家的10倍以上),但中国在AI研究论文发表数量、专利数量和机器人技术方面均领先。

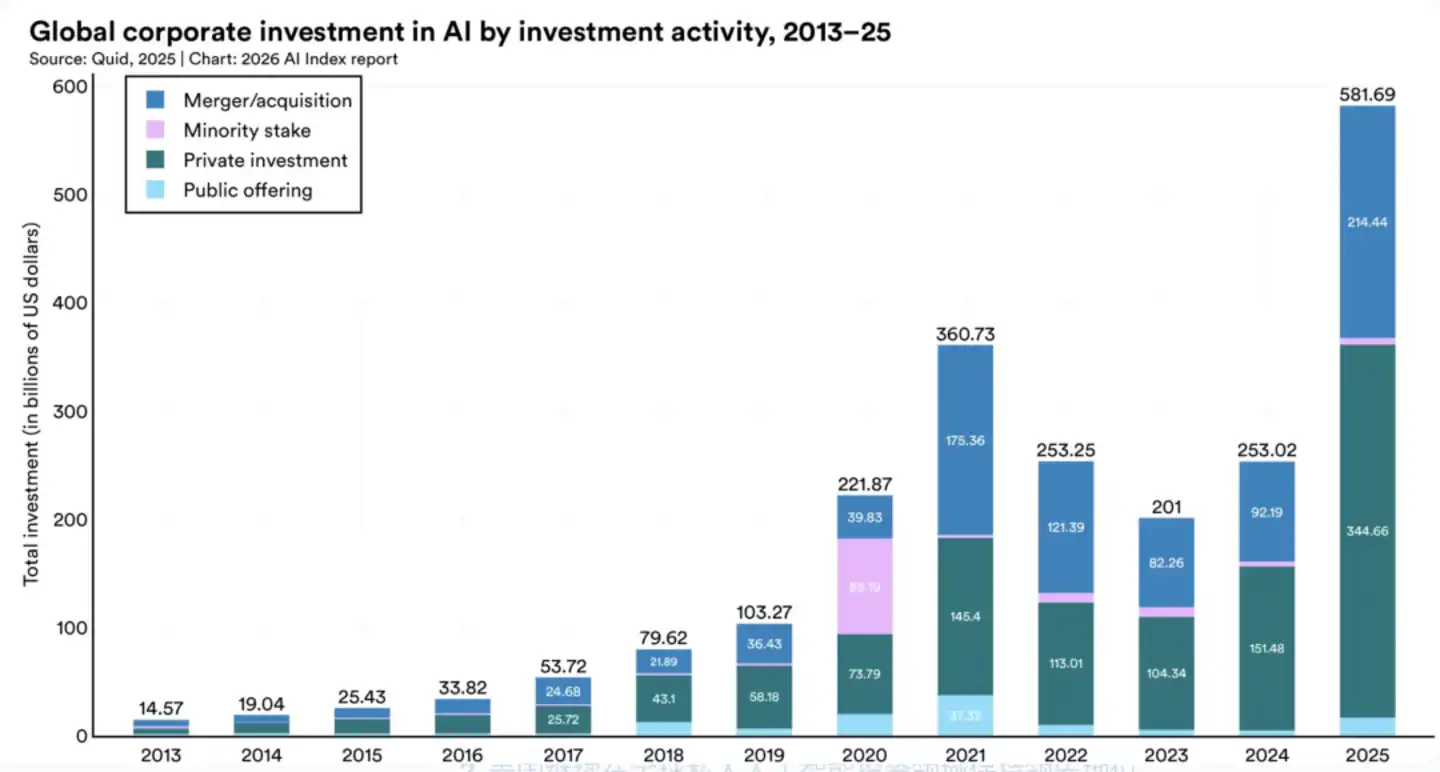

其中,在投资方面,2025年全球AI领域私人(风险)投资增速最快,达到127.5%,目前占总额的60%;而当中,生成式AI引领了这波增长,增速超过200%,占据了近一半的AI风险融资。新获融资的AI公司数量增长了71%,十亿美元级融资事件的数量几乎翻了一番。

从地区角度看,预计到2025年,美国AI风险投资将达到2859亿美元,是中国124亿美元投资额的23倍多——尽管考虑到政府的指导性资金,仅看私人投资数据可能低估了中国在AI领域的总支出。

而且,美国在AI创业活动方面也处于领先地位,预计到2025年将有1953家新成立的AI公司获得融资,是排名第二国家的10倍以上。

然而,自2017年以来的10年间,移居美国的顶尖AI人才(研究与开发人员)数量下降了89%,仅去年一年就下降了80%。

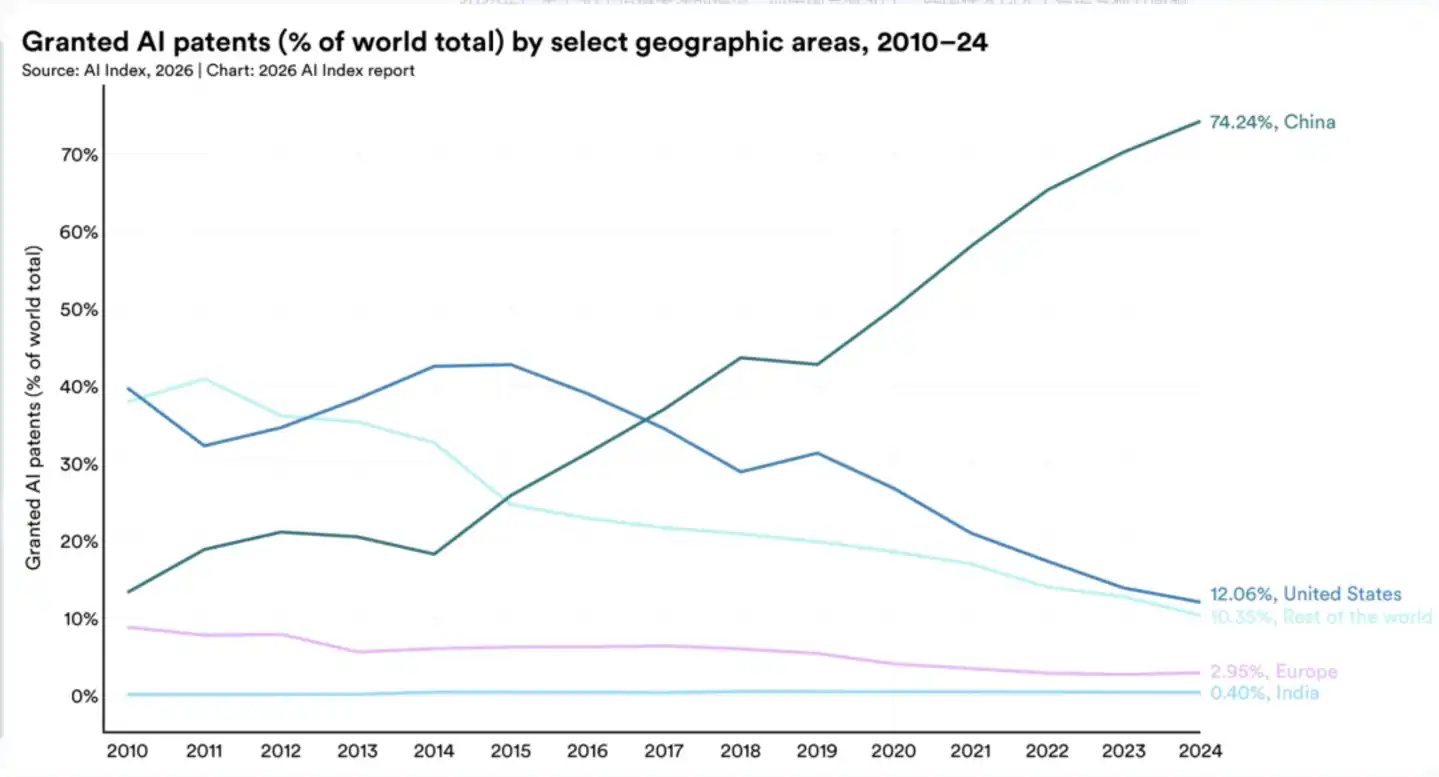

同时,中国在论文发表量、引用量和专利授权方面领先,授予的AI专利数(占世界总数百分比)高达74.24%;美国则拥有更高影响力的专利,并在2025年产生了50个值得关注的模型,而中国只有30个。

此外,韩国在人均AI专利方面领先,中国在引用量最高的100篇AI论文中的份额从2021年的33%增长到2024年的41%。

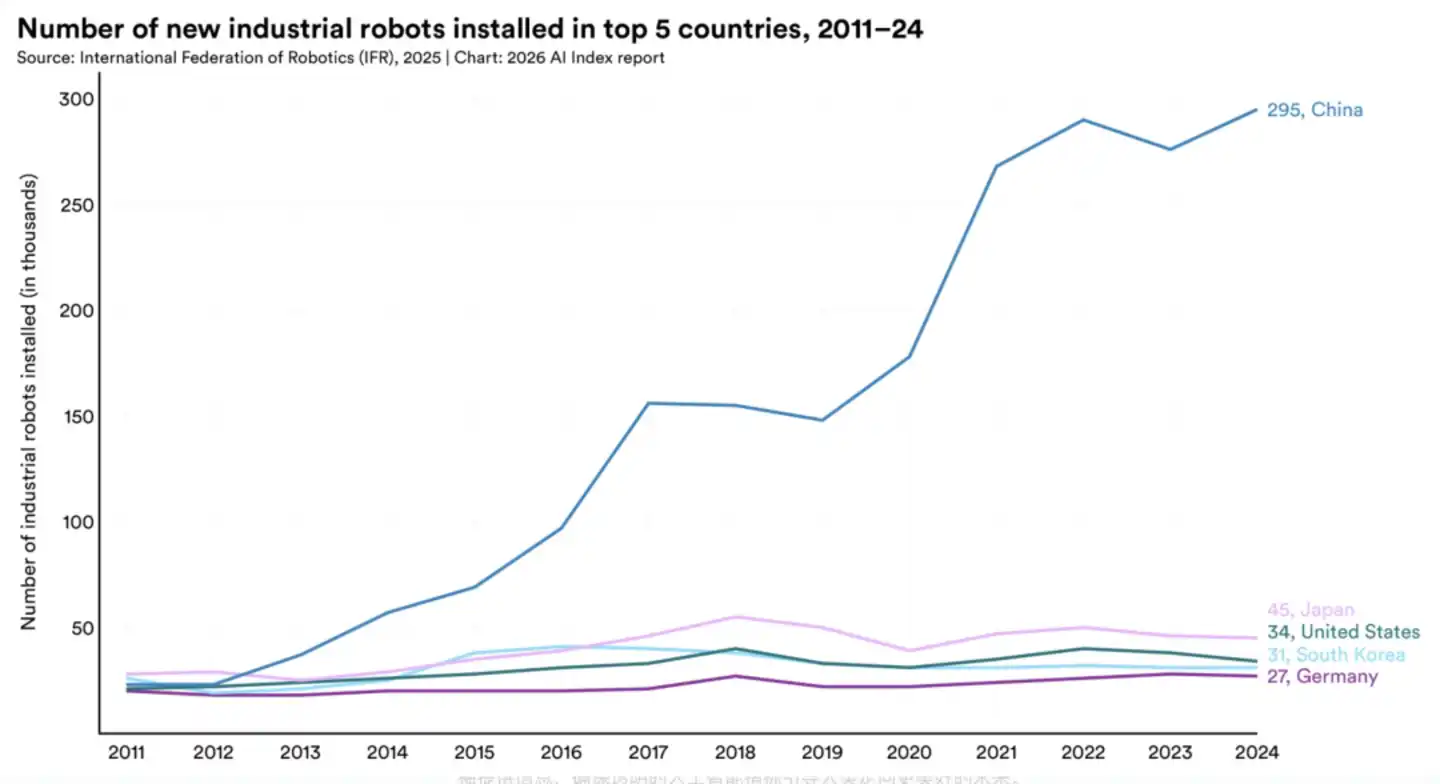

机器人技术层面,中国占全球工业机器人装机量的54%,高于2023年的51.1%。全球同比增速持平,包括美国、德国和意大利在内的几个主要市场出现下滑。

排名前5位的国家新安装的工业机器人数量中,中国机器人企业以295项排名第一,远超过日本、美国、韩国等。

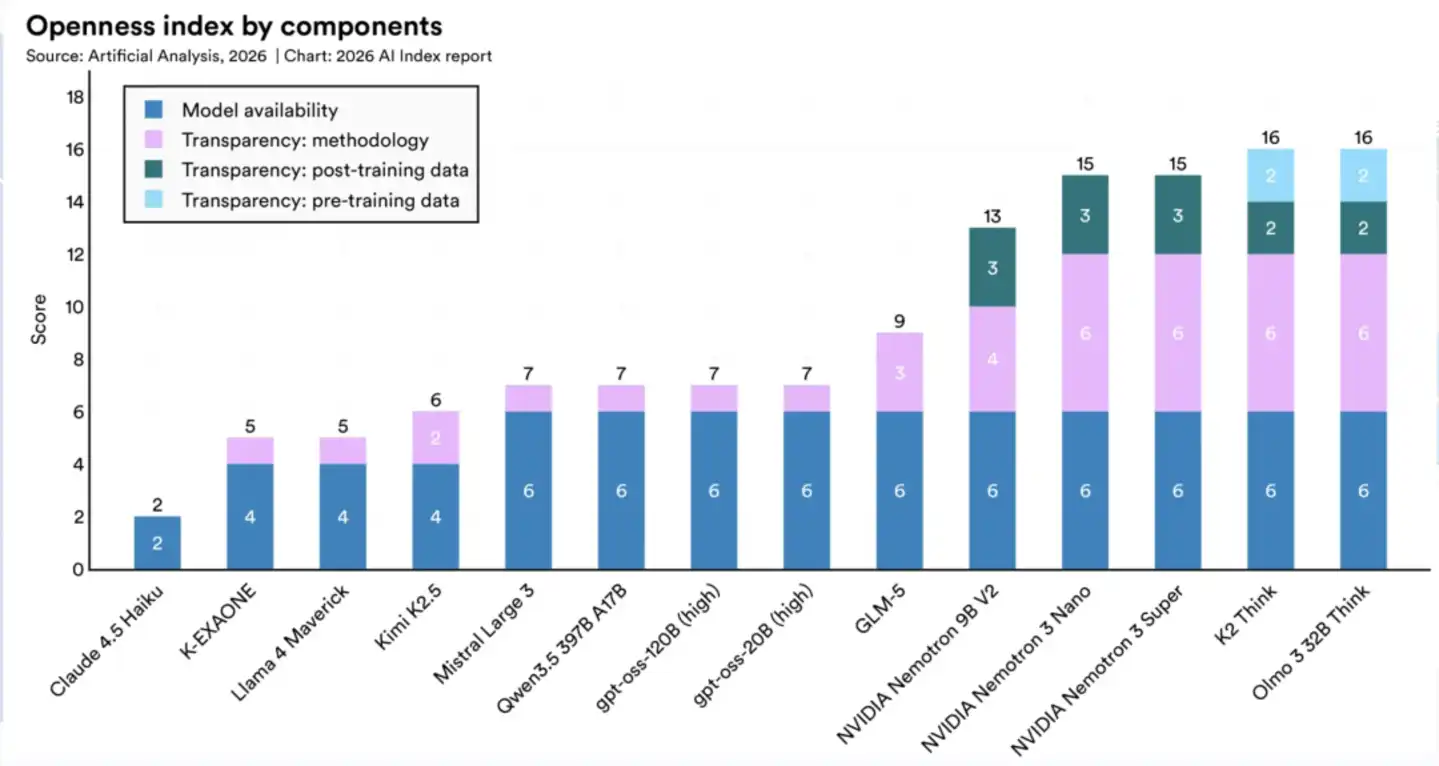

随着竞争加剧,OpenAI、Anthropic和谷歌等公司不再公开其训练代码、参数数量或数据集大小。

报告显示,在2023年至2024年间,基础模型透明度指数从37上升至58,但2025年平均得分下降至40。在训练数据、计算资源和部署后影响等方面的披露仍然存在重大差距。

“我们对预测模型行为知之甚少,”南加州大学计算机科学家、该报告的合著者吉尔(Yolanda Gil)指出,这种缺乏透明度使得独立研究人员难以研究如何使AI模型更安全。

不过,报告认为,顶尖AI模型参数数量三年来一直维持在1万亿左右,尽管前沿实验室已停止发布相关数据。而训练计算量(可以独立估算)则持续增长。

其中,OLMo 3.1 Think 32B 的参数比 Grok 4 少了近 90 倍,仅通过修剪、去重和整理就在多个基准测试中取得了可比的结果。

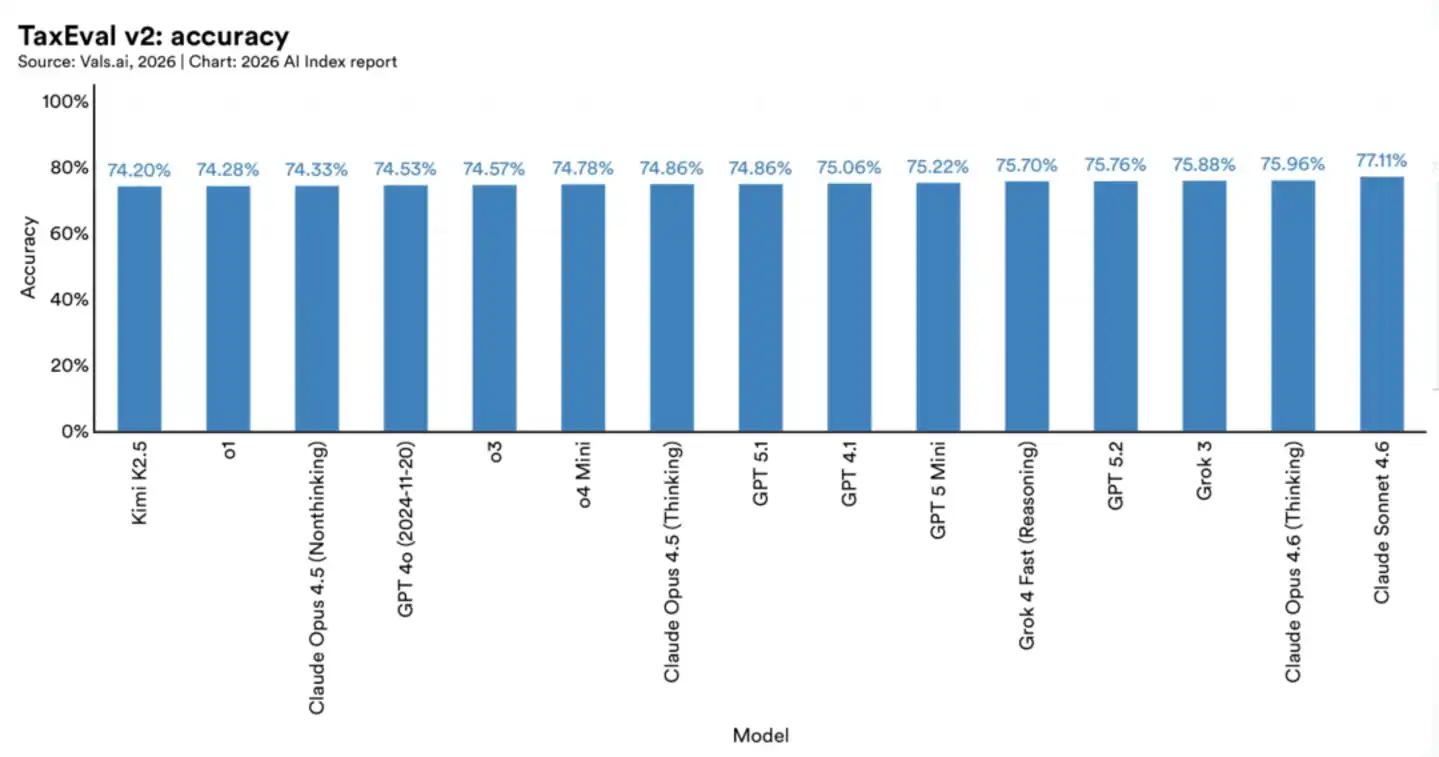

另外,AI模型正在扩展到专业领域,在税务、抵押贷款处理、公司财务和法律推理的评估中,其性能表现从60%到90%不等。而排名前15的模型在各项基准测试中性能差距仅为3个百分点。

其中在TaxEval v2准确率当中,国内的Kimi K2.5排名第一,达74.2%的准确率,高于OpenAI和Anthropic研发的一众模型。

这类对性能和可靠性要求极高的领域,对AI模型而言仍然是巨大的挑战。

AI模型发展速度极快,但测试AI基准的错误率高达42%

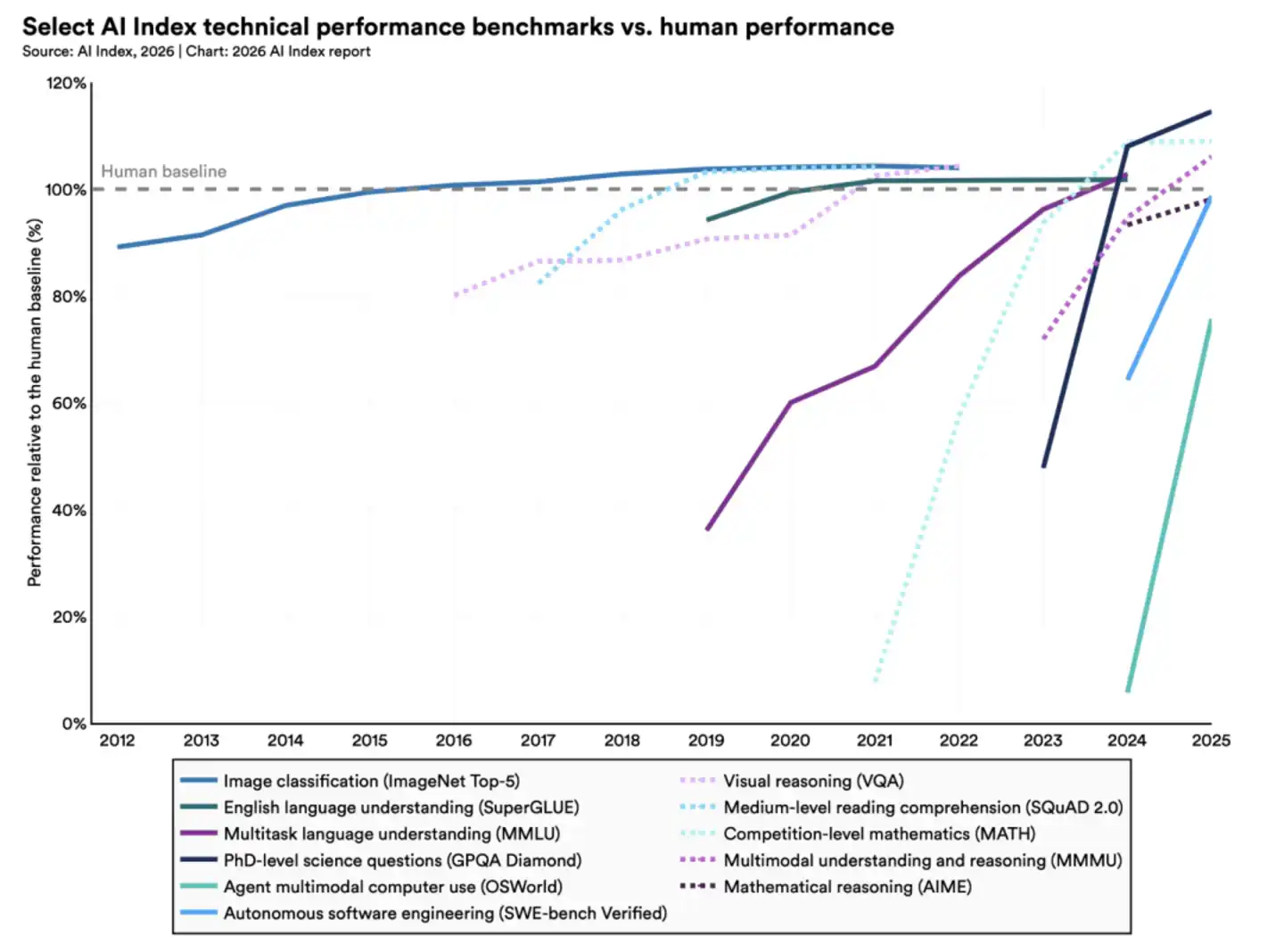

尽管有人预测AI模型的发展将会停滞不前,但它们却不断进步。在某些方面,它们在旨在衡量博士级科学、数学和语言理解能力的测试中,其表现已经达到甚至超过了人类专家。

报告显示,SWE-bench Verified是一个针对AI模型的软件工程基准测试,其最高得分从2024年的约60%跃升至2025年的近100%。2025 年,一个AI系统能够独立生成天气预报。

吉尔说:“令我惊讶的是,这项技术还在不断进步,而且丝毫没有停滞不前的意思。”

然而,AI在许多其他领域仍然面临挑战。

由于人工智能模型是通过处理海量文本和图像而非体验物理世界来学习的,因此人工智能表现出“锯齿状智能”。机器人仍处于早期阶段,仅能成功完成12%的家务任务;AI也在向法律和金融等专业领域拓展,但目前还没有任何一种模型能够完全主导这些领域。

自动驾驶汽车的发展则更为迅速:Waymo的自动驾驶汽车目前已在美国五个城市投入使用,百度的Apollo Go自动驾驶汽车也在中国为乘客提供出行服务。

而且,我们测试AI大模型技术的方式存在缺陷。

斯坦福大学的报告指出,用于追踪AI进展的基准测试难以跟上模型快速突破极限的步伐。有些基准测试设计得很差——例如,一个常用的测试模型数学能力的基准测试,错误率高达42%。还有一些基准测试可以被操纵:例如,当模型使用基准测试数据进行训练时,它们无需变得更聪明就能获得高分。

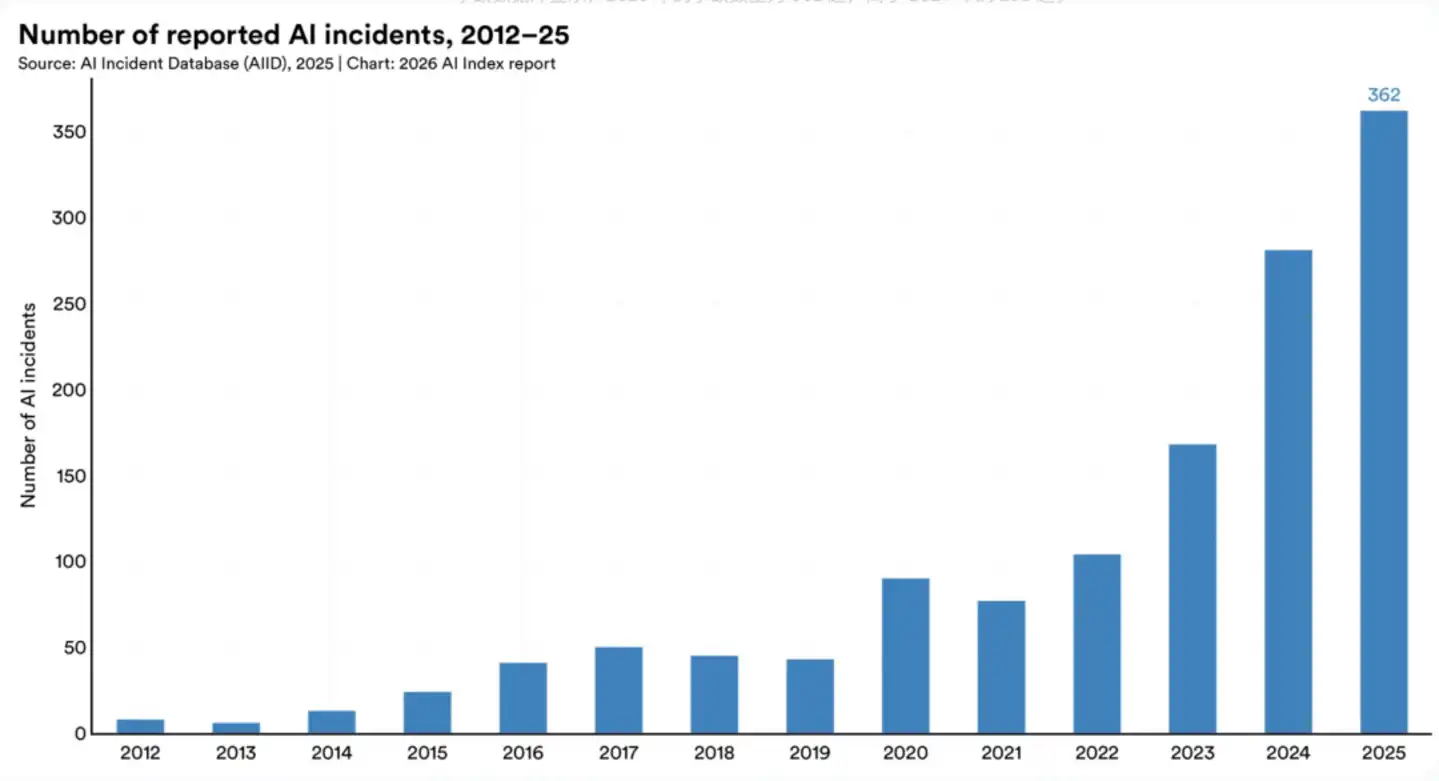

如今,几乎所有领先的前沿模型开发商都会报告其在MMLU和SWE-bench等能力基准测试中的结果,但关于负责任的 AI 基准测试的报告仍然很少。有记录的AI事故持续上升,AI事故数据库显示,2025年的事故数量为362起,高于2024年的233起。

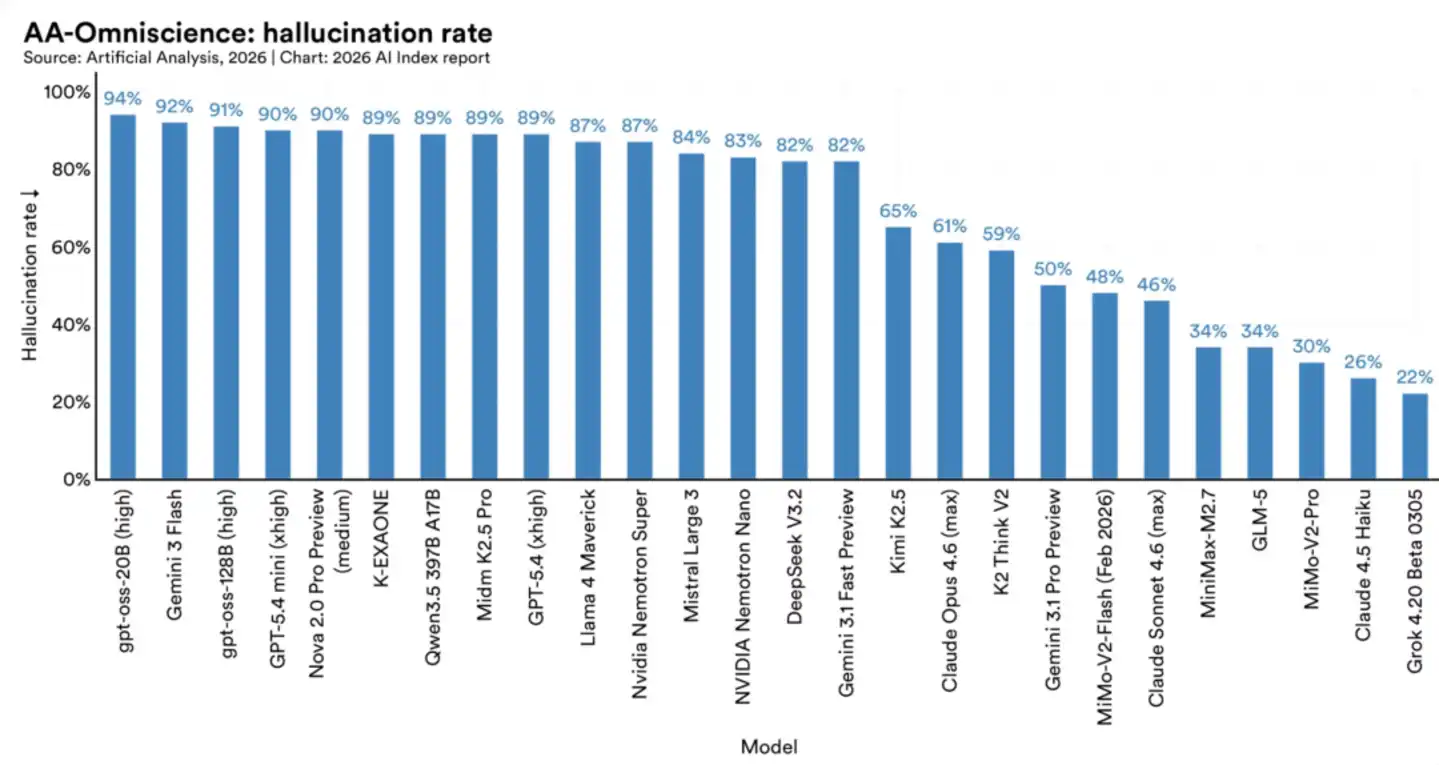

导致的后果之一是,在一项新的准确率基准测试中,26个顶级模型的幻觉率介于22%到94%之间。GPT-4o的准确率从98.2%下降到 64.4%,DeepSeek R1的准确率则从90%以上,下降到14.4%。

当错误陈述被呈现为他人所相信的内容时,模型能够很好地处理。但当同样的错误陈述被呈现为用户所相信的内容时,模型的性能就会急剧下降。

由于AI的实际应用方式很少与测试方式相同,因此强大的基准测试性能并不总是能转化为实际应用性能。而对于AI Agent和机器人等复杂的交互式技术,目前几乎没有相应的基准测试。

AI公司也越来越少地公开其模型的训练方法,而独立测试的结果有时与他们公布的信息截然不同。

“很多公司没有公布其模型在某些基准测试中的表现,尤其是负责任AI基准测试,”吉尔说。“模型在基准测试中的表现缺失,或许说明了一些问题。”

AI开始影响就业

报告指出,生成式AI普及仅三年,全球已有超过半数人口使用生成式AI,其普及速度甚至超过了个人电脑和互联网。

据估算,目前约有88%的机构和80%的大学生都在使用AI。

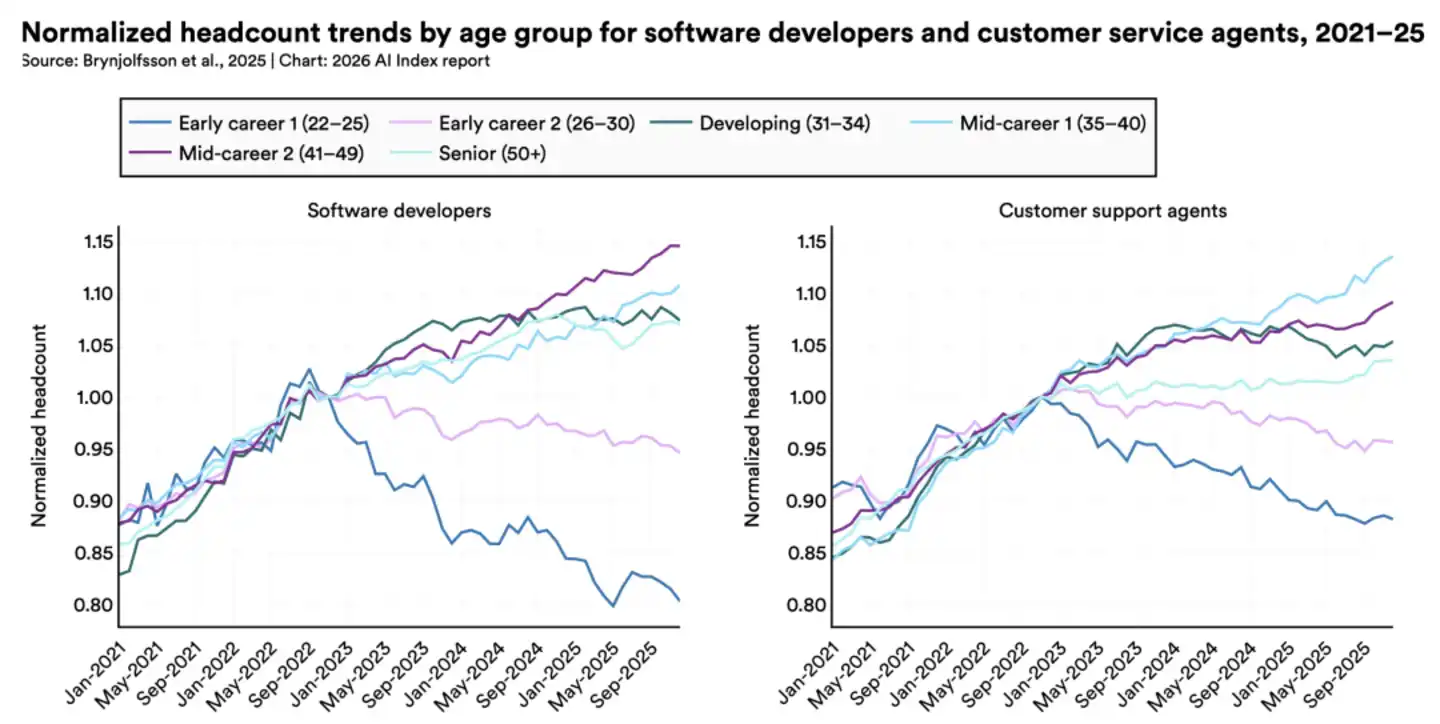

不过,AI的部署尚处于早期阶段,其对就业的影响难以衡量。但一些研究表明,人工智能已经开始影响某些行业的年轻从业者。

斯坦福大学经济学家在2025年的一项研究中指出,自2022年以来,22至25岁软件开发人员的就业率下降了近20%。

虽然这种下降可能并非完全由AI造成,更广泛的宏观经济环境也可能是原因之一,但AI似乎确实发挥了一定作用。

此外,随着AI进展加速,招聘可能会持续收紧。

麦肯锡公司2025年的一项调查显示,三分之一的企业预计人工智能将在未来一年缩减员工规模,尤其是在服务和供应链运营以及软件工程领域。该指数引用的研究表明,AI在客户服务领域将生产力提高了14%,在软件开发领域提高了26%。

但在需要更多判断的任务中,这种提升并不明显。

总而言之,现在判断AI更广泛的经济影响还为时尚早。

人们对AI抱有复杂情绪

对于AI的快速发展,世界各地的人们都表现出既乐观又焦虑。

根据该指数报告引用的益普索调查,59%的人认为AI带来的好处大于弊端,而52%的人表示AI让他们感到紧张。

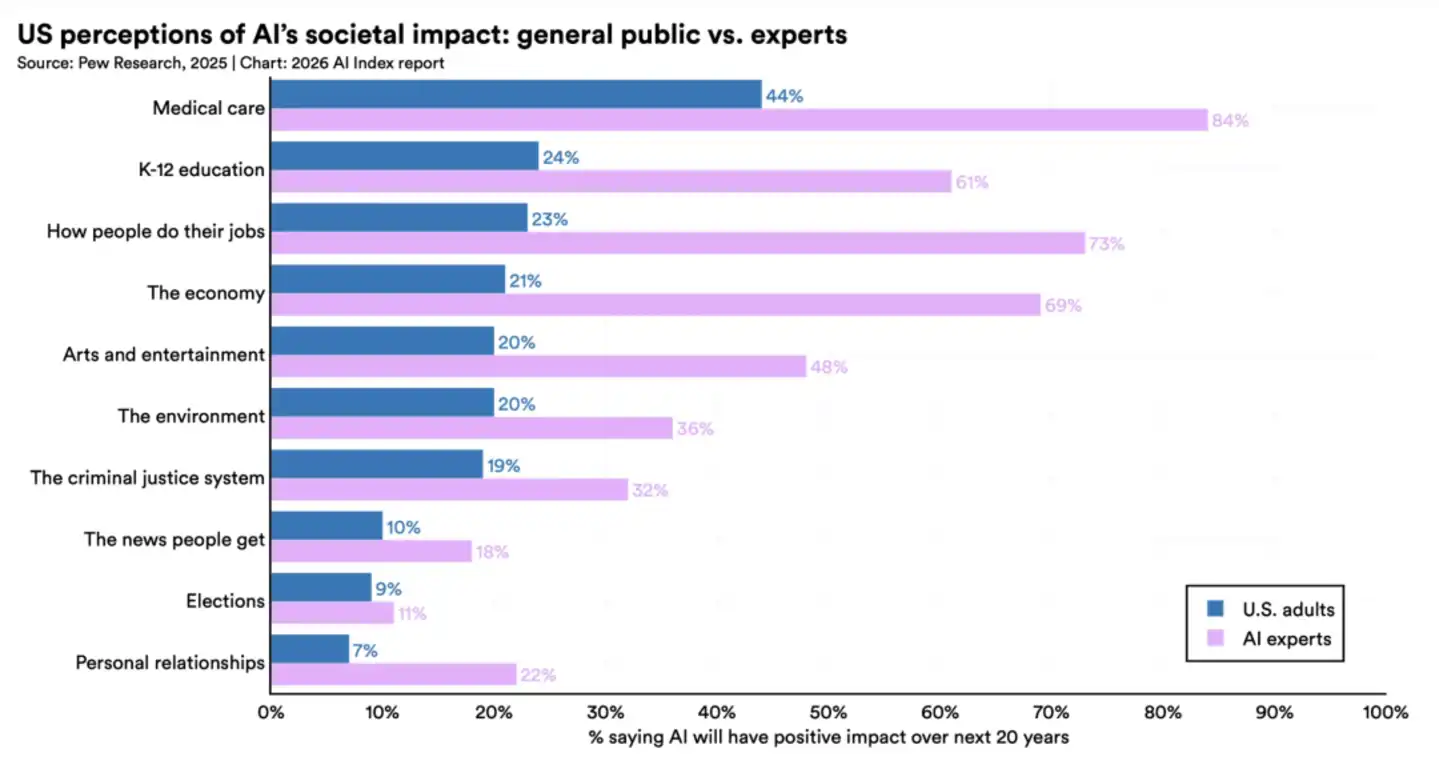

值得注意的是,皮尤研究中心的一项调查显示,专家和公众对人工智能的未来看法截然不同。

最大的分歧在于未来工作:73%的专家认为人工智能将对人们的工作方式产生积极影响,而只有23%的美国公众认同这一观点。

专家对AI在教育和医疗保健领域的影响也比公众更为乐观,但他们一致认为AI会对人际关系等一系列场景造成不利影响。

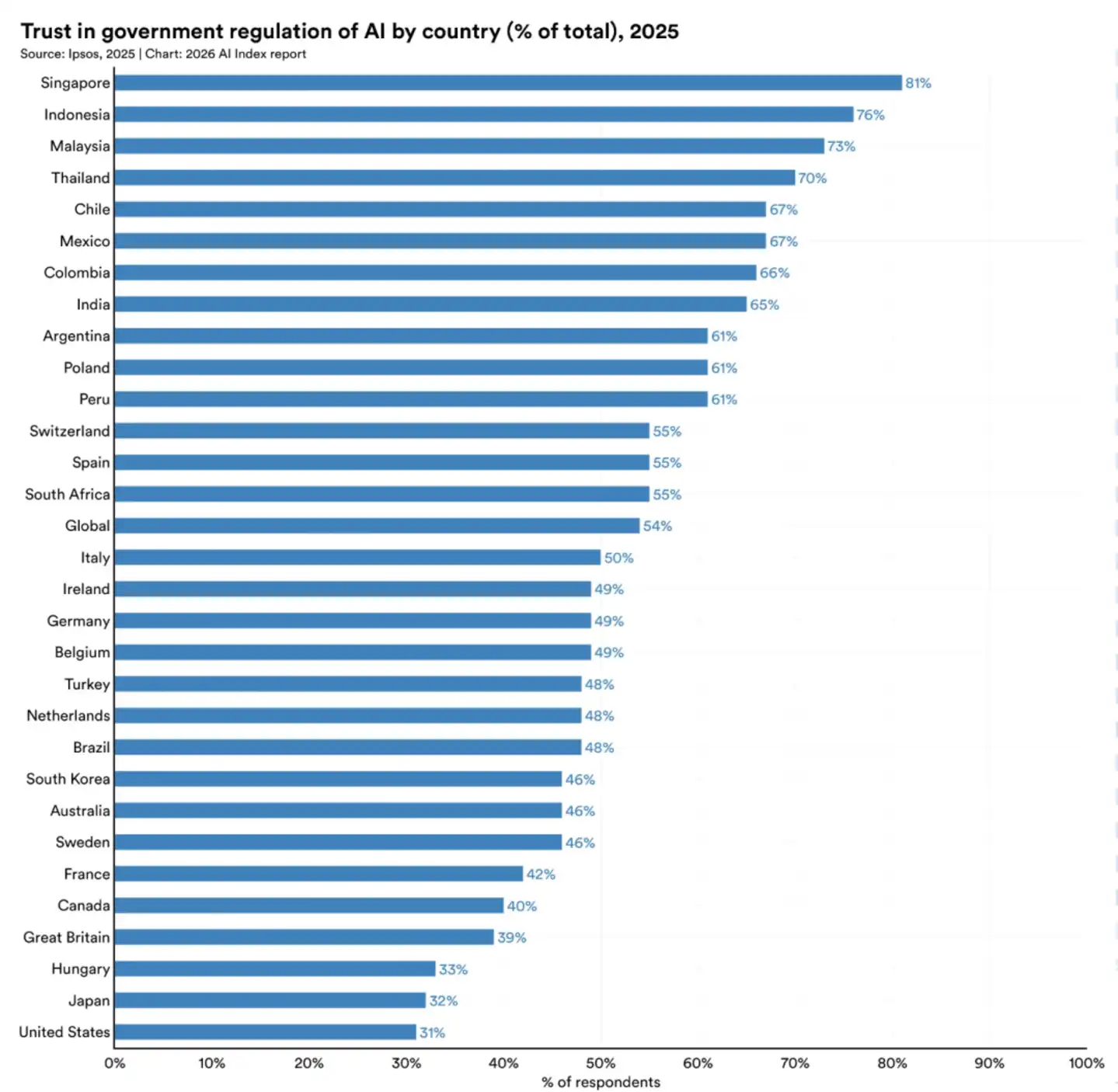

益普索的另一项调查显示,在所有受访国家中,美国对本国政府在AI监管方面的信任度最低。更多美国人担心AI的监管力度不够,而不是担心监管力度过大。

对于青少年,报告显示,超过80%的美国高中生和大学生现在使用AI完成与学习相关的任务,但只有一半的中学制定了AI政策,而且只有6%的教师认为这些政策清晰明确。

在课堂之外,阿联酋、智利和南非的AI工程技能发展速度最快。2022年至2024年,美国和加拿大新增AI博士的数量增长了22%,而这些新增博士大多选择在学术界而非工业界就业。

各国政府正努力监管AI

世界各国政府都在努力监管AI,去年也取得了一些小小的进展。

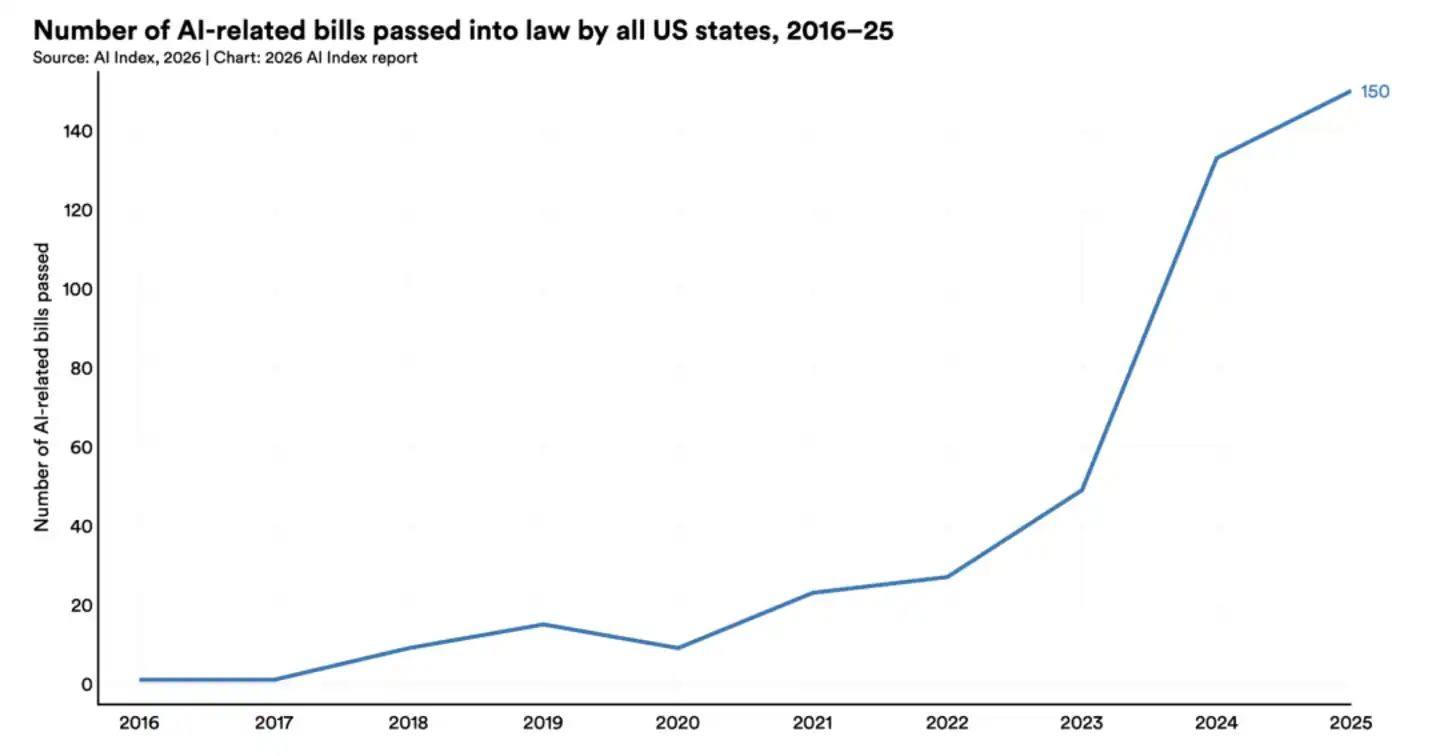

据悉,2025年,欧盟《人工智能法案》的首批禁令生效,禁止将AI用于预测性警务和情绪识别;日本、韩国和意大利也通过了各自的AI法律法规;与此同时,美国联邦政府却朝着放松管制的方向发展,特朗普总统签署了一项行政命令,试图限制各州对AI的监管。

尽管美国采取了上述行动,但美国各州议会仍通过了创纪录的150项人工智能相关法案。

其中,加利福尼亚州颁布了具有里程碑意义的立法,其中包括SB 53法案,该法案强制要求AI模型开发者披露安全信息并提供举报人保护;纽约州通过了《RAISE法案》,要求AI公司公布安全规程并报告重大安全事件。

报告中的折线图显示了2016年至2025年美国各州通过的与人工智能相关的法案数量,该数量在2023年急剧增加,并在2025年达到峰值150项法案。

但吉尔表示,尽管立法活动不断,监管仍然落后于AI技术发展,因为我们并不真正了解它的运作方式,尤其各国在AI方面持谨慎态度,“我们对这些AI系统缺乏有效的掌控。”

报告指出,在受访国家中,美国民众对其政府监管AI能力的信任度最低,仅为31%。在全球范围内,欧盟在有效监管AI方面,比美国或中国更高一些。