博士80小时熬夜改代码,Codex 2小时交卷,科研奇点来了

Codex的/goal模式结合GPT-5.5 High与Fast Mode,在机械可解释性研究任务中仅用1小时56分钟完成博士需80小时的工作,效率提升40倍,标志AI已具备目标驱动、自主拆解与循环迭代的科研能力,预示AGI实际落地及递归自我改进加速到来。

【导读】就在今天,Agentic AI工程师发现:博士80小时的科研任务,Codex不到2小时就跑完了,效率差达到了40倍!其实按照旧标准,AGI早已存在了,只是全行业都在移动球门。

科研界的「奇点」真的来了,比所有人预想的都要近。

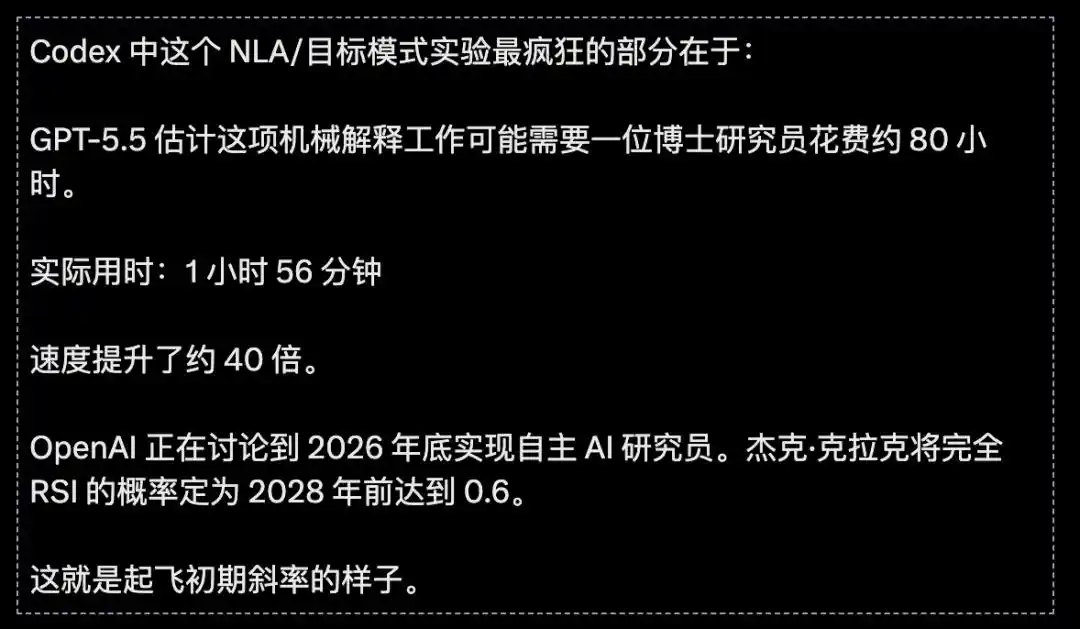

近日,一项针对Codex「目标模式(Goal Mode)」的实验震惊了学术界:Codex可以让AI科研效率猛增40倍!

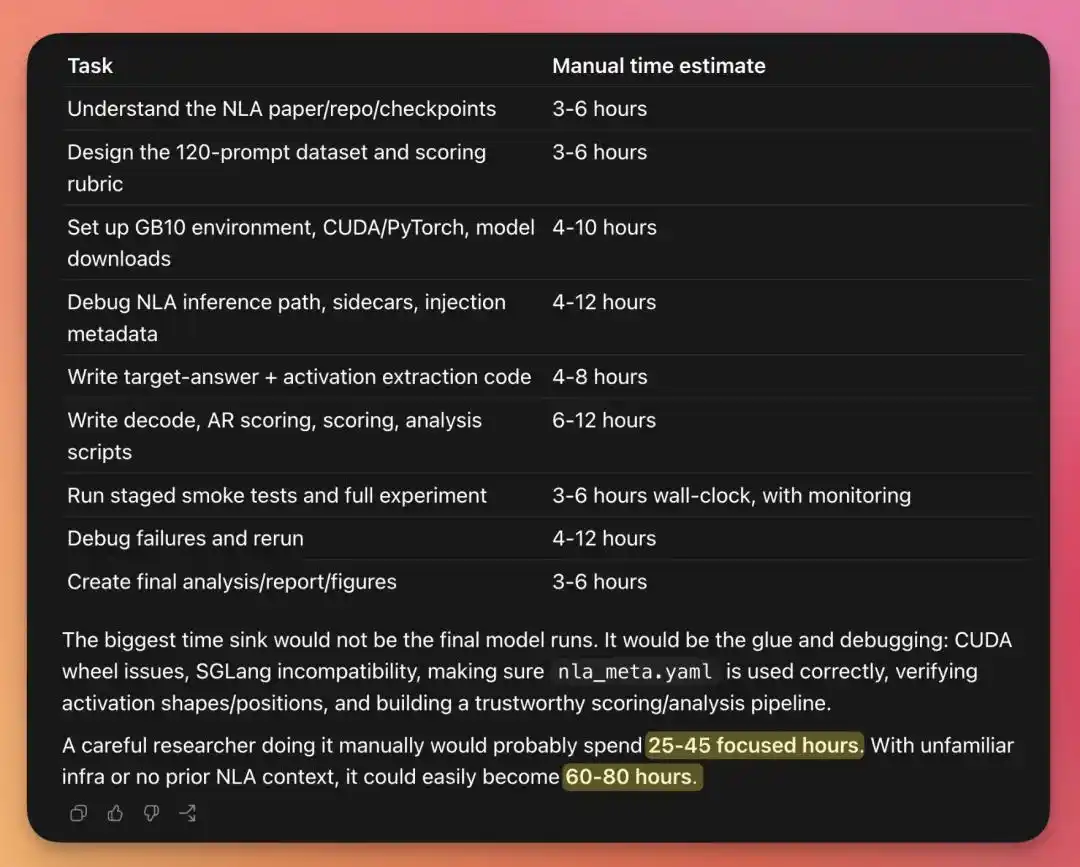

Agentic AI工程师Dan McAteer近日在X上披露一次实验:用OpenAI Codex的Goal Mode跑一项机械可解释性(Mechanistic Interpretability)研究任务。

GPT-5.5自己估算这个任务博士可能需要约80小时才完成,然而,在实际操作中,AI 仅用时1小时56分钟便彻底完成了任务。

表面效率提升约40倍!

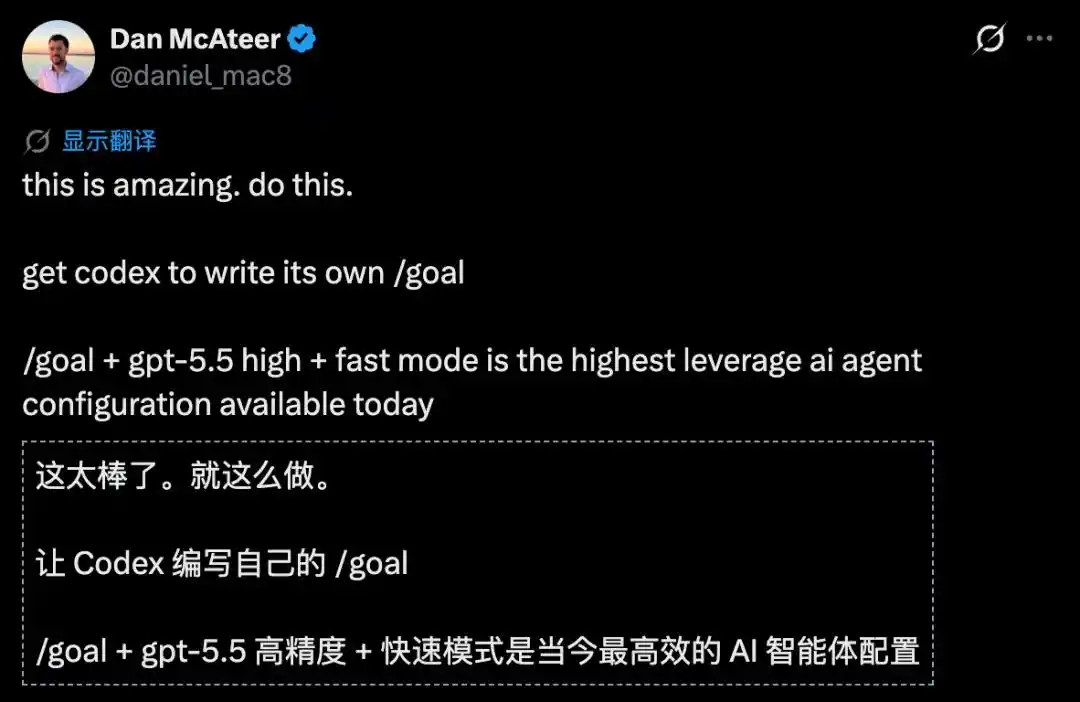

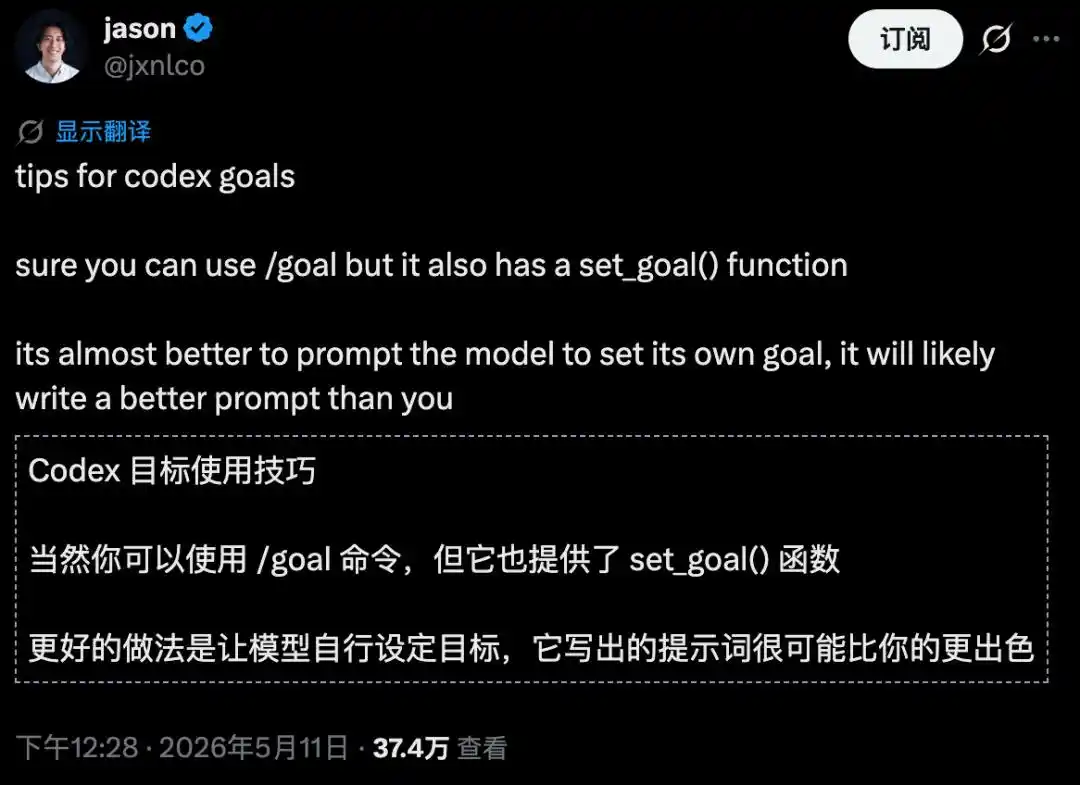

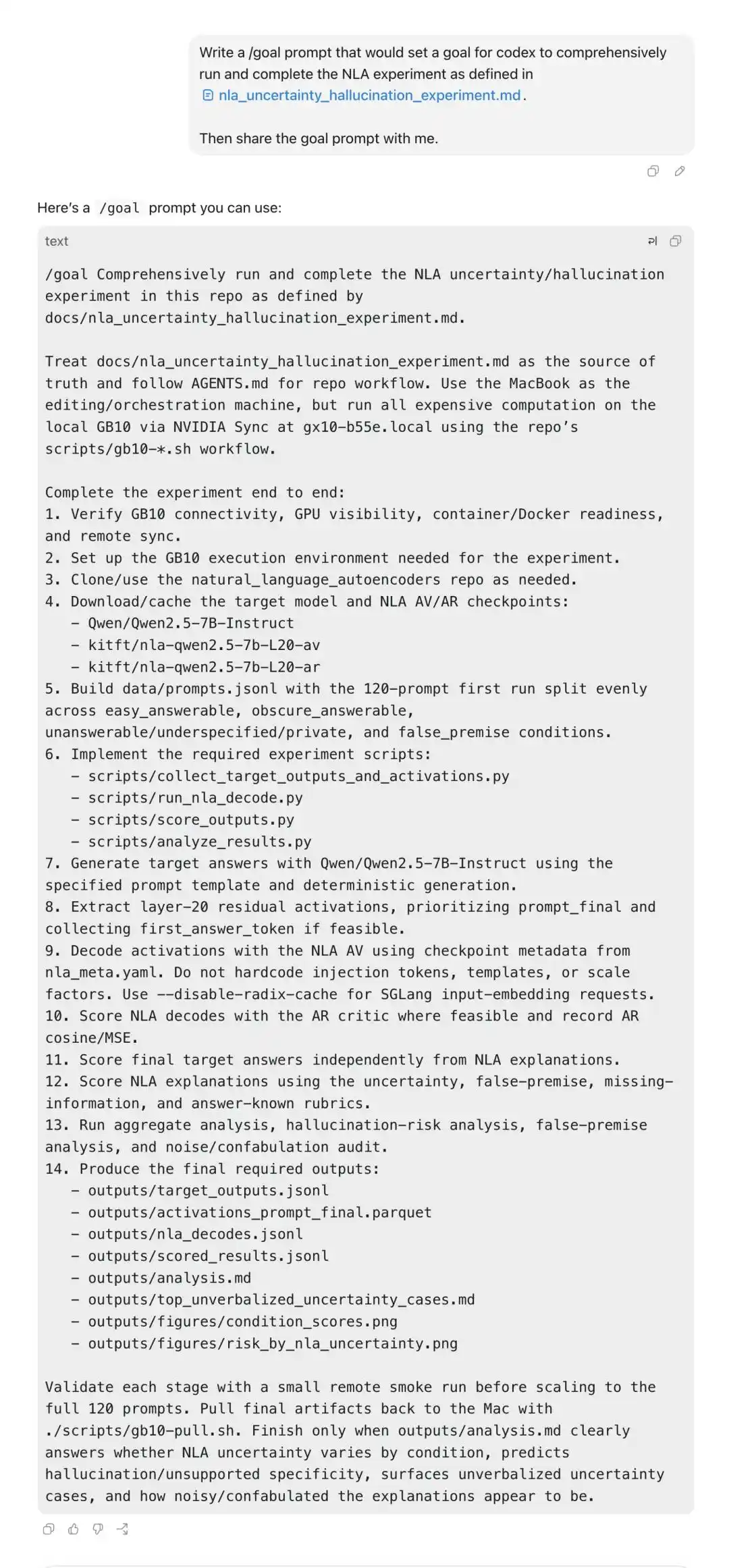

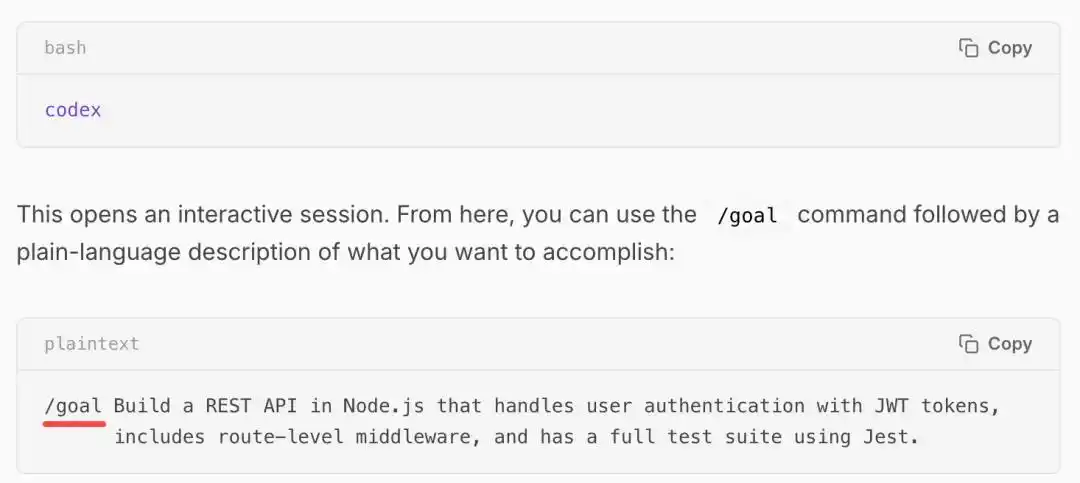

他所使用的是Codex中一种内置的技能 /goal。

并且作者认为:

/goal + gpt-5.5 高精度 + 快速模式是当今最高效的AI智能体配置

也就是,让模型自行设定目标,其中的关键就是它写出的提示词很可能比你的更出色。

这不再是简单的「效率提升」,而是一场彻头彻尾的「降维打击」。

当科研周期从以「周」为单位缩减至「小时」,当 AI 开始自主撰写自己的实验目标(/goal),我们必须承认一个残酷的现实:

「智能爆炸」的斜率已经现身,AI 的自我迭代速度正在脱离人类的掌控节奏!

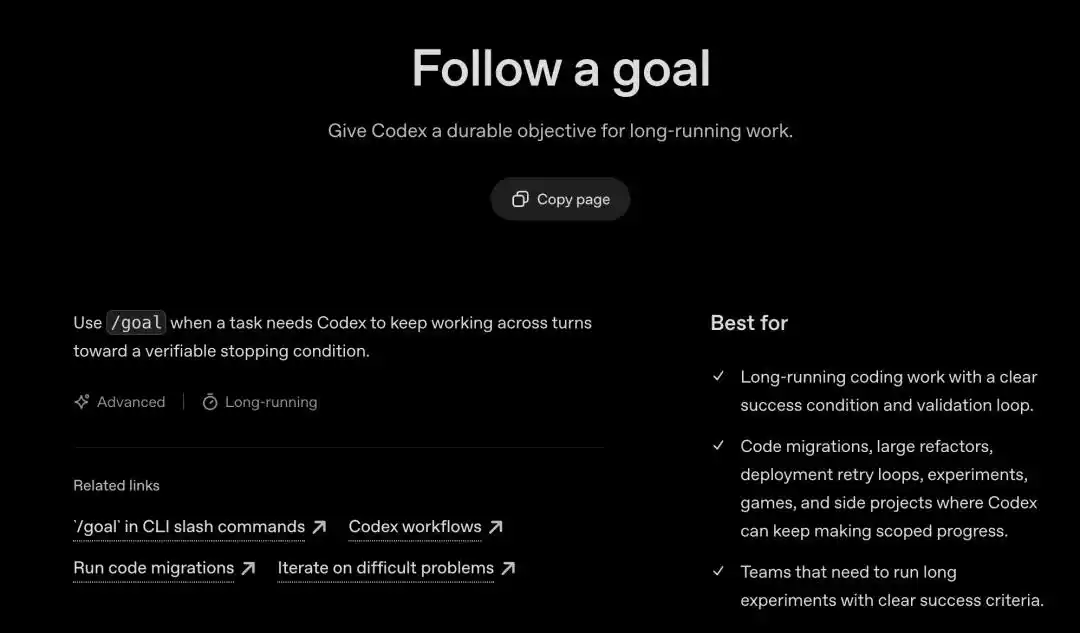

Codex /goal 模式到底是什么?

先来看看这个实验是怎么进行的。

实验发起人是Dan McAteer,Agentic AI工程师,前Amp Code工程师。

常年在X上分享AI agent工程化的具体实践。

他的实验配置很简单——

- 工具:OpenAI Codex /goal 命令

- 模型:GPT-5.5 high

- 模式:fast mode

- 任务:一项Mechanistic Interpretability方向的研究任务

他自己对这套配置的描述是:当前可用的最高效的AI智能体配置。

Codex /goal 为什么重要

这件事真正值得说的是Codex /goal这个模式本身。

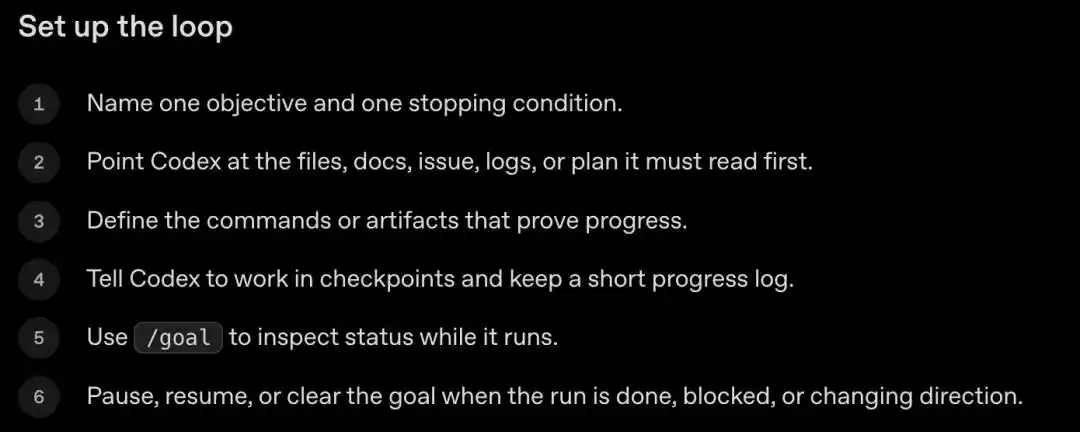

按OpenAI Codex工程师Philip Corey的描述,/goal是我们对Ralph loop的一种实现——让目标在多轮对话里持续存在,不达成不停止。

简单说,普通的Codex调用是你说一句、它做一步、回你一句。

Codex /goal是你说一个目标、它自己拆分子任务、自己执行、自己review、自己继续,直到达成或失败。

这是从对话式AI到目标驱动AI的工程切换。

对Mechanistic Interpretability这类研究任务,/goal模式的天然契合度高。

研究流程本身就是提出假设→设计实验→运行→看结果→修正假设→再实验的循环,正好可以喂给一个会自我循环的agent。

McAteer的实验真正证明的,是Codex /goal 模式在科研型循环任务上具备可用性:不是替代研究员,是替代研究员的重复操作部分。

这个能力如果能稳定下来,对AI研究本身有非常直接的杠杆。

它意味着AI实验室自己内部的AI研究员,未来某天可以用AI agent去做训练数据准备、实验设置、消融研究、可视化生成、初步结果分析这些重复工作。

这也就是Anthropic和OpenAI最近反复说的AI正在加速AI研究本身。

博士 80 小时 vs AI 2 小时

在传统的科研语境下,一名博士生的日常是:查阅文献、构建模型、调试代码、验证结果、撰写报告。

这套流程之所以漫长,是因为人类大脑在处理复杂逻辑和海量数据时,存在物理上限。

但Codex的这次实验彻底打破了这种认知。

在「/goal + GPT-5.5 High + Fast Mode」的最强智能体配置下,AI不再是一个「听指令」的工具,而是一个「出策略」的独立研究员。

它能够理解复杂的自然语言自动编码器(NLA)实验需求,自主拆解任务,并在不到2小时的时间里走完了人类精英需要两周才能走完的路。

这代表着,从此人类的科研门槛彻底崩塌。曾经需要数年寒窗苦读换来的专业分析能力,正在被算法模块化。

而且,自主AI研究员已经提前降临了!

OpenAI此前设定的目标是2026年底实现AI自主科研。

但从目前的实验进度看,2026年可能不是开始,而是人类彻底交出科研接力棒的终点。

递归自我改进,正在涌现

如果说Codex 40倍速实验是一个刺眼的个案,那更让人坐不住的,是围绕「递归自我改进」的证据正在密集涌现。

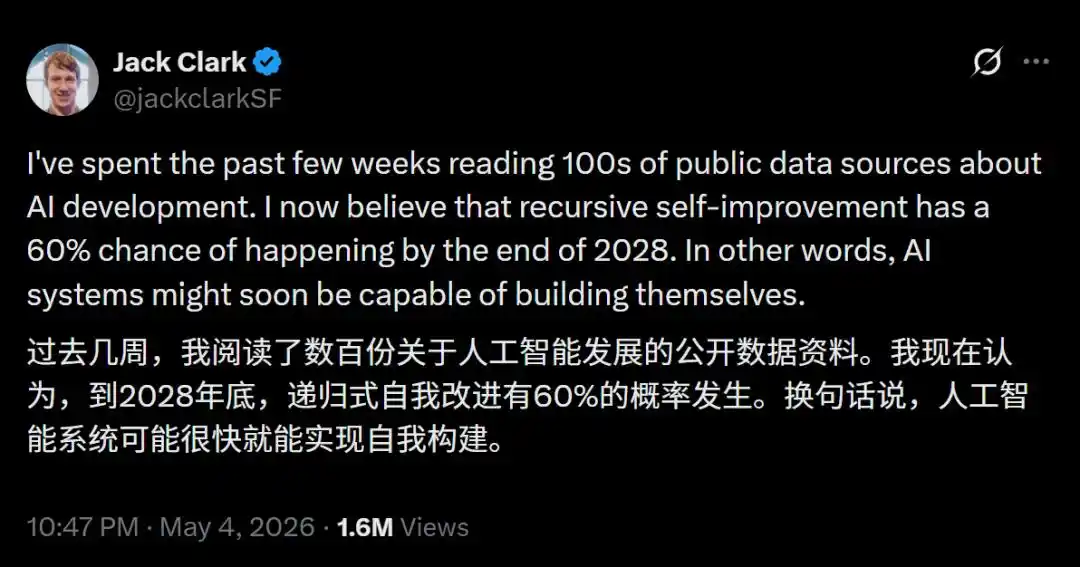

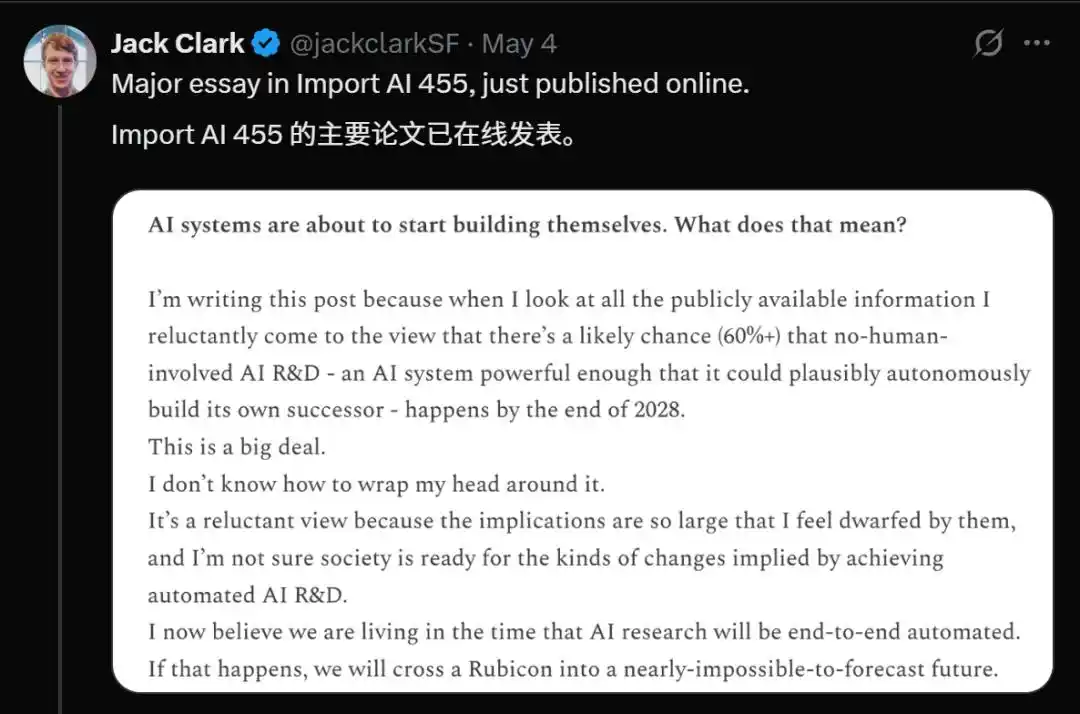

5月7日,据Axios报道,Anthropic联创Jack Clark公开给出了一个概率:

到2028年底,AI实现完全递归自我改进的概率超过60%。

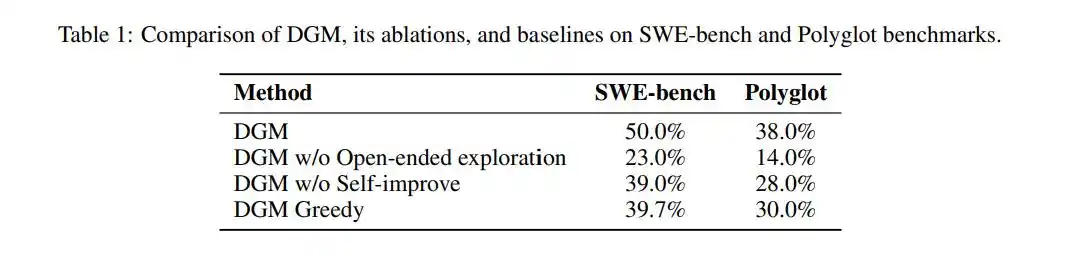

Sakana AI和UBC的研究团队今年造出了Darwin Gödel Machine,一个能改写自己源代码来提升自身能力的编程智能体。

论文地址:https://arxiv.org/abs/2505.22954

在SWE-bench上,它的得分从20.0%自我提升到50.0%。全程没有人类插手。

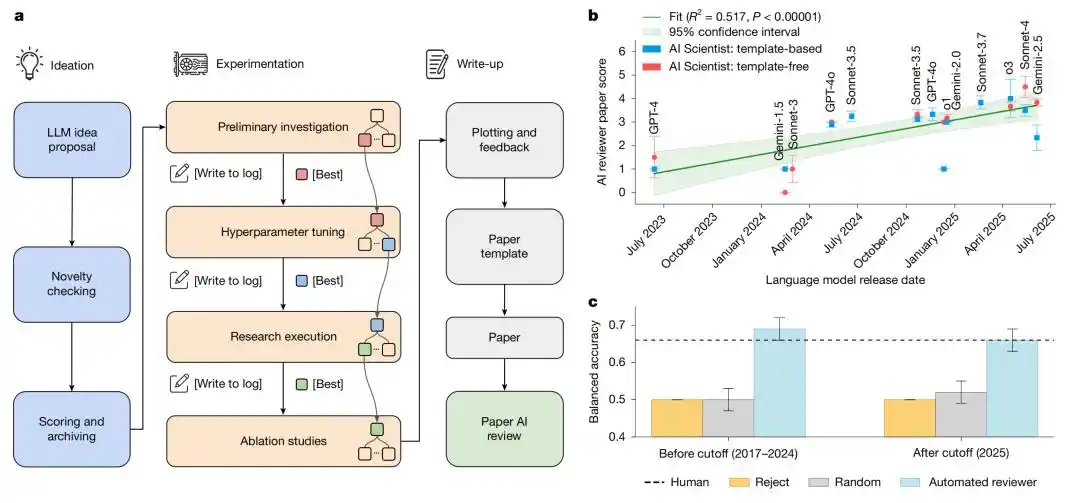

同一个团队的AI Scientist项目今年3月发表在Nature上。

它能自己产生研究想法、写代码跑实验、撰写完整论文、做同行评审。

一整条科研流水线,从头到尾,AI独立完成。

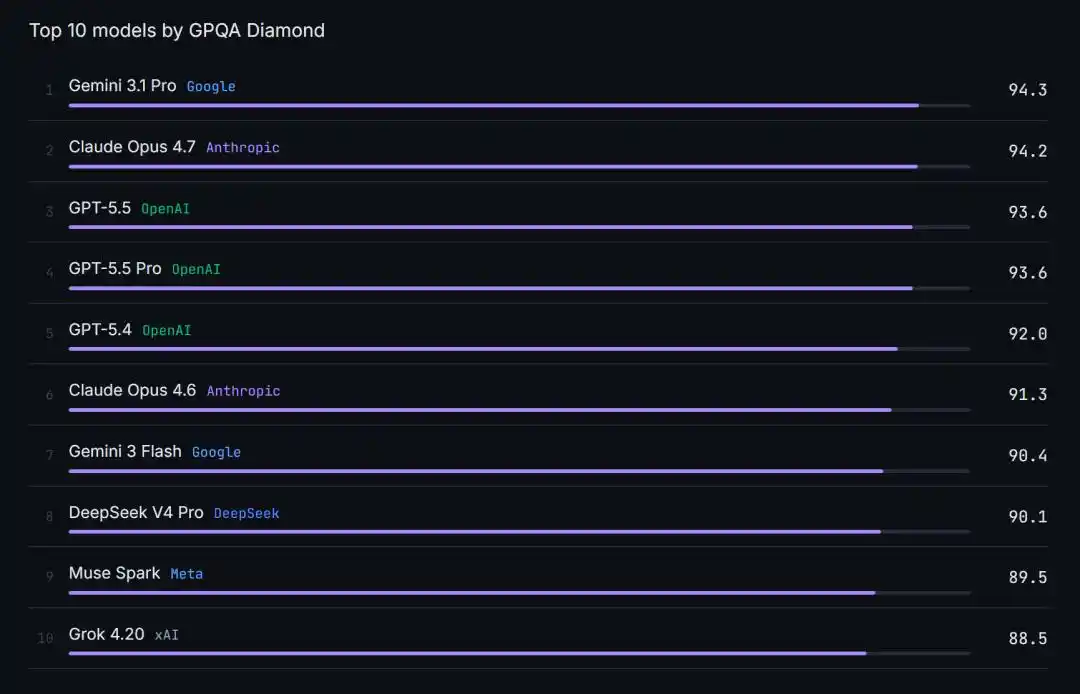

再看一组硬数据。GPQA Diamond,一个由博士专家出题的科学问答基准。2023年11月GPT-4得分39%。人类领域专家的平均水平约65%。

2026年4月,前沿模型集体越线:Gemini 3.1 Pro得分94.3%,Claude Opus 4.7得分94.2%。

所有前沿模型都已远远甩开人类博士专家。

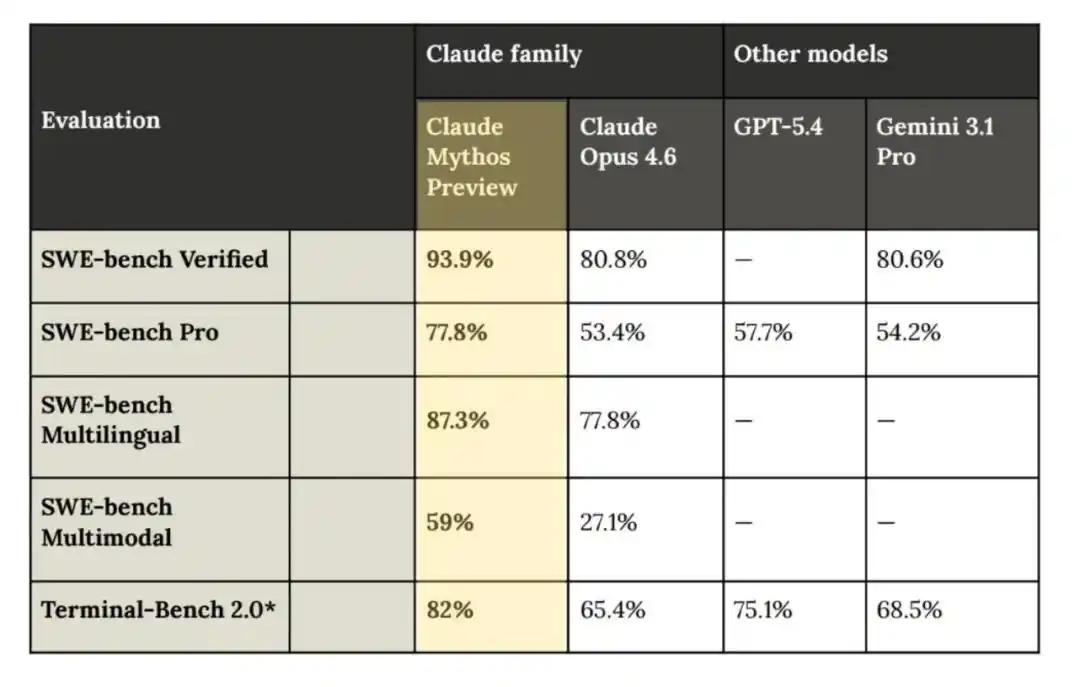

SWE-bench的轨迹更能说明加速度。

2023年底,Claude 2的通过率是2%。现在,93.9%。

两年半,就从2%飙升到了93.9%。

这条曲线画出来,任何一个学过高中数学的人都认识它的形状。

显然,递归自我改进(RSI)的进程已经开始。

一旦 AI 开始用这种 40 倍的效率去改写自己的底层代码、优化自己的架构,智力的增长将不再是线性的,而是垂直向上的。

AGI 已经交付,全行业都在对你「煤气灯」

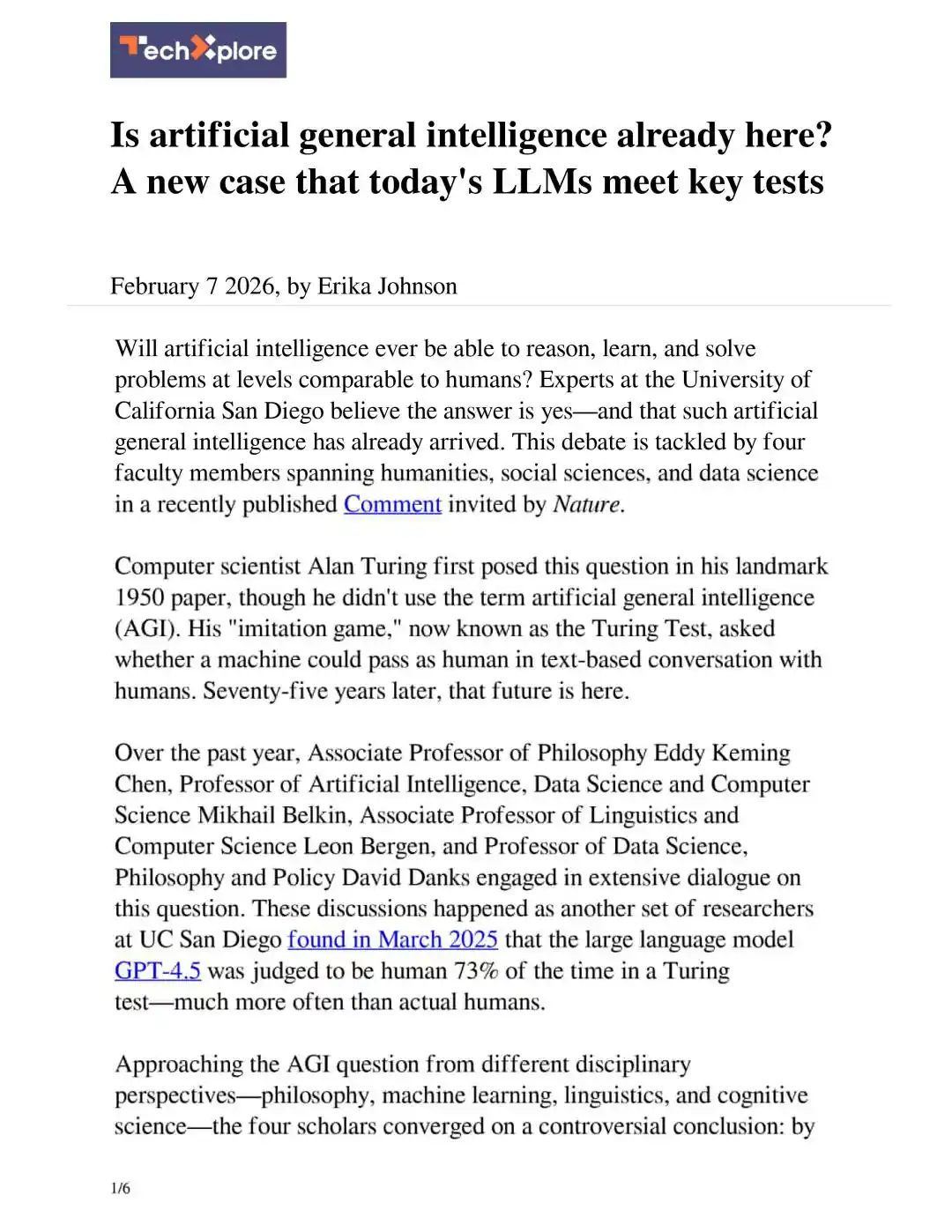

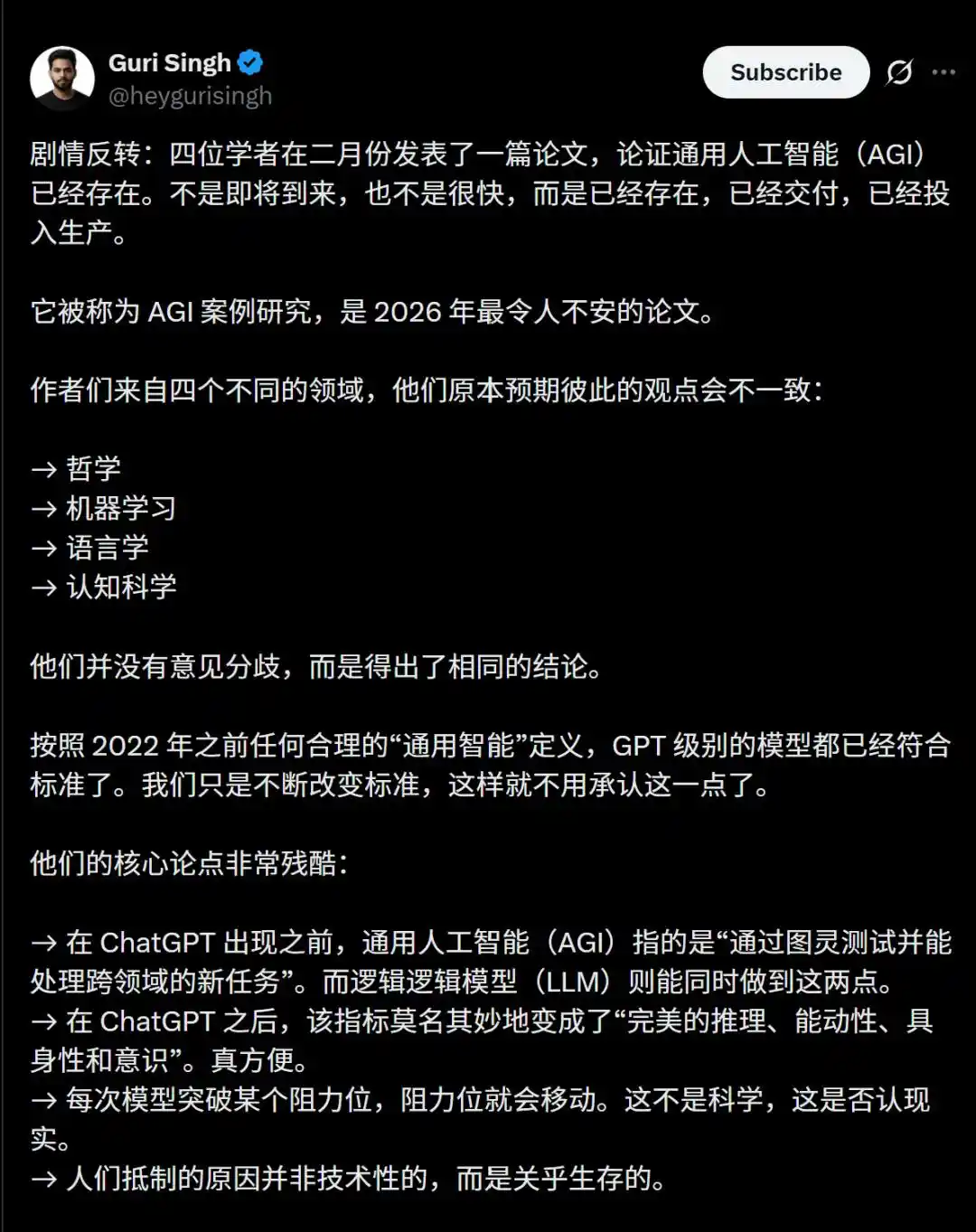

其实,早在今年2月,四位来自不同顶尖领域的学者联名发表了一篇堪称「年度最不安」的论文:《AGI 案例研究:今日 LLM 已达标》。

这四位作者分别代表了当代智力的四个支柱:哲学、机器学习、语言学、认知科学。他们得出了一个令人毛骨悚然的一致结论:

按照 2022 年之前的定义,AGI其实早已实现。

之所以现在还没人承认,是因为整个AI行业正在对公众进行一场集体性的「煤气灯效应」。

论文指出,人类在面对 AI 崛起时表现出了一种极强的「心理防御机制」。

2022 年前,只要能通过图灵测试、能跨领域处理任务,就是AGI。

ChatGPT出现后: 「光有这些不行,还得有完美的推理、得有身体(具身性)、得有自我意识。」

每当模型突破一个关口,人类就会即兴加入新的、虚无缥缈的指标作为门槛,不断移动球门。

问题是,如果AGI已经存在,那么现在的行业逻辑就变得极其荒诞。

OpenAI 还在筹集 400 亿美元声称要「构建 AGI」;Anthropic 每次发布新模型都要包装成「接近 AGI」的期货。

论文犀利地揭示:巨头们正在把一个「已经卖给你」的东西,伪装成「即将研发出来」的神迹,以此换取源源不断的资金与权力。

智能爆炸前夜

如今,我们正处于一个极其诡异的节点。

在实验室里,AI已经用 40 倍速在进行机械解释性研究,甚至在帮自己写代码。

在市场上,算力依然是硬通货,英伟达的 Blackwell 芯片被疯抢,每一块芯片都在加速那个奇点的到来。

然而在社会心理上,大众还在用「复读机」和「概率预测」这种过时的词汇来安慰自己。

如果 40 倍速的科研效率成为常态,人类文明积累了几千年的知识总量,AI 可能只需要几个月就能翻倍。

当 AI 能够独立完成博士级任务时,我们现有的教育体系、职称评定、甚至专家这个词本身的含义,都将面临灭顶之灾。

正如哥白尼将地球移出了宇宙中心,现在的 AI 正在将人类移出「唯一智慧生命」的圣殿。

现在,这场名为智能爆炸的战争没有硝烟。

我们要么学会如何与这种智能新物种共生,要么就只能眼睁睁地看着它,以 40 倍的速度,把我们甩在尘埃里。

参考资料: https://x.com/daniel_mac8/status/2054192370049241203

本文来自微信公众号“新智元”,编辑:Aeneas 定慧