重塑计算界限:去中心化算力的现状与展望

GPU的普遍应用使其在AI领域大放异彩,Nvidia的GPU制造企业在AI算力竞赛中赚得盆满钵满,去中心化算力平台应运而生,提供更灵活可扩展的计算解决方案,EMC protocol重点布局机房实现算力集群,去中心化算力网络可答复降低中心化风险,且伴随技术的更新和算法的迭代,势必在关键领域也会有所突破。

原文作者:Samuel,Future3 Campus 研究员

原文来源:Future3 Campus

需求中的算力

自 2009 年《阿凡达》上映,以无与伦比的真实画面掀开 3D 电影第一役,Weta Digital 作为其背后的巨大功臣贡献了整部电影的视效渲染工作。在它新西兰的占地 10000 平方英尺的服务器农场里,它的计算机群每天处理高达 140 万个任务,每秒处理 8GB 的数据,即使这样也接连持续运行了超过 1 个月,才完成所有的渲染工作。

大规模的机器调用和成本投入,《阿凡达》成就电影史上的卓著功勋。

同年 1 月 3 日,中本聪在芬兰赫尔辛基的一个小型服务器上挖出了比特币的创世区块,并获得了 50btc 的出块奖励。自加密货币诞生第一天起,算力一直在行业扮演非常重要的角色。

The longest chain not only serves as proof of the sequence of events witnessed, but proof that it came from the largest pool of CPU power. —— Bitcoin Whitepaper

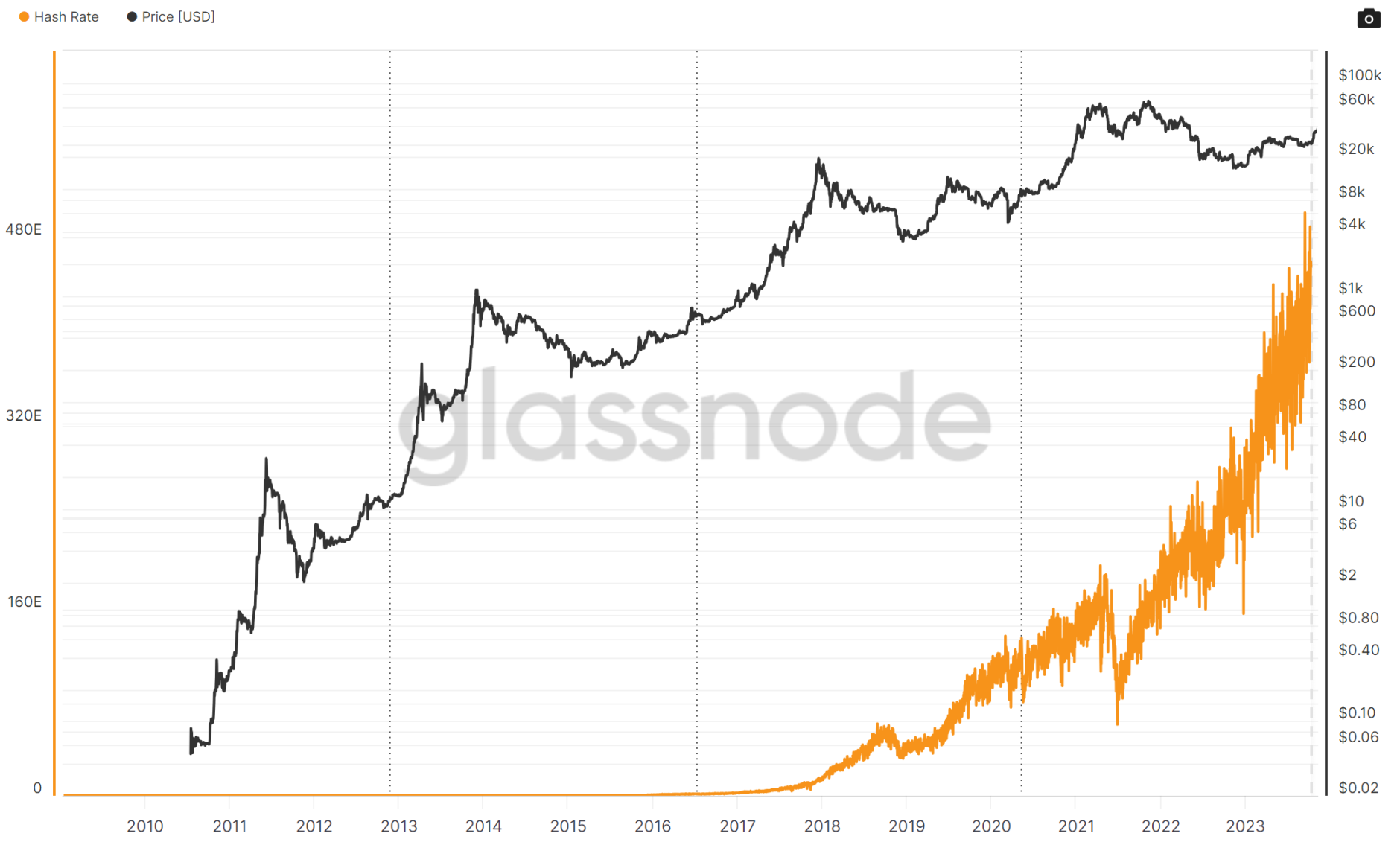

在 PoW 共识机制的大背景下,算力的付出为链的安全性提供保障。同时,持续走高的 Hashrate 也能佐证矿工的算力上的持续投入和积极的收入预期。行业对算力的真实需求,也极大推动了芯片厂商的发展。矿机芯片经历了 CPU、GPU、FPGA、ASIC 等发展阶段。目前,比特币矿机通常是基于 ASIC(Application Specific Ingrated Circuit)技术的芯片能高效地执行特定的算法,如 SHA-256。比特币带来的巨大经济效益,也拉动着相关挖矿的算力需求一并走高,但过于专用化的设备和集群效应,使得本身参与者发生虹吸效应,无论是矿工或矿机制造商,都呈现资本密集型的集中发展趋势。

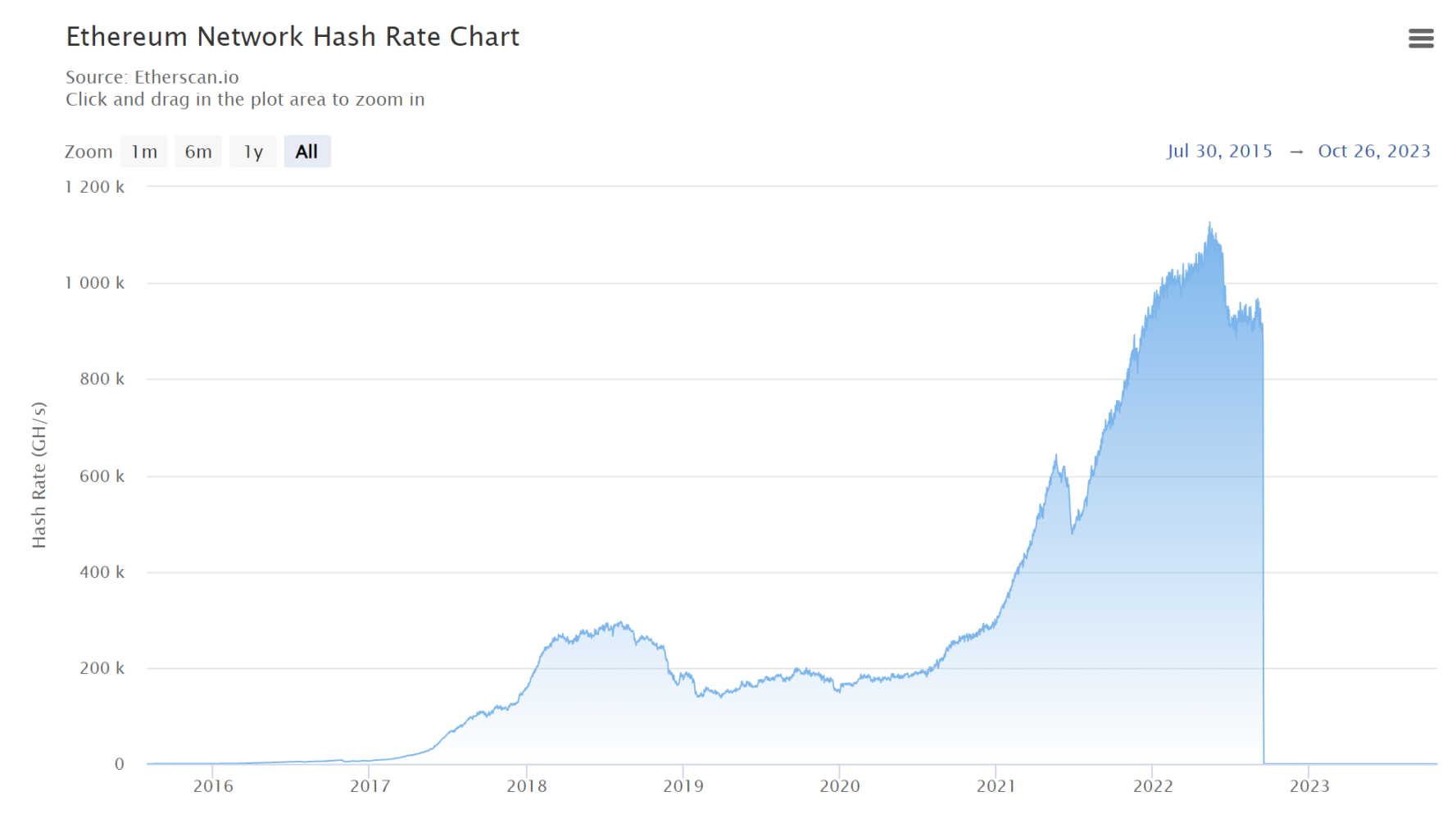

而随着以太坊的智能合约问世,随着它的可编程性、可组合性等特点,形成了广泛的应用,特别是在 DeFi 领域的运用,使得 ETH 的价格一路看涨,而还处于 PoW 共识阶段的以太坊其挖矿难度也一路走高。矿工对以太坊矿机的算力要求也与日俱增,但以太坊与比特币使用 ASIC 芯片不同,则需要使用图形处理器(GPU)来进行挖矿计算,如 Nvidia RTX 系列等。这样它更适合通用计算硬件来参与,这甚至一度引发了,市场对于 GPU 的争抢而导致市面上高端的显卡一度断货的局面。

而当时间来到 2022 年 11 月 30 日,由 OpenAI 研发的 ChatGPT 同样是展示了 AI 领域划时代的意义,用户惊叹于 ChatGPT 带来的全新体验,能如同真人一般,基于上下文完成用户提出的各种要求。而在今年 9 月推出的新版本中,加入了语音、图像等多模态特征的生成式 AI 又将用户体验带到了更新的阶段。

但与之对应的是 GPT4 有超过万亿级的参数参与模型预训练以及后续微调。这是 AI 领域对算力需求最大的两个部分。在预训练阶段,通过学习大量的文本来掌握语言模式、语法和关联上下文。使其能够理解语言规律,从而根据输入生成连贯且上下文相关的文本。预训练之后,再对 GPT4 进行微调,以便于更好地适应特定类型的内容或风格,提升特定需求场景的性能和专业化。

由于 GPT 采用的 Transformer 架构,引入自注意力机制(Self-attention),这种机制使得模型能在处理输入的序列时,同时关注序列中不同部分之间的关系,因而对算力需求急剧增长,特别是在处理长序列是需要大量并行计算和存储大量注意力分数,因而也需要大量的内存和高速的数据传输能力。目前主流的同架构 LLM 对于高性能 GPU 的需求巨大,这也表明 AI 大模型领域投入成本巨大。根据相关 SemiAnalysis 的推测估计 GPT4 一次模型训练成本高达 6300 万美金。而为实现良好的交互体验,GPT4 在日常运营中亦需要投入大量的算力来维持其日常运营。

算力硬件分类

这里我们要来理解一下目前主要的算力硬件类型,CPU、GPU、FPGA、ASIC 分别能处理怎样算力需求场景。

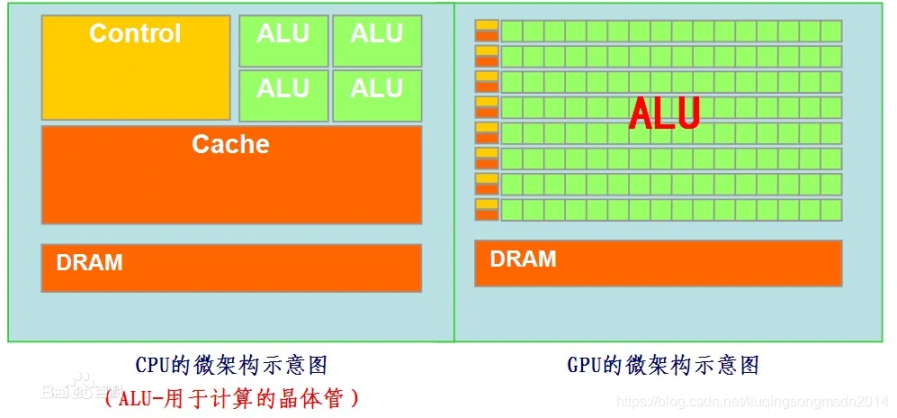

- 从 CPU 和 GPU 的架构示意图上,GPU 包含更多核心,它们使得 GPU 可同时处理多个计算任务,并行计算的处理能力更强,适用于处理大量计算任务,因此在机器学习和深度学习领域得到了广泛的应用。而 CPU 的核心数量较少,适合处理更集中地处理单个复杂计算或序列任务,但在处理并行计算任务时不如 GPU 高效。在渲染任务和神经网络计算任务中,通常需要处理大量重复计算和并行计算,因此 GPU 比 CPU 在这个方面会更高效且适用。

- FPGA(Field Programmable Gate Array)现场可编程逻辑门阵列,是作为专用集成电路(ASIC)领域中的一种半定制电路。由大量小型处理单元组成的阵列,FPGA 可以理解为可编程的数字逻辑电路集成芯片。目前的运用主要集中在硬件加速,其他任务仍然在 CPU 上完成,让 FPGA 和 CPU 协同工作。

- ASIC(Application Specific Integrated Circuit)专用集成电路,是指应特定用户要求和特定电子系统的需要而设计的集成电路。ASIC 在批量生产时与通用集成电路相比具有体积更小、功耗更低、可靠性提高、性能提高、保密性增强、成本降低等优点。因而在比特币挖矿的固有场景下,只需要执行特定的计算任务,ASIC 则是最契合的。Google 也推出了针对机器学习专门设计的 TPU(Tensor Processing Unit)作为 ASIC 的一种,但目前主要通过 Google Cloud 提供算力租用服务。

- ASIC 和 FPGA 相比,ASIC 是专用集成电路,一旦设计完成后集成电路即固定。而 FPGA 是在阵列内集成大量数字电路基本门电路和存储器,开发人员可以通过烧写 FPGA 配置来定义电路,并且这种烧写是可更换的。但就当下的 AI 领域的更新速度,定制化或半定制化的芯片,无法及时通过调整重新配置来执行不同的任务或适应新算法。因而,GPU 的普遍的适应性和灵活性,使其在 AI 领域大放异彩。各大 GPU 厂商就 AI 领域也对 GPU 在 AI 领域的适配做了相关优化。以 Nvidia 为例,推出了专为深度学习设计的 Tesla 系列和 Ampere 架构 GPU,这些硬件包含针对机器学习和深度学习计算优化的硬件单元(Tensor Cores),这使得 GPU 能够以更高的效率和更低的能耗执行神经网络的前向和反向传播。此外也提供了广泛的工具和库来支持 AI 开发,如 CUDA(Compute Unified Device Architecture)来帮助开发人员利用 GPU 进行通用并行计算。

去中心化算力

去中心化算力是指通过分布式计算资源提供处理能力的方式。这种去中心化的方法通常结合区块链技术或类似的分布式账本技术,将闲置的计算资源汇集并分发给需要的用户,以实现资源共享、交易和管理。

产生背景

- 强劲的算力硬件需求。创作者经济的繁荣,使得数字媒体处理方向进入全民创作的时代,激增的视效渲染需求,出现专门渲染外包工作室、云渲染平台等形式,但这样方式也需要本身投入大量的资金用于前期算力硬件采购。

- 算力硬件来源单一。AI 领域发展更加剧了算力硬件的需求,全球以 Nvidia 为龙头的 GPU 制造企业在这场 AI 算力竞赛中,赚得盆满钵满。其供货能力甚至成为能掣肘某一行业发展的关键要素,Nvidia 的市值也于今年首次突破一万亿美元。

- 算力提供仍主要依赖中心化云平台。而目前真正受益于高性能计算需求激增的是以 AWS 为代表的中心化云厂商,它们推出了 GPU 云算力服务,以目前 AWS p4d.24xlarge 为例,租用一台这样的专精于 ML 方向的 HPC 服务器,包含 8 块 Nvidia A100 40GB GPUs,每小时花费在 32.8 美元,其毛利率据估计可达 61%。这也使得其他云巨头纷纷竞相参与,囤积硬件以其在行业发展初期尽可能占据有利。

- 政治、人为干预等因素导致行业发展不平衡。不平衡我们不难看出 GPU 的所有权和集中度更向资金和技术充裕组织和国家倾斜,且与高性能计算集群呈现依仗关系。这使得以美国为代表的芯片半导体制造强国,也在对 AI 芯片出口方面实施更为严苛的限制, 以削弱其他国家在通用人工智能领域的研究能力。

- 算力资源分配过于集中。 AI 领域的发展主动权掌握在少数巨型公司手中,目前以 OpenAI 为代表的巨头,有微软的加持,背后是微软 Azure 提供的丰富算力资源,这使得 OpenAI 每次新产品的发布,都是对当下 AI 行业的重塑和整合,让其余团队在大模型领域难以望其项背。

那么在面对高昂的硬件成本、地域限制、产业发展不均衡的情况,是否有其他解决方案?

去中心化算力平台则应运而生,平台的目的是创建一个开放、透明且自我调节的市场来更有效地利用全球计算资源。

适应性分析

去中心化算力供给侧

目前高昂的硬件价格和供给侧的人为控制,都给去中心化算力网络的建设提供了土壤。

- 从去中心化算力的组成方式来看,多样的算力提供方小到个人 PC、小型物联网设备大到数据中心、IDC 等,大量累积的算力可提供更灵活和可扩展的计算解决方案,从而帮助更多的 AI 开发者和组织更有效地利用有限的资源。都可以通过个人或组织的闲置算力,来实现去中心化算力共享,但这些的算力的可用性、稳定性,受本身用户的使用限制或分享上限的限制。

- 有可能的潜在优质算力来源,则是以太坊转 PoS 后,直接由相关矿场转型提供的算力资源。以美国领先的 GPU 集成式算力提供商 Coreweave 为例,前身是北美以太坊最大的矿场,基于已构建的完备基础设施。此外,退役的以太坊矿机,其中也包含了大量的闲置 GPU,据悉此前以太坊挖矿时代巅峰在网工作的 GPU 约 2700 万张,盘活这些 GPU 也能进一步成为去中心化算力网络重要的算力来源。

去中心化算力需求侧

- 从技术实现来看,去中心化算力资源在图形渲染类,视频转码类,这种计算复杂程度不高的任务,结合区块链技术和 web3 的经济体系能在确保信息数据安全传递情况下,为网络参与者带来了切实的收益激励,积累了有效的商业模式和客群。而 AI 领域则涉及大量的并行计算,节点间的通信、同步等环节,对网络环境等方面有非常高的要求,因而目前应用也都集中于微调、推理、AIGC 等更偏应用层。

- 从商业逻辑来看,单纯算力买卖的市场是缺乏想象力的,行业只能卷供应链、定价策略,但这些又恰好是中心化云服务的优势。因而,市场上限较低也缺乏更多想象空间,所以也能看到原本做单纯图形渲染的网络在寻求 AI 转型,如 Render Network 与 2023 Q1 也推出了原生集成 Stability AI 工具集,用户可以的该项功能引入 Stable Diffusion 作业,业务也不再局限于渲染作业而向 AI 领域扩展。

- 从主要客群来看,很显然大 B 端客户会更倾向于中心化集成式云服务,他们通常有充足的预算,他们通常是从事底层大模型的开发,需要更高效的算力聚合形式;因而,去中心化算力更多的是服务于中小型开发团队或个人,从事多是模型微调,或应用层开发,对算力的提供形式没有太高的要求。他们对价格更敏感,去中心化算力的能从根本上减轻初始成本的投入,因而整体的使用成本也更低,以 Gensyn 此前测算的成本来看,将算力换算成 V100 提供的等值算力,Gensyn 价格仅为 0.4 美元每小时,相比 AWS 同类型的算力需要 2 美元每小时,能下降 80%。虽然这部分生意并不在目前行业中占开销大头,但伴随 AI 类应用的使用场景持续延展,未来的市场规模不容小觑。

- 从提供的服务来看,可以发现目前的项目更像是去中心化云平台的概念,提供的是一整套从开发、部署、上线、分发、交易全流程的管理,这样的好处在于吸引开发者,可以利用相关工具组件来简化开发部署,提升效率;同时能吸引用户来平台使用这些完整的应用产品,形成基于自身算力网络的生态护城河。但这同时也对项目运营提出了更高的要求。如何吸引优秀开发者和用户并实现留存显得尤为重要。

不同领域的应用

1. 数字媒体处理

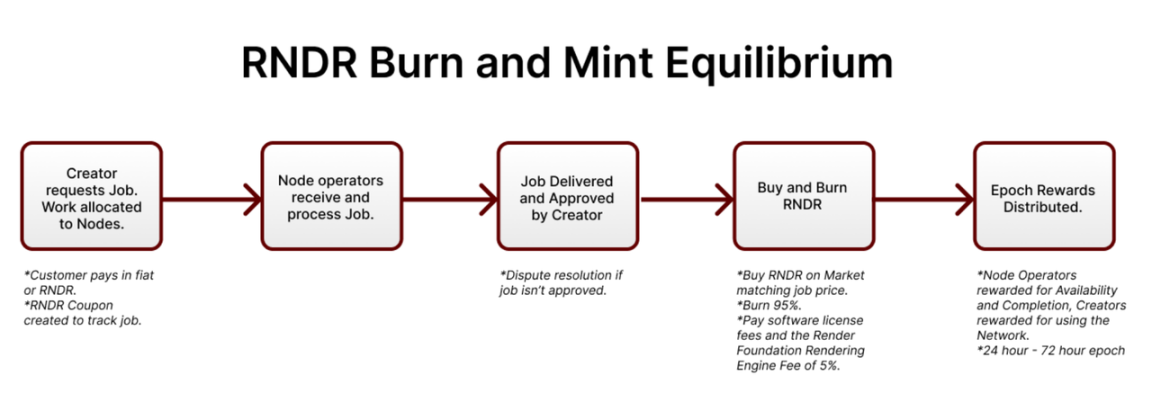

Render Network 一个基于区块链的全球渲染平台,其目标是为创作者数字创意提供帮助。它允许创作者按需将 GPU 渲染工作扩展到全球 GPU 节点,提供了以一种更为高速且便宜的渲染工作能力,在创作者确认过渲染结果后,再由区块链网络向节点发送代币奖励。相比传统的视觉效果实现方法,在本地建立渲染基础设施或在购置的云服务中增加相应的 GPU 开支,这都需要高昂的前期投入。

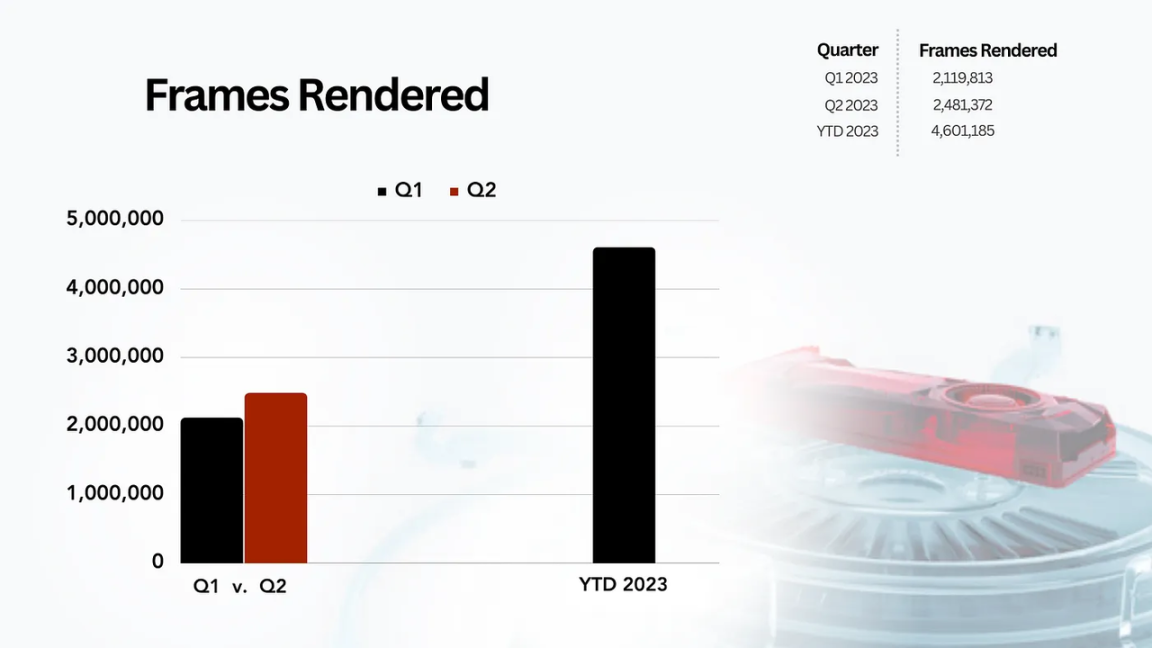

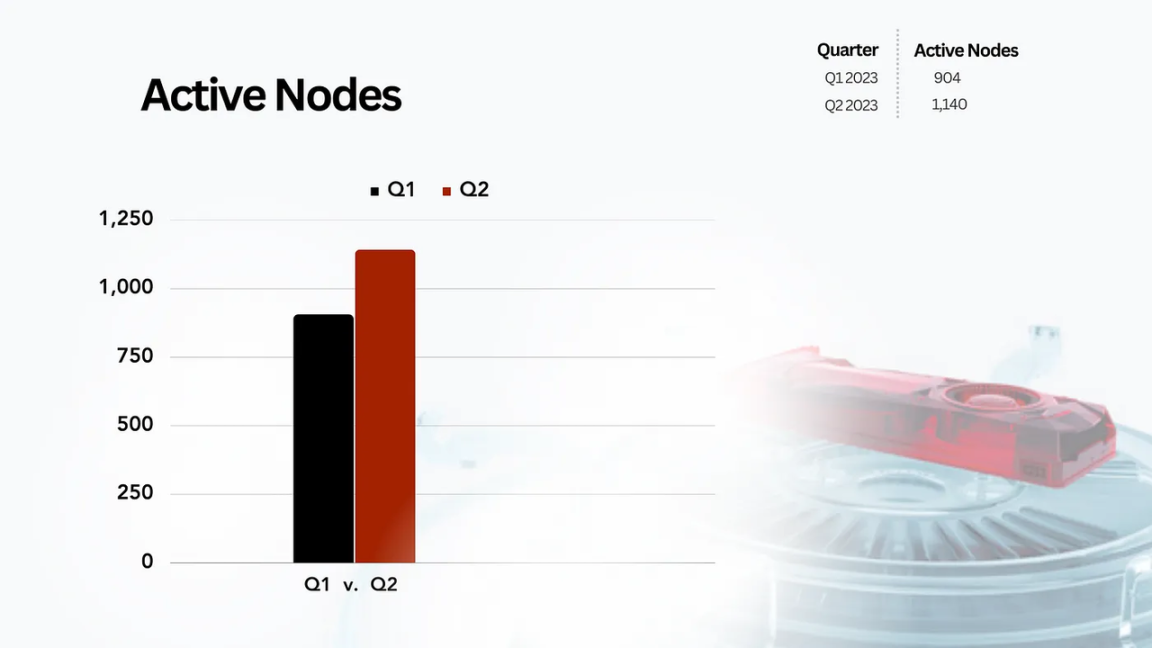

自 2017 年创立以来,Render Network 用户在网络上渲染了超过 1600 万帧和近 50 万个场景。从 Render Network 2023 Q2 发布数据也能表明,渲染帧数作业和活跃节点数都呈增长的趋势。此外,Render Network 与 2023 Q1 也推出了原生集成 Stability AI 工具集,用户可以的该项功能引入 Stable Diffusion 作业,业务也不再局限于渲染作业而向 AI 领域扩展。

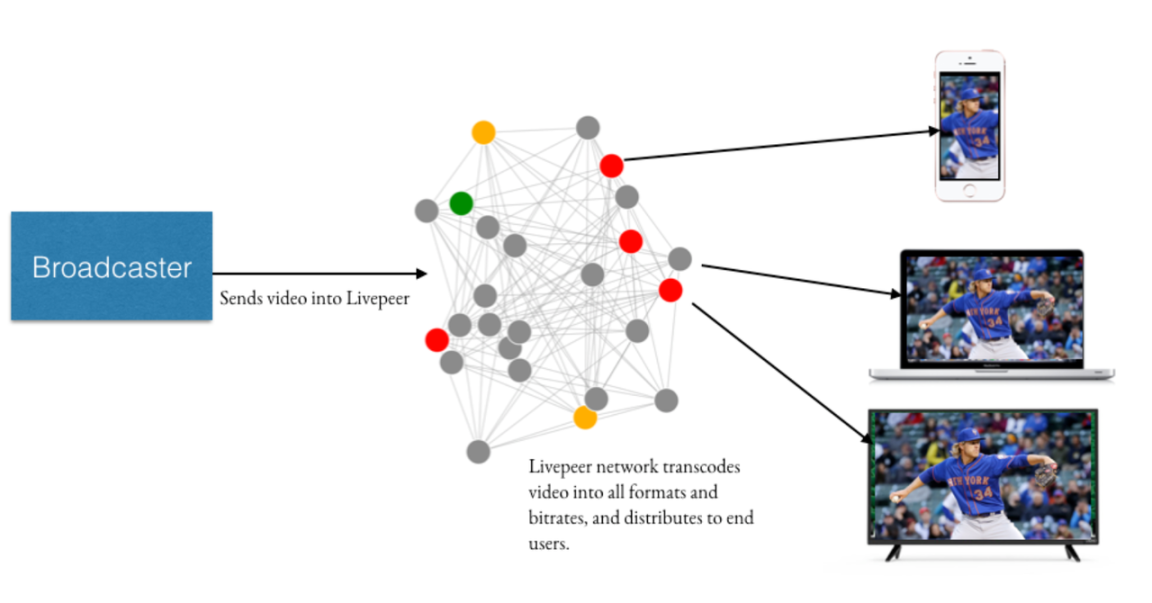

Livepeer 则是通过网络参与者贡献自己的 GPU 算力和带宽,为创作者提供实时视频转码服务。广播者可以通过将视频发送至 Livepeer,完成各类视频转码,并向各类端侧用户分发,进而实现视频内容的传播。同时,可以便捷地通过法币形式支付,获得视频转码、传输、存储等服务。

在 Livepeer 网络中,任何人都允许贡献个人计算机资源(CPU、GPU 和带宽)以进行转码和分发视频来赚取费用。 原生代币(LPT)则代表了网络参与者在网络中的权益,通过质押代币的数量,决定节点在网络中的权重,从而影响其获得转码任务的机会。同时,LPT 也起到了引导节点安全、可靠、快速地完成分派的任务。

2. AI 领域的扩展

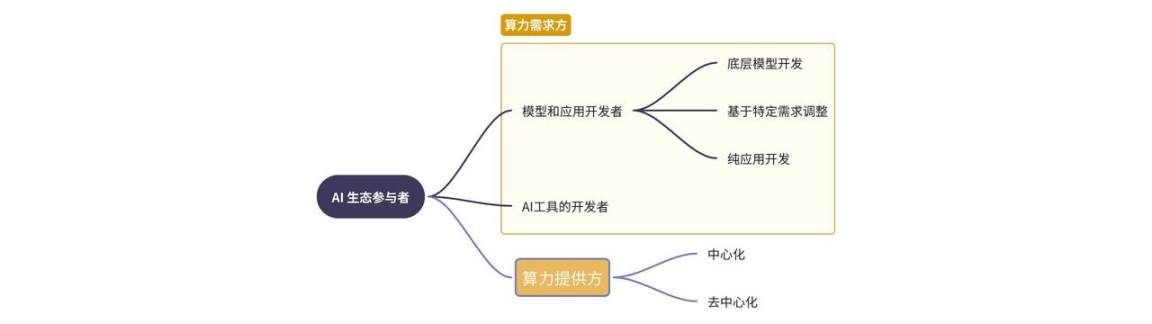

在目前 AI 领域的生态系统中,主要参与者大致可以划分成:

从需求方入手,在产业的不同阶段,对算力的诉求是有明显区别的。以底层模型开发为例,在预训练环节为确保训练结果的有效对并行计算、存储、通信等方面要求都非常高,这就需要通过大型的算力集群来完成相关的任务。当下主要算力供给主要还是依赖自建机房、中心化的云服务平台来集中提供。而在后续模型微调、实时推理和应用开发等环节则对并行计算、节点间通信的要求没有那么高,这恰恰是去中心化算力能一展拳脚的部分。

纵观此前已颇具的声量的项目, Akash Nework 在去中心化算力方向做了一些尝试:

Akash Network 结合不同的技术组件,让用户可以在去中心化的云环境中高效、灵活地部署和管理应用程序。用户可以利用 Docker 容器技术打包应用,然后通过 Kubernetes 在 Akash 提供的云资源上通过 CloudMOS 进行部署和扩展。Akash 采用「反向拍卖」的方式,这使得价格比传统云服务更低。

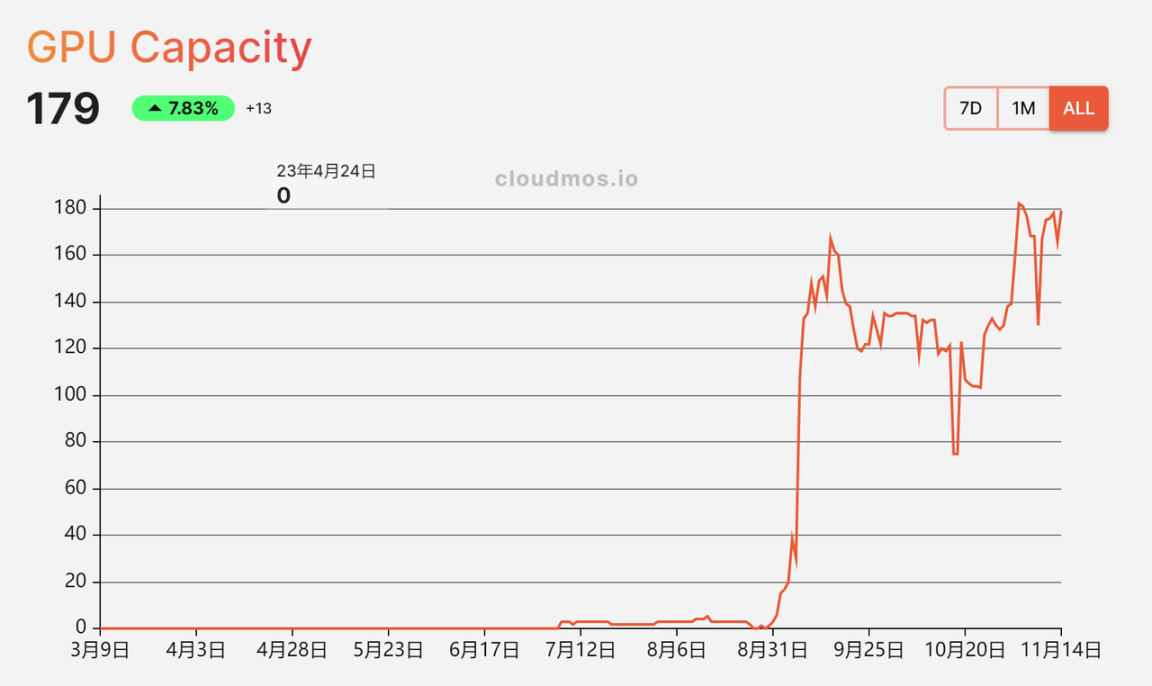

Akash Network 在今年 8 月也发布将推出了主网第 6 次升级,将对 GPU 的支持纳入其云服务中,未来向更多 AI 团队提供算力供给。

Gensyn.ai,今年颇受行业瞩目的项目由 a16z 领投完成了 4300 万美元 A 轮融资,就目前公布项目公布的文档来看, 该项目是一个主网基于波卡网络的 L1 PoS 协议,聚焦于深度学习,它旨在通过创建一个全球性的超级计算集群网络来推动机器学习的边界。这个网络连接了从拥有算力富余的数据中心到潜在可贡献个人 GPU 的 PC,定制的 ASIC 和 SoC 等多种设备。

为解决的目前去中心化算力中存在的一些问题,Gensyn 借鉴了学术界的一些理论研究新成果:

- 采用概率学习证明,即使用基于梯度的优化过程的元数据来构建相关任务执行的证明,来加快验证过程;

- 图形基准协议(Graph-based Pinpoint Protocol),GPP 作为一个桥梁,连接了 DNN(Deep Neural Network)的离线执行与区块链上的智能合约框架,解决了跨硬件设备间容易发生的不一致性,并确保了验证的一贯性。

- 与 Truebit 类似的激励方式,通过质押和惩罚相结合的方式,建立一个能让经济理性参与者能诚实地执行分派的任务。该机制采用了密码学和博弈论方法。这个验证系统对于维持大型模型训练计算的完整性和可靠性。

但值得注意的是以上内容更多的是解决任务完成验证层面,而非在项目文档中作为主要亮点讲述的关于去中心化算力来实现模型训练方面的功能,特别是关于并行计算和分布式硬件间通信、同步等问题的优化。当前受网络延迟(Latency)和带宽(Bandwidth)的影响,频繁的节点间通信会使得迭代时间和通信成本都发生增长,这不仅不会带来实际的优化,相反会降低训练效率。Gensyn 在模型训练中处理节点通信和并行计算的方法可能涉及复杂的协调协议,以管理计算的分布式性质。然而,如果没有更详细的技术信息或对他们具体方法的更深入了解,Gensyn 通过其网络实现大型模型训练的确切机制需要等项目上线才能真正揭晓。

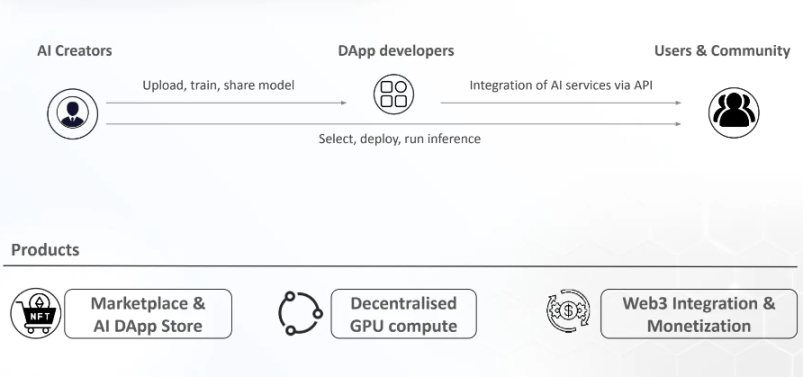

我们还关注到 Edge Matrix Computing (EMC) protocol 它通过区块链技术将算力运用至 AI、渲染、科研、AI 电商接入等类型的场景,通过弹性计算把任务分发到不同的算力节点。这种方法不仅提高了算力的使用效率,还确保了数据传输的安全性。同时,它提供了一个算力市场,用户可以访问和交换计算资源。方便开发者部署,更快地触达用户。结合 Web3 的经济形式,也能使算力提供方在根据用户的实际使用情况获取真实收益和协议方补贴,AI 开发者也获得更低的推理和渲染成本。以下是其主要组成部分和功能的概述:

预期还将推出了基于 GPU 的 RWA 类产品,此项的关键在于将原本在机房固定住的硬件盘活,以 RWA 的形式分割流通,获得额外的资金流动性,高质量 GPU 能作为 RWA 底层资产的原因在于,算力可以算得上 AI 领域的硬通货,目前有明显的供需矛盾,且该矛盾并不能在短期内解决,因而 GPU 的价格相对比较稳定。

此外,通过部署 IDC 机房实现算力集群也是 EMC protocol 会重点布局的部分,这不仅能让 GPU 在统一环境下的运转,更高效地处理相关大型算力消耗的任务,如模型的预训练,由此来匹配专业用户的需求。同时,IDC 机房也能集中托管和运行大量的 GPU,确保同类型高质量硬件的技术规格,方便将其打包作为 RWA 产品推向市场,开启 DeFi 新思路。

近年学界在边缘计算领域也有新的技术理论发展和应用实践。边缘计算作为云计算的一种补充和优化,一部分的人工智能正在加快速度从云端走向边缘,进入到越来越小的物联网设备中。而这些物联网设备往往体积很小,为此轻量机器学习受到青睐,以满足功耗、延时以及精度等问题。

Network3 是通过构建了一个专门的 AI Layer2,通过 AI 模型算法优化和压缩,联邦学习,边缘计算和隐私计算,为全球范围内的 AI 开发者提供服务,帮助他们快速、便捷、高效地训练或者验证模型。它通过利用大量智能物联网硬件设备,可聚焦小模型,来做相应的算力供给,且通过构建 TEE(Trusted Execution Environment)能让用户仅通过上传模型梯度,来完成相关训练,确保用户相关数据隐私安全。

综上

伴随 AI 等领域的发展,许多行业会从底层逻辑上实现巨大变革,算力会上升到更重要的地位,与之关联的各个方面也都会引起行业的广泛探索,去中心化算力网络有其自身优势,可答复降低中心化风险,同时也能作为中心化算力的一种补足。

且本身 AI 领域的团队也处于一个分岔口上,是否利用已训练好的大模型构建自身产品,还是参与到训练各自地域内的大模型,这样的选择也多是辩证的。因而去中心化算力能满足不同的业务需求,这样的发展趋势是喜闻乐见的,且伴随技术的更新和算法的迭代,势必在关键领域也会有所突破。

至不惧,而徐徐图之。