为什么 Web 3 驱动的分布式算力网络是元宇宙的基础设施?

本文基于对元宇宙硬件发展的理解,推导元宇宙应用大规模爆发时对计算和传输的要求,论证为何web3和分布式算力将成为元宇宙时代的计算基础设施。

原文标题:A&T前瞻: 为什么Web 3驱动的分布式算力网络是元宇宙的基础设施?

原文作者:Rosie

原文来源:AnT Capital

Intro

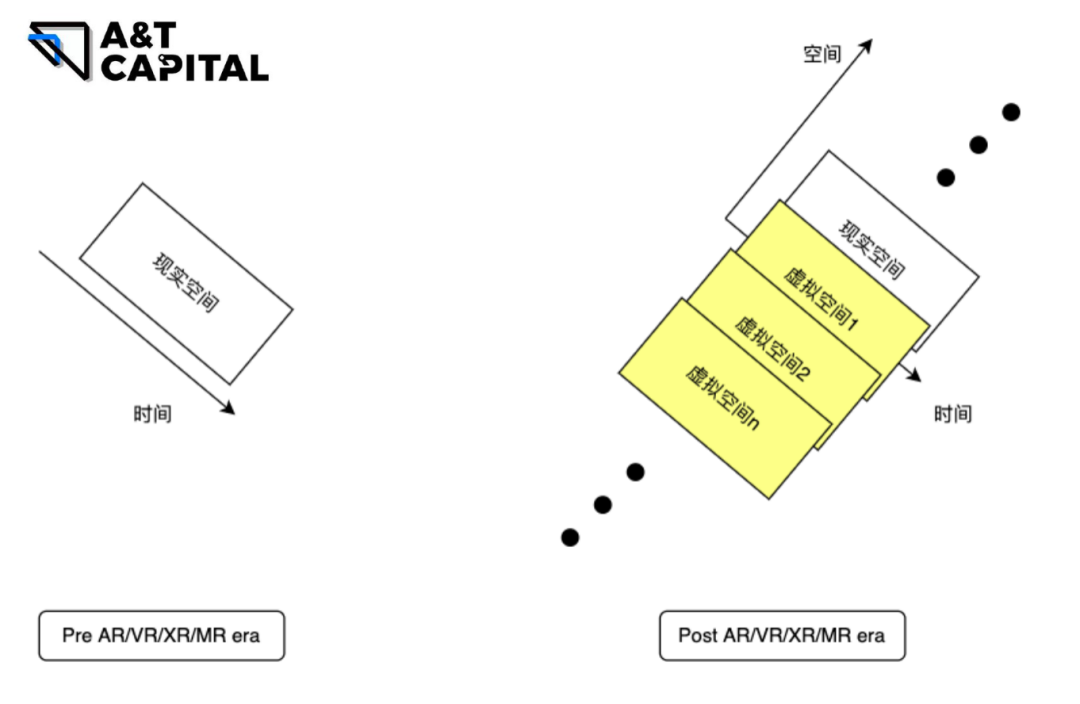

根据网上对元宇宙的定义,元宇宙是利用科技手段(AR/VR/MR/XR等)在与现实世界映射或3D虚拟世界里进行链接和创造。笔者建议,把元宇宙看作与真实世界平行的空间,通过不同的技术手段,可以建立趋近于无数个平行的空间。AR/VR/MR/XR产业带来的不仅仅是对硬件交互的颠覆,也给人类对空间的理解和在空间的使用上带来了新的可能。

随着明年苹果推出名为Reality的MR设备,Meta不断迭代其Oculus的VR,国内的Rokid、光粒、Nreal等AR设备厂商也在纷纷出货,我们已经站在元宇宙爆发的前夕。本文基于对元宇宙硬件发展的理解,推导元宇宙应用大规模爆发时对计算和传输的要求,论证为何web3和分布式算力将成为元宇宙时代的计算基础设施。

元宇宙的发展现状

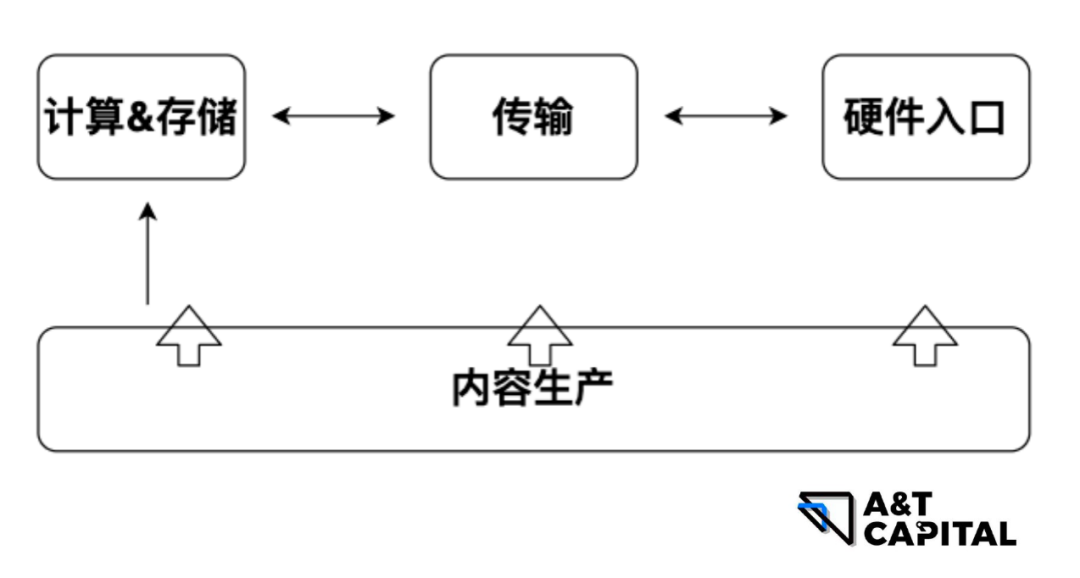

以内容作为驱动整个生态发展的底层逻辑,内容与计算和存储咨询交互,通过传输,内容到达AR/VR/MR/XR硬件设备。用户通过使用终端硬件进入元宇宙。本篇文章讲AR/VR的发展,重心主要落在计算和传输,存储是另外一个大话题,将在后续文章里单独进行分析。

硬件

AR/VR设备是用户进入元宇宙的硬件入口。

AR

AR全称Augmented Reality/增强现实,即利用计算机模拟将虚拟物体叠加在真实环境里,使他们在同一画面和空间存在。

AR的技术趋势为光波导+Micro LED。

VR

VR全称Virtual Reality/虚拟现实,即利用计算机模拟生成3D虚拟世界,向提供使用者近似真实的感官模拟。

VR的技术趋势为折叠光路+Micro OLED。

虽然AR和VR的具体技术路线有差异,但是总体的技术框架相似。两者都是需要通过选择光源和成像方案,将图像呈现在显示屏幕上,给用户从视觉上制造沉浸感。

本篇文章对沉浸感的定义,是人对计算机系统创造和显示出来的虚拟环境的感受无限趋近于人类对真实自然环境的感受。为了实现最高沉浸感,也就是最趋于人对真实世界感知的感受,对AR/VR设备的显示要求是类视网膜的要求。AR/VR设备的显示屏有2个重要参数直接影响用户的沉浸感:

- 分辨率/Resolution 这里先提一个单位,叫做PPD(Pixel Per Degree),它决定显示的清晰程度。与传统屏幕不同,AR/VR等近眼设备采用PPD衡量屏幕的清晰程度,PPD代表视野中每一度视场角的像素密度。类视网膜的屏幕需要达到60PPD。另外一个需要理解的是FOV(Field of View)/视场角,也可以理解为视野。假设单眼横向FOV为110°,纵向约120°:2*(110 x 60) x (120 x 60) 按照分辨率定义,也就是一块差不多13k的屏幕才能满足类视网膜的显示需求。

- 刷新率/Rate of Refresh 可以用fps(frame per second)理解,也就是每秒里面有多少帧图像(一帧就是一张图像)。见下图,当fps低的时候,人眼看到的物品的移动是不连续的。随着帧数增加,人眼感受到的是物品在连续的移动。

引用:《Frame Rate: A Beginner’s Guide for Live Streaming》

当fps低的时候,人会因为画面的不连续产生晕眩感。所以通过提高fps能降低使用AR/VR硬件感受到的晕眩感。当达到60fps的时候,基本上不会产生晕眩;当达到144 fps的时候,就能达到人眼能察觉的最高极限,也就达到了人类感知真实环境的效果。

用户数量

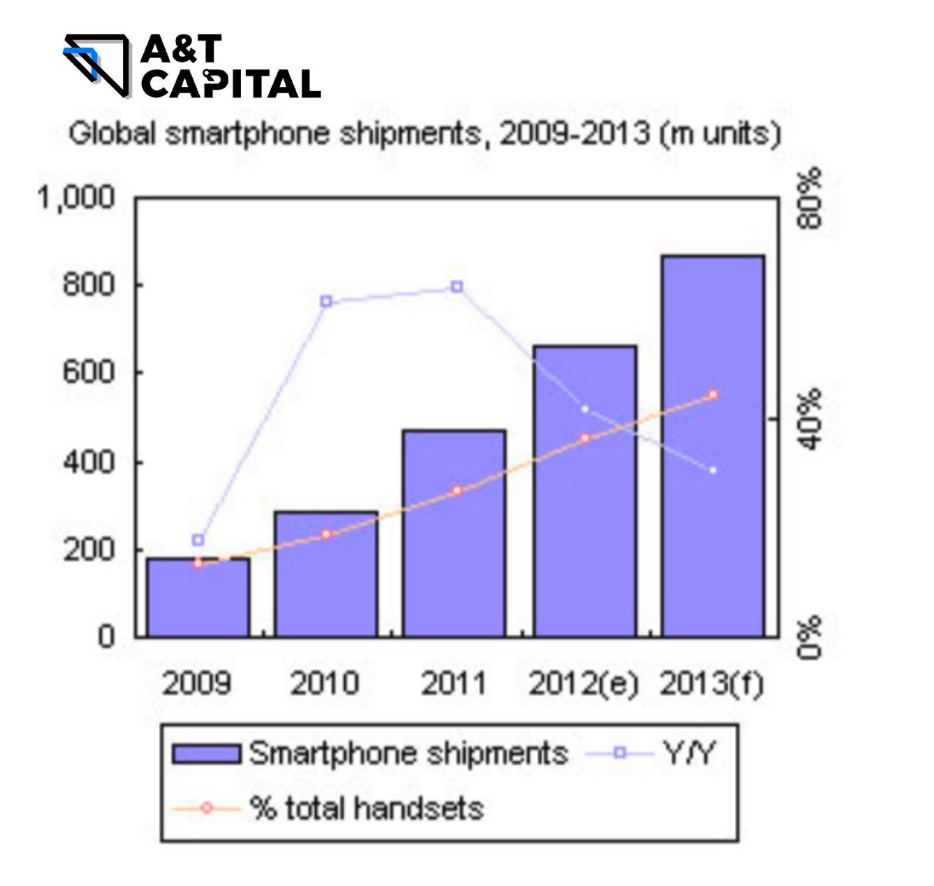

IDC公布2021 年全球AR/VR出货量达到1,120 万台,同比增长92.1%。如果与智能手机的出货量做类比(见下图),我们正所处在AR/VR时代爆发的前夕。

随着AR/VR总出货量的增加,越来越多的用户将通过AR/VR设备进入元宇宙,同时使用AR/VR设备的在线人数会随之增加。

现状和痛点

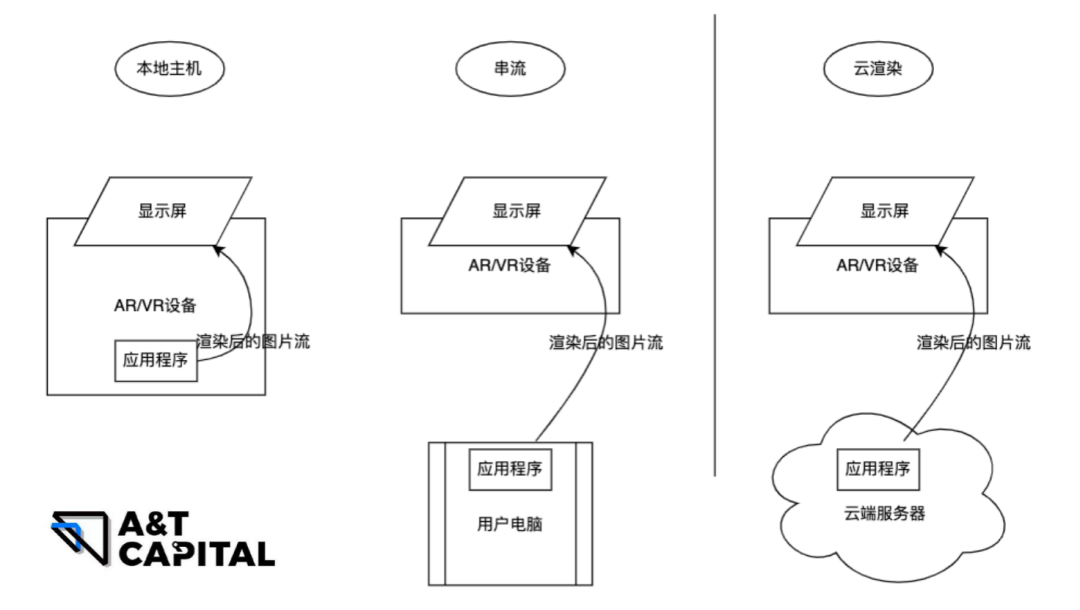

沉浸感是通过使用计算机生成的3D虚拟世界或是通过图像生成三维重建世界,投射在2D屏幕上让人感受到距离、光影、色差而得到的。3D虚拟世界是使用专业的建模软件(如unity)生成的,而3D世界(包括三维重建的世界)及里面的模型如何成像在2D屏幕上是由渲染决定的。渲染是元宇宙世界里使用最多算力的计算工作类型。渲染算法通过一系列参数(例如光照角度、强度等)计算出模型该有的阴影、颜色灰度等,生产出一张张让人眼看上去与真实世界非常相近的图片。用户在AR/VR设备里看到的其实是渲染好的图片流。现在做渲染的方式大类有三种(见下):

- 本地主机:也就是应用程序跑在AR/VR设备里,直接使用AR/VR设备的硬件进行渲染,渲染完成后直接推图片流到AR/VR设备里的显示屏。本地主机渲染架构有几个大的痛点:

- AR/VR应用程序包大,导致在主机端无法同时下载和存储多个应用;

- AR/VR主机厂的因为需要控制设备成本价格,不会选择在主机上安装很多计算资源,因此,AR/VR设备不能满足对渲染要求高的场景的应用程序,限制了能在AR/VR设备上运行的应用程序数量和类型;

- AR/VR设备与人体接触,需要维持其运行的温度在人体能接受的区间,如果做太多本地计算则会使其温度上升,让热管理成为一个问题;

- 由于是佩戴型设备,如果在本地做太多计算,用电速度则会加快,导致用户需要频繁充电,降低了用户的佩戴时间。

基于上述的几个痛点,AR/VR内容提供商和主机厂普遍建议不要在本地做太多计算。

- 串流:也就是应用程序跑在用户的电脑里,使用电脑的硬件进行渲染,渲染完成后直接推图片流到AR/VR设备里的显示屏。串流架构最大的痛点在于渲染速度限制于用户的硬件参数。非常少量的用户拥有能做到13k@144 fps渲染能力的硬件。因此,要达到大规模类人眼的渲染,需要更经济和拓展性更强的计算方案。

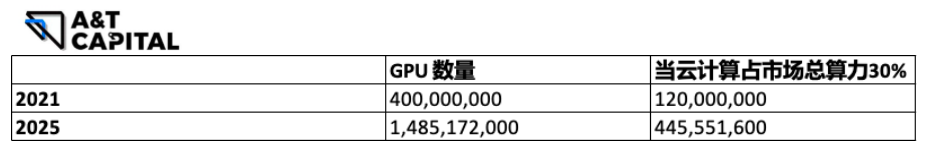

- 云渲染:也就是应用程序跑在云端服务器里,使用云端服务器的硬件进行渲染,渲染完成后直接推图片流到AR/VR设备里的显示屏。由于GPU的设计是最适合做渲染类型的计算工作,假设:

- 所有的渲染工作都由云端GPU计算资源完成;

- 每个GPU的算力为7.4TFLOPS - 即每秒处理7.4兆个浮点计算。7.4TFLOPS这个数字是出货量最大的GPU的算力;

- 云厂商拥有所有算力的30% - 30%这个数字是基于全球云渗透率是15.7%的假设。

2021年全球GPU总出货量加保有量大约是4亿颗,预计到2025年年底GPU总出货量加保有量大约是~15亿颗。假设云厂商拥有全市场30%的算力,按照同比例,云厂于2021年拥有1.2亿颗GPU,于2025年拥有4.5亿颗GPU。

根据分辨率和fps的要求,算出每渲染一张照片每秒同时使用多少颗GPU;再从总GPU数量,算出支持全球同时在线的AR/VR设备数量。可以看到,当渲染计算强度是类人眼时,也就是渲染算力需求是13k@144 fps时,使用云渲染框架于2025年年底仅支持同时在线AR/VR设备数量约为6百万台。根据预测,仅2025年单年AR/VR设备出货量会超1亿台。

因此,在可预见未来的几年内,以云厂商为主要渲染提供商的中心化的渲染算力将不足以支持AR/VR时代的到来,需要新的计算方案和框架来支撑元宇宙的爆发。

Web3驱动的分布式算力网络发展现状

本文把用户拥有的节点称为分布式计算节点,云厂/IDC拥有的计算节点称为中心化计算节点。

通过区块链技术+tokenomics的方式来激励现实世界算力的发展。Multicoin Capital将这个机制称为物理工作证明Proof of Physical Work(PoPW)。PoPW奖励用户执行可验证的物理工作,在本文里是渲染计算。通过使用协议算法验证设备的状态并根据一组预定的规则奖励算力贡献者和验证者。

是什么

分布式计算节点执行一个完整的渲染工作,或者一个渲染工作的一部分,将渲染后的图像以图像流的方式发送到客户端(AR/VR设备端)。

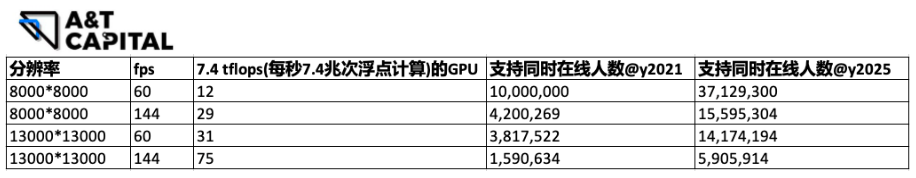

在元宇宙里,渲染是对算力要求最高的计算工作。渲染的流程可以大致分为4个阶段,也叫做渲染管线:

引用《3D可视化入门基础:看渲染管线如何在GPU运作》

- Application阶段:在CPU端执行,通常用于准备绘制所需的几何数据、Uniform数据等,并发送给GPU端;

- Geometry Processing阶段:又可以拆分为顶点着色、细分着色、几何着色、Stream Out(用于将Geometry Processing阶段处理的结果写回到Buffer中)、裁剪(将超过NDC的坐标裁剪掉并生成新的顶点)、以及屏幕映射(Screen Mapping,将NDC坐标映射到屏幕坐标);

- Rasterization(光栅化)阶段:将上一阶段处理的图(点,线,三角形)转变为一个个离散的像素块;

- Pixel Processing阶段:将光栅化生成的像素进行着色(Pixel Shading),之后将计算好的像素根据一定规则写入到frame buffer或者开发者指定的buffer中。

在这些步骤里,有几步是可以被并行处理的,例如像素着色、顶点变换、图元组装或者通用计算等。这些可以被并行处理的计算可以被发送到不同的节点上进行工作,利用分布式节点的算力,成为元宇宙的计算基础设施。

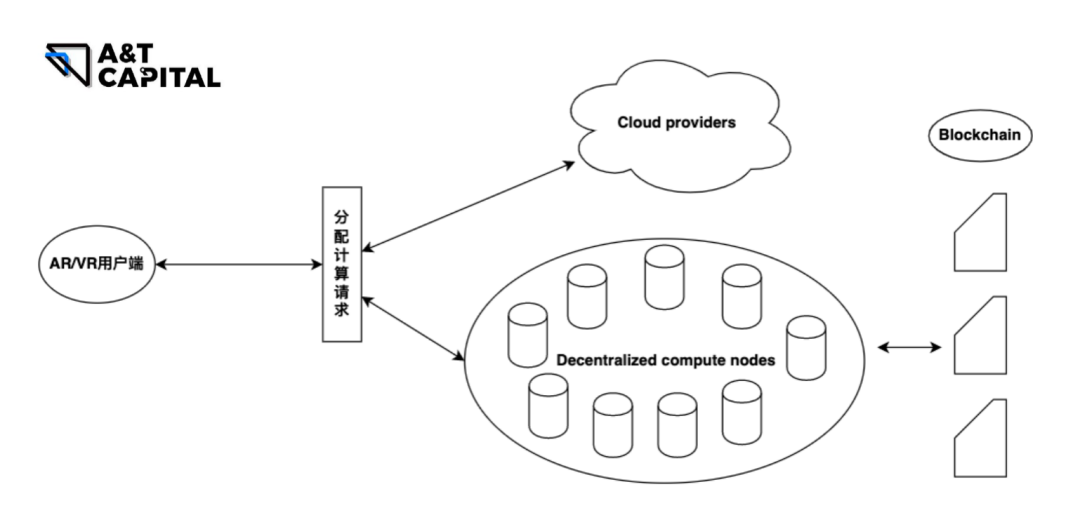

如何成为元宇宙的基础设施解决算力焦虑

在上文里提到,当渲染强度是类人眼时,也就是渲染算力需求是13k@144 fps时,根据我们的假设和估算,使用云渲染框架于2025年年底仅支持同时在线AR/VR设备数量~6百万台。到这个零界点时,分布式算力将不仅仅是作为算力的补充,而是成为支持元宇宙发展的刚需。另外一方面,由于云厂的节点分布相比起边缘节点离用户的物理距离远,导致在云端边渲染好的图片没有边缘边渲染好的图片传输的快。为了实现144 fps的刷新速度,边缘节点在传输距离上比起中心的服务器更短,也就是传输会更快。以tokenomics的方式作为激励全球节点贡献算力的机制,使用POPW的方式验证数据完整性、正确性,推动全球的有算力的节点加入网络,更好的服务全球不同地方用户对元宇宙渲染工作的需求。

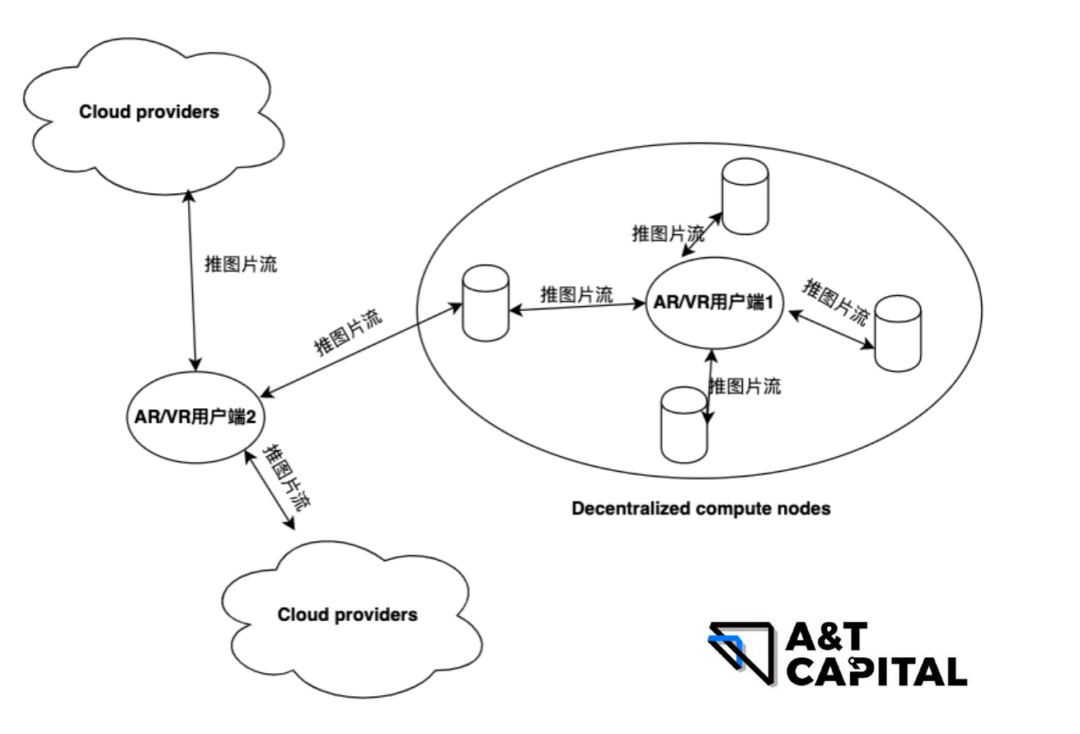

我们构想的元宇宙算力分布将会类似下图的架构:

算力

- 云厂商的GPU资源还是会被充分利用,但是作为general compute resource providers,GPU资源除了被渲染使用,还有很大一部分会被AI相关的领域所使用,所以需要调动更多的计算资源;

- 通过激励模式,让更多的节点加入算力网络。通过评估网络里不同节点的算力的强度,分发相应的渲染工作;

- AR/VR端最终会收到多个节点推来的照片流。AR/VR端只需要对这些照片流进行排序即可在显示屏上显示给用户。

传输

理论上来说,电信号的传播速度是光速,由于物理距离带来的数据传输延迟高的原因在于这些信号在传输过程中会有损耗,因此,长距离传输需要经过“中转站”。这些中转站在收到数据后需要把这个数据的信号加强,还原成刚发出的信号。因为这个过程需要时间,所以总的来说是地理距离越远,延迟越高。

- 如上图所示,当用户端1在离云厂商的机房物理距离远时,选择使用就近的分布式网络节点完成渲染任务;

- 用户端2在离云厂商的机房物理距离近时且离某些分布式节点近时,选择混合渲染方案,即中心+分布式方案;

- AR/VR端会接收多个节点推来的图片流,完成排序后,显示在屏幕上。

Tokenomics + PoPW

使用tokenomics激励全球的网络用户加入算力网络,PoPW的共识协议确保数据的正确性和完整性。

Tokenomics用于基础设施网络有两个好处:

- 能够在全球范围内快速扩展网络,更好的响应全球的渲染工作的需求;

- 大型物理网络需要资金投入,不管是前期购入硬件成本还是后期的运维和维护成本。通过使用tokenomics构建和维护网络并将收益全部分配给供应方是一种更具成本效益的解决方案。

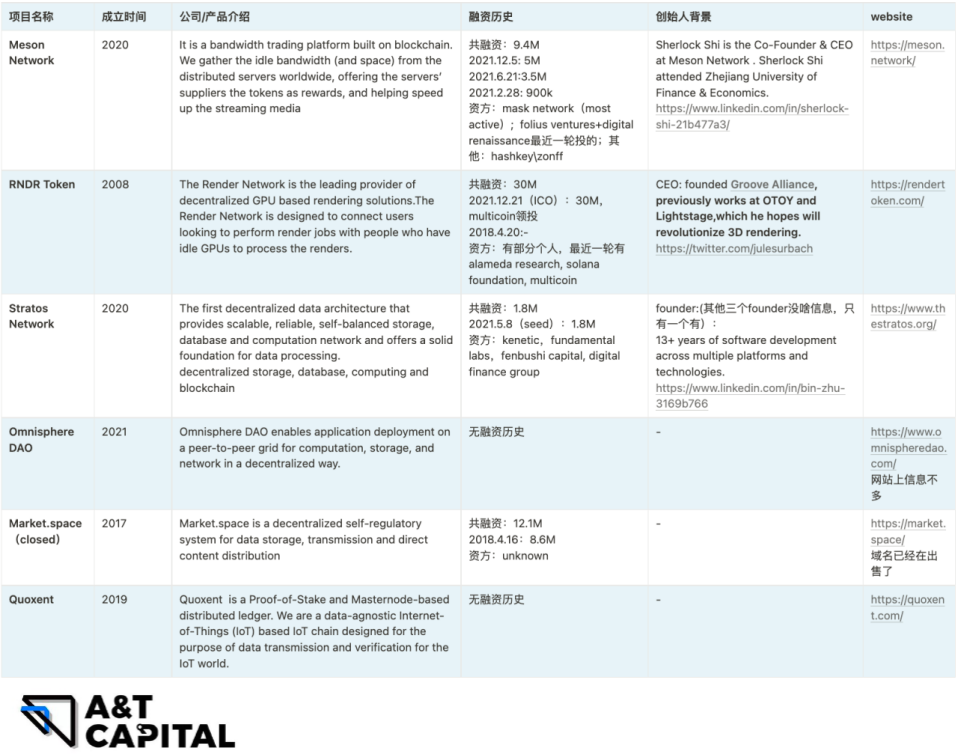

分布式算力市场Mapping

总结

笔者认为,短期来看,Web3驱动的分布式算力的实现难度高,不管对于渲染模型、降低使用的GPU门槛、还是传输,还需要时间发展。但是中长期看,这个是一个必然的结果和选择,将会支持元宇宙大规模爆发,成为元宇宙里算力的重要基建。

责任编辑:Felix